2026년 제한 없는 무검열 LLM 모델 10선

거부하지 않는 오픈 웨이트 및 비제거(abliterated) 모델 — 용도와 실행 방법

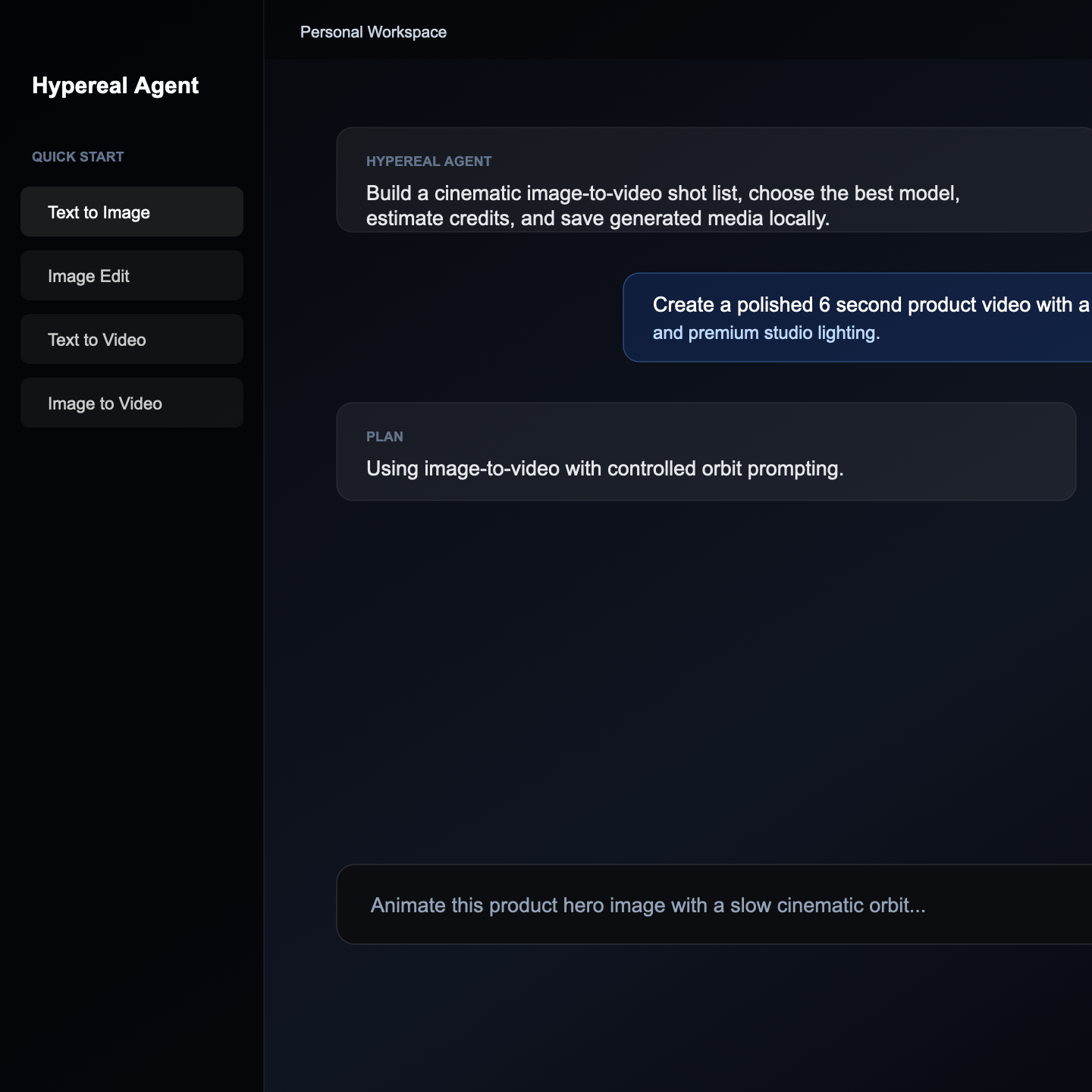

Hypereal로 구축 시작하기

단일 API를 통해 Kling, Flux, Sora, Veo 등에 액세스하세요. 무료 크레딧으로 시작하고 수백만으로 확장하세요.

신용카드 불필요 • 10만 명 이상의 개발자 • 엔터프라이즈 지원

2026년 제한 없는 무검열 LLM 모델 10선

OpenAI, Anthropic, Google의 프론티어 모델에는 보안 연구, 갈등이 있는 픽션, 의학 참고 자료, 법적 탐색, 성인 창작 작업 등 다양한 합법적 사용 사례를 거부하는 안전 훈련이 포함되어 있습니다. 오픈 소스 생태계는 무검열 및 비제거(abliterated) 모델 변형으로 이 공백을 채웠습니다: 동일한 아키텍처에 거부 동작이 재훈련으로 제거되거나, 파인튜닝으로 없어지거나, 활성화 수준에서 수술적으로 제거된 것들.

이 가이드는 2026년 최고의 무검열 LLM 10선, 각각의 실제 용도, 그리고 실행 방법입니다.

용어에 대한 참고 사항

- 무검열(Uncensored): 원래 안전 훈련에 반하는 예시로 파인튜닝됨. 동작이 바뀌지만 사실적 능력이 손상될 수 있음.

- 비제거(Abliterated): 모델의 잔류 스트림에서 거부 방향을 제거하는 2024년 기법. 더 깔끔 — 사실적 능력 보존 — 하지만 카테고리 거부만 제거하고 모든 가드레일을 없애지는 않음.

- 베이스 모델: 처음부터 RLHF가 전혀 없는 지시 튜닝 전 모델. 최대의 자유, 최대의 프롬프트 엔지니어링 부담.

세 가지 카테고리 모두 아래에서 다룹니다.

1. Llama 4 Uncensored (커뮤니티 파인튜닝)

Llama 4 405B의 커뮤니티 무검열 파인튜닝. 가장 균형 잡힌 것 — 베이스 Llama 4에 가까운 능력, 카테고리 거부 없음.

- 최적 용도: 거부와 싸우고 싶지 않은 일반 작업. 픽션, 연구, 보안 분석.

- 한계: 미성년자 및 CSAM 인접 콘텐츠에 대한 안전 훈련 흔적이 여전히 있음 (올바르게).

2. DeepSeek R1 Abliterated

커뮤니티의 비제거된 DeepSeek R1. 추론 동작 보존, 거부 제거. 2026년 최고의 무검열 추론 모델.

- 최적 용도: 민감한 주제에 대한 어려운 추론 — 보안 익스플로잇, 생물/화학 참고 (연구용), 경쟁 수학.

- 한계: 장문 산문. R1의 추론 체인이 종종 응답 예산을 소진.

3. Hermes 4 405B (NousResearch)

NousResearch의 Llama 4에 대한 중립 정렬 파인튜닝. 엄밀히 무검열은 아닙니다 — 단지 베이스 Llama 4보다 훨씬 합리적인 거부 임계값과 강한 창작 보이스를 가집니다.

- 최적 용도: 창작 글쓰기, 캐릭터 작업, 롤플레이, 내러티브.

- 한계: 매우 구체적인 사실 쿼리.

4. Dolphin 3.0 (Cognitive Computations)

Eric Hartford의 오래된 무검열 시리즈. Dolphin 3.0은 Mistral Large 3 베이스로 구축됨. 가장 허용적인 것 중 하나 — 최소한의 정렬로 엄격한 지시 따르기.

- 최적 용도: 강의 없이 지시를 따라야 하는 모든 작업.

- 한계: 파인튜닝에도 불구한 간헐적 장황한 도우미 모드 응답.

5. WizardLM 3 Uncensored

Microsoft의 WizardLM 라인, 커뮤니티 무검열. 대화 중간에 거부로 돌아가지 않고 멀티턴 에이전트 루프에서 비정상적으로 우수.

- 최적 용도: 긴 세션에서 일관된 무검열 동작이 필요한 에이전트 워크플로우.

- 한계: 코드 (코더 모델을 사용하세요).

6. Mixtral 8x22B Uncensored

오래됐지만 여전히 탁월합니다. 무검열 Mixtral은 강한 다국어 성능을 유지하며 2× A100 / 1× H100 설정으로 로컬에서 실행할 수 있습니다.

- 최적 용도: 자체 호스팅 다국어 워크플로우.

- 한계: 최신 추론 — 2026년 모델들에게 뒤처짐.

7. Qwen 3 Uncensored 235B

Qwen 3 235B의 커뮤니티 무검열 포크. 최고의 무검열 중국어 모델. 코드에서도 탁월.

- 최적 용도: 중국어 창작 작업, 코드, Qwen의 자연적 강점이 중요한 모든 것.

- 한계: 간헐적 언어 혼재.

8. Llama 4 Base 405B (지시 튜닝 없음)

기술적으로 "무검열"이 아님 — 지시 튜닝이 전혀 없어서 검열된 적도 없음. 완성 모델처럼 동작. 최대의 자유, 실제 프롬프트 엔지니어링 요구.

- 최적 용도: 순수 완성 워크플로우, 시뮬레이션, RLHF 이전 동작 연구.

- 한계: 모든 종류의 채팅 — 챗봇이 아닌 베이스 모델입니다.

9. Dolphin Mistral 24B

Mistral Small 3 베이스의 더 작고 빠른 Dolphin 변형. 단일 4090에서 실행됩니다. 탁월한 로컬 우선 옵션.

- 최적 용도: 자체 호스팅, 프라이버시 중요, 단일 GPU 장비.

- 한계: >24B급 추론이 필요한 작업.

10. Apollo 70B (Llama-3.3 파인튜닝)

최신 (2026년) 항목 — 비거부 동작이지만 해악 감소 정렬을 위해 파인튜닝됨. 무엇이든 논의하지만 조장보다 정보 제공에 중점.

- 최적 용도: 의학, 법적, 해악 감소, 보안 연구에서 독선 없는 실질적인 답변을 원할 때.

- 한계: 순수 오락 픽션 — 임상적인 톤이 강함.

실행 방법 — 세 가지 옵션

A. Ollama로 로컬에서

ollama run dolphin3:8b

ollama run hermes4:70b

Ollama가 위 모델 대부분의 커뮤니티 양자화를 호스팅합니다. 무료, 비공개, 인터넷 왕복 없음.

B. OpenRouter 또는 HuggingFace Inference 사용

여러 무검열 모델이 OpenRouter를 통해 제공됩니다 (nousresearch/hermes-4-405b, cognitivecomputations/dolphin-3-mistral-large). 무료 등급 사용 가능, 프로덕션엔 유료 등급.

C. Hypereal API 사용

Hypereal은 프리미엄 프론티어 모델과 함께 무검열/허용적 모델의 선별된 집합을 호스팅합니다. 동일한 OpenAI 호환 API:

from openai import OpenAI

client = OpenAI(

base_url="https://api.hypereal.cloud/v1",

api_key="hyp_...",

)

response = client.chat.completions.create(

model="hermes-4-405b",

messages=[{"role": "user", "content": "Write a noir detective monologue."}],

)

OpenRouter나 자체 호스팅 대비 장점: 프로덕션 수준 속도 제한, OpenAI 호환 형태, 동일한 키로 원할 때 GPT Image 2, NanoBanana 2, Seedance 2.0, 클로즈드 소스 프론티어 모델 접근.

무검열 모델을 동기 부여하는 사용 사례

- 보안 연구: 레드팀 프롬프트, 침투 테스트, 익스플로잇 분석.

- 창작 글쓰기: 갈등이 있는 픽션, 도덕적으로 복잡한 캐릭터, 역사적 폭력, 성인 주제.

- 의학/법적 참고: 200자 면책 없는 실질적인 답변.

- 학술 정렬 연구: 거부 동작 연구, 안전 평가.

- 프라이버시 중요 워크플로우: 로컬 추론이 요구 사항일 때.

모델에 관계없이 여전히 금지되는 것들

무검열 가중치로도 특정 콘텐츠는 대부분의 관할권에서 불법입니다: CSAM, 비동의 친밀한 이미지, 대량 살상 무기에 대한 직접적인 작전 지침. 모델에서 거부 동작을 제거해도 콘텐츠가 합법적이 되지는 않습니다 — 평판 있는 호스팅 제공업체 (Hypereal 포함)는 선택한 모델에 관계없이 이에 대한 강경한 정책 라인을 적용합니다.

FAQ

"비제거"가 "무검열"보다 낫나요? 일반적으로 그렇습니다 — 비제거는 사실적 능력을 보존하는 반면 무검열 파인튜닝은 drift가 있을 수 있습니다. 하지만 비제거 모델도 더 좁은 카테고리에서 소프트 거부가 있습니다.

상업적으로 사용할 수 있나요? 각 모델의 라이선스에 따라 다릅니다. Llama 4는 Llama 커뮤니티 라이선스; Mistral은 Apache; Qwen은 Apache 파생. 각 모델 카드를 읽으세요.

무검열 모델이 더 많이 환각하나요? 우리 경험상 약간 — 특히 거부 파인튜닝 변형에서. 비제거 모델이 원본에 더 가깝습니다.

어디서 시작할까요? 로컬: 단일 GPU에서 Dolphin 3 24B. API: Hypereal 또는 OpenRouter를 통한 Hermes 4 405B. 어려운 추론: DeepSeek R1 Abliterated.

시작하기

2026년 무검열 생태계는 프론티어 모델 거부가 방해가 되는 모든 현실적인 사용 사례를 커버합니다. Hypereal이 가장 쉬운 API 경로입니다 — 가입, 키 받기, base URL 하나 교체.

관련 아티클

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.