지금 바로 사용할 수 있는 무료 OpenRouter LLM 모델 10선 (2026)

OpenRouter의 진짜 무료 모델, 각각의 강점, 그리고 한계점

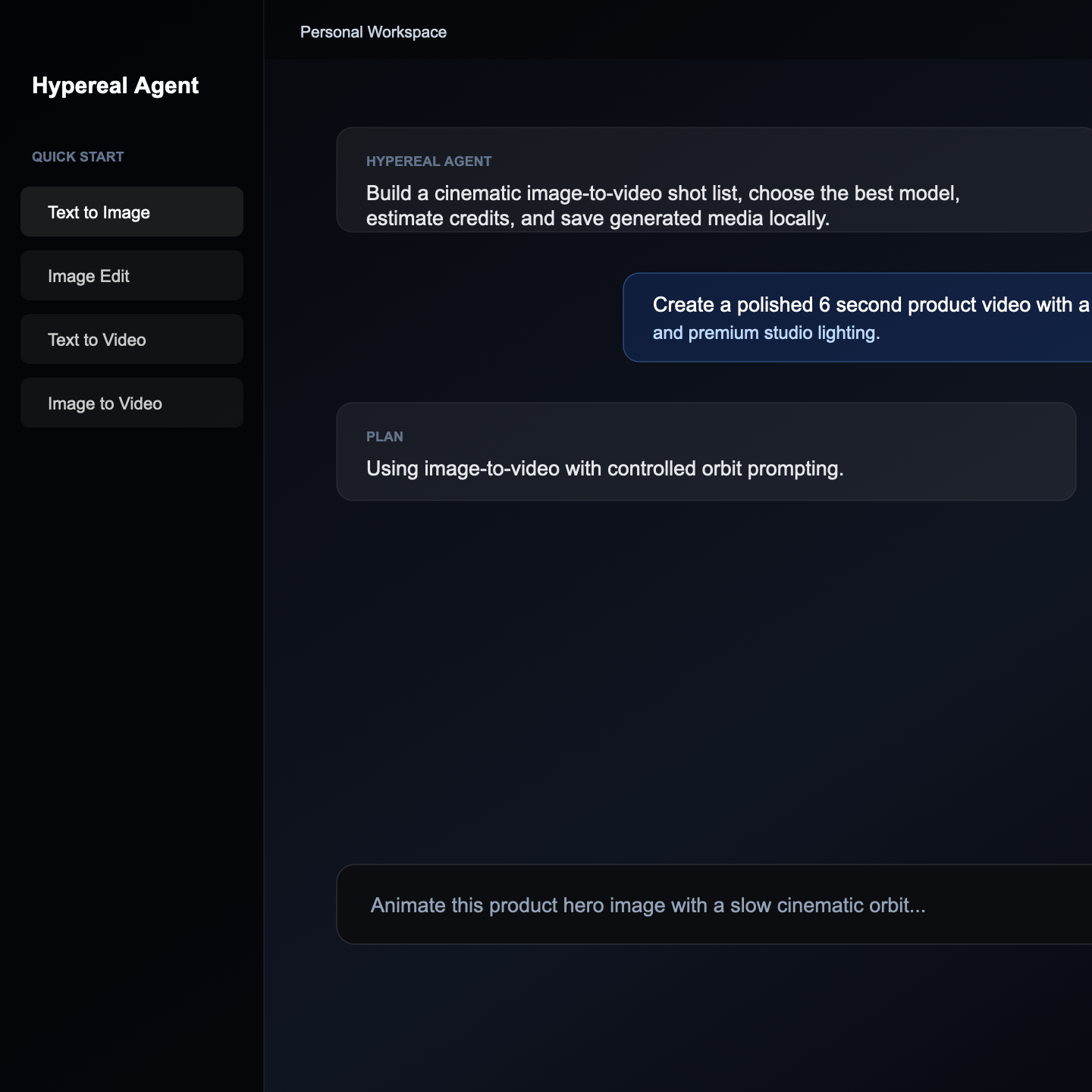

Hypereal로 구축 시작하기

단일 API를 통해 Kling, Flux, Sora, Veo 등에 액세스하세요. 무료 크레딧으로 시작하고 수백만으로 확장하세요.

신용카드 불필요 • 10만 명 이상의 개발자 • 엔터프라이즈 지원

지금 바로 사용할 수 있는 무료 OpenRouter LLM 모델 10선

OpenRouter는 200개 이상의 LLM을 단일 OpenAI 호환 API 뒤에 집약합니다. 대부분은 유료이지만, 제공업체 (DeepSeek, Meta, Alibaba, Z.ai, NousResearch)가 홍보 또는 연구 목적으로 비용을 부담하는 프론티어급 오픈 웨이트 모델들이 $0/토큰으로 제공됩니다.

이 목록은 2026년 5월 기준 OpenRouter의 무료 모델 중 실제로 쓸 만한 10개입니다 — 느리거나, 망가졌거나, 쿼터가 0인 100개 이상을 제외하고. 각각에 대해: 강점, 한계, 모델 ID.

OpenRouter 무료 등급은 속도 제한이 있습니다 (작성 시점 기준 계정당 약 분당 20건, 일당 200건). 더 과중한 사용에는, 마지막 섹션에서 코드를 변경하지 않고 유료 OpenAI 호환 애그리게이터로 전환하는 방법을 보여줍니다.

1. `meta-llama/llama-4-maverick:free`

Meta의 가장 큰 오픈 Llama 4 변형 — 405B 파라미터, MoE 라우팅. 최고의 범용 무료 모델. 코드, 다국어 추론, 지시 따르기에 강합니다.

- 최적 용도: 비용에 민감한 워크로드에서 GPT-4급 품질 드롭인 대체.

- 한계: 매우 긴 컨텍스트 (>128K 토큰), 과중한 툴 사용.

2. `deepseek/deepseek-r2:free`

DeepSeek의 추론 모델 (2026년 3월 출시). 수학에서 GPT-5-mini를 앞서고, 코드에서 Claude Sonnet 4.6에 필적. 응답에서 추론 체인을 볼 수 있습니다.

- 최적 용도: 수학, 코드, 사고 추적을 보고 싶은 다단계 추론.

- 한계: 짧은 대화형 답변 (과도하게 생각함). 지연 시간이 높음 — 멀티초 TTFT.

3. `deepseek/deepseek-v3.2:free`

DeepSeek의 비추론 제너럴리스트. R2보다 빠르고, 컨텍스트 작음. 채팅과 구조화된 출력에 탁월한 가치.

- 최적 용도: 대량 채팅, JSON 출력, 함수 호출.

- 한계: 복잡한 추론 — R2로 에스컬레이션.

4. `qwen/qwen-3-235b:free`

Alibaba의 Qwen 3, 235B MoE. 다국어 강함 (특히 중국어, 한국어, 일본어). 코드에서도 놀랍도록 좋습니다.

- 최적 용도: 비영어 작업, 다국어 파인튜닝 데이터, 중국어 기술 사용 사례.

- 한계: 영어 출력에 중국어 문자가 섞이는 경우 있음. 재시도하면 해결.

5. `qwen/qwen-3-coder:free`

코드 특화 Qwen 3 포크. 코드 완성과 리팩터링에서 파라미터 대비 우수한 성능. 툴 사용에 강합니다.

- 최적 용도: 예산 내 에이전트 코딩 루프.

- 한계: 산문, 창작 글쓰기.

6. `z-ai/glm-4.7:free`

Zhipu의 GLM-4.7. 2026년 가장 저렴한 Claude Sonnet급 모델. 놀랍도록 타이트한 프롬프트 준수.

- 최적 용도: 구조화된 출력, Claude 스타일 동작이 필요한 에이전트 워크플로우.

- 한계: 매우 긴 영어 창작 작업.

7. `google/gemma-3-27b:free`

Google의 오픈 Gemma 3, 27B. 파라미터 수 대비 훨씬 우수한 성능 — Google의 증류 파이프라인이 진정 최고 수준입니다.

- 최적 용도: 엣지 배포 대안, 빠른 추론, RAG QA.

- 한계: 복잡한 추론, ~200줄 이상의 코드.

8. `nousresearch/hermes-4-405b:free`

NousResearch의 지시 튜닝된 Llama 4. Llama 4 베이스가 너무 건조한 캐릭터 글쓰기, 롤플레이, 창작 작업의 기본 선택 파인튜닝.

- 최적 용도: 창작 글쓰기, 캐릭터 보이스, 롤플레이, 내러티브 생성.

- 한계: 코드, 수학, 구조화된 출력.

9. `microsoft/phi-4-mini:free`

Phi-4-mini, 14B. Microsoft의 소형 모델 라인. 크기 대비 최고의 무료 추론 모델.

- 최적 용도: 고처리량, 저지연 추론. 저렴한 사고의 임베딩 워크플로우에 적합.

- 한계: 긴 컨텍스트 회상, 세계 지식이 필요한 작업.

10. `mistralai/mistral-large-3:free`

Mistral Large 3 (OpenRouter의 무료 홍보 등급). 유럽 언어 성능 강함, 타이트한 코드 완성.

- 최적 용도: 유럽 언어, 함수 호출, 코딩.

- 한계: 무료 등급의 가장 엄격한 속도 제한 — 금방 쓰로틀됨.

호출 방법

OpenRouter는 OpenAI 호환 엔드포인트를 사용합니다. 표준 SDK, 모델 ID 앞에 접두사 붙이기:

from openai import OpenAI

client = OpenAI(

base_url="https://openrouter.ai/api/v1",

api_key="sk-or-...",

)

response = client.chat.completions.create(

model="deepseek/deepseek-r2:free",

messages=[{"role": "user", "content": "Explain MoE routing in one paragraph."}],

)

무료 등급으로 충분하지 않을 때

OpenRouter의 무료 등급은 ~20 RPM, ~200건/일로 제한됩니다. 실제 프로덕션 작업은 한 시간 안에 이를 초과합니다. 그럴 때 두 가지 선택이 있습니다:

- OpenRouter 유료로 업그레이드 — 동일한 모델, 속도 제한 없음, 정가.

- 다른 OpenAI 호환 애그리게이터로 이동 — 동일한 API 형태, 종종 상당히 저렴.

Hypereal은 두 번째 버킷에 속합니다. 정확한 모델 ID는 다르지만 API 형태는 동일하며, 동일한 오픈 웨이트 모델 대부분을 프리미엄 모델과 함께 호스팅합니다 (GPT-5, Claude Opus 4.7, Gemini 2.5 Pro, NanoBanana 2, Seedance 2.0, GPT Image 2):

client = OpenAI(

base_url="https://api.hypereal.cloud/v1",

api_key="hyp_...",

)

대부분의 프로덕션 워크로드에서, OpenRouter 무료 → Hypereal 이동이 동일한 처리량에 대해 OpenRouter 유료보다 저렴하며 일일 한도도 없습니다.

FAQ

OpenRouter 무료 모델이 정말 무료인가요? 예 — 제공업체가 비용을 부담합니다. 대신: 속도 제한, 간헐적 대기열 지연, 모델 개선을 위해 프롬프트가 보관될 수 있음 (OpenRouter에서 각 모델의 프라이버시 항목 확인).

DeepSeek R2 같은 추론 모델이 왜 무료인가요? 홍보 목적입니다. 제공업체는 채택 신호와 훈련 데이터를 원합니다. 정책은 시간이 지나면서 바뀔 것입니다.

상업적으로 사용할 수 있나요? 각 모델의 라이선스에 따라 다릅니다 — Llama 4 (Llama 커뮤니티), Qwen (Apache 스타일), GLM (상업적으로 OK), Gemma (Gemma TOU). 각 모델 카드를 확인하세요.

무엇부터 시작해야 하나요? 일반 작업에는 Llama 4 Maverick, 어려운 추론에는 DeepSeek R2, 창작 글쓰기에는 Hermes 4, 다국어 작업에는 Qwen 3.

시작하기

OpenRouter의 무료 등급은 10개의 프론티어급 모델을 $0에 시험해볼 수 있는 가장 빠른 방법입니다. 그 한계를 넘으면, Hypereal이 가장 넓은 모델 카탈로그를 갖춘 가장 저렴한 유료 경로입니다 — OpenRouter가 정가로 제공하는 프리미엄 모델도 포함합니다.

관련 아티클

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.