LM Studio: راهنمای کامل استنتاج محلی LLM (۲۰۲۶)

اجرای مدلهای هوش مصنوعی قدرتمند روی سختافزار خودتان بدون وابستگی به ابر

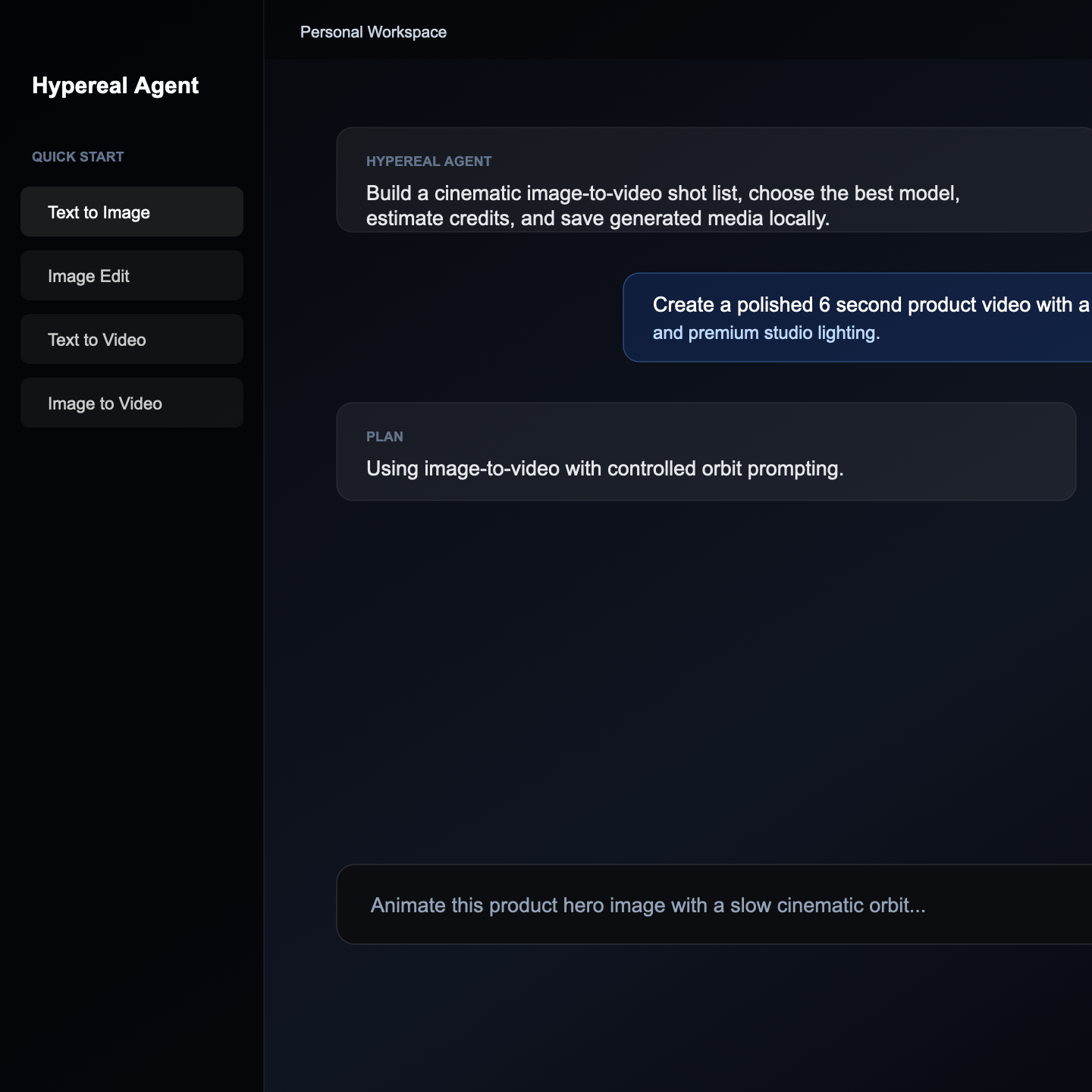

شروع به ساخت با Hypereal AI

دسترسی به Kling, Flux, Sora, Veo و موارد دیگر از طریق یک API واحد. اعتبار رایگان برای شروع، مقیاسپذیری تا میلیونها.

بدون نیاز به کارت اعتباری • بیش از ۱۰۰ هزار توسعهدهنده • آماده برای شرکتها

LM Studio: راهنمای کامل استنتاج محلی LLM (۲۰۲۶)

LM Studio یک برنامه دسکتاپ است که به شما اجازه میدهد مدلهای زبانی بزرگ را کاملاً روی سختافزار محلی خود دانلود، اجرا و با آنها تعامل داشته باشید. بدون وابستگی به ابر، بدون کلید API، بدون هزینه استفاده، و با حریم خصوصی کامل. دادههای شما هرگز از دستگاهتان خارج نمیشوند.

در ۲۰۲۶، استنتاج محلی LLM به طرز شگفتانگیزی عملی شده است. با فرمتهای کوانتیزه بهینهسازیشده مانند GGUF، حتی سختافزار مصرفی میتواند مدلهایی اجرا کند که برای بسیاری از وظایف با APIهای ابری رقابت میکنند. این راهنما همه چیزی که باید درباره LM Studio بدانید را پوشش میدهد: نصب، انتخاب مدل، پیکربندی، بهینهسازی عملکرد و راهاندازی API.

LM Studio چیست؟

LM Studio یک برنامه دسکتاپ رایگان برای macOS، Windows و Linux است که موارد زیر را فراهم میکند:

- رابط کشف و دانلود مدل (مرور Hugging Face)

- رابط چت برای تعامل با مدلها

- سرور API محلی سازگار با OpenAI

- مدیریت مدل (دانلود، حذف، سازماندهی)

- پارامترهای استنتاج قابل تنظیم (دما، طول زمینه، لایههای GPU)

- پشتیبانی از فرمتهای مدل کوانتیزه GGUF، MLX و دیگران

چرا مدلها را بهصورت محلی اجرا کنیم؟

| مزیت | جزئیات |

|---|---|

| حریم خصوصی | دادهها هرگز از دستگاه شما خارج نمیشوند |

| بدون هزینه | بدون هزینه API یا اشتراک |

| بدون محدودیت نرخ | هر مقدار که بخواهید استفاده کنید |

| آفلاین | پس از دانلود مدل بدون اینترنت کار میکند |

| سفارشیسازی | کنترل کامل روی پارامترها و پرامپتهای سیستم |

| سرعت | بدون تأخیر شبکه (استنتاج GPU میتواند بسیار سریع باشد) |

نیازمندیهای سیستم

LM Studio روی طیف گستردهای از سختافزارها اجرا میشود، اما عملکرد با حافظه GPU و RAM سیستم به میزان قابل توجهی مقیاسپذیر است.

حداقل نیازمندیها

| قطعه | حداقل | توصیهشده |

|---|---|---|

| سیستم عامل | macOS 13+، Windows 10+، Ubuntu 22.04+ | آخرین نسخه |

| RAM | 8 GB | 16-32 GB |

| GPU | لازم نیست (حالت CPU) | 8+ GB VRAM |

| فضای ذخیرهسازی | 10 GB آزاد | 50+ GB آزاد |

| CPU | هر 64-bit | Apple Silicon یا x86 مدرن |

سازگاری GPU

| نوع GPU | پشتیبانی | یادداشتها |

|---|---|---|

| NVIDIA (CUDA) | کامل | بهترین عملکرد در Windows/Linux |

| Apple Silicon (Metal) | کامل | عملکرد عالی در macOS |

| AMD (ROCm/Vulkan) | جزئی | ROCm لینوکس خوب کار میکند، Vulkan در ویندوز |

| Intel Arc | جزئی | پشتیبانی از طریق Vulkan در حال بهبود |

| CPU only | بله | کند اما برای مدلهای کوچک کاربردی |

مرحله ۱: نصب LM Studio

macOS

# از وبسایت دانلود کنید

# به https://lmstudio.ai بروید و فایل .dmg را دانلود کنید

# یا از طریق Homebrew نصب کنید

brew install --cask lm-studio

Windows

نصبکننده را از lmstudio.ai دانلود کنید و آن را اجرا کنید. LM Studio در پوشه کاربری شما نصب میشود و نیازی به امتیازات مدیر ندارد.

Linux

# AppImage را از lmstudio.ai دانلود کنید

chmod +x LM-Studio-*.AppImage

./LM-Studio-*.AppImage

# یا از Flatpak استفاده کنید (در صورت موجود بودن)

flatpak install flathub ai.lmstudio.LMStudio

مرحله ۲: دانلود اولین مدل

پس از راهاندازی LM Studio، از تب Discover برای مرور و دانلود مدلها استفاده کنید.

مدلهای توصیهشده بر اساس سختافزار (۲۰۲۶)

| سختافزار | مدل | اندازه | کیفیت |

|---|---|---|---|

| 8 GB RAM (CPU) | Qwen 3 0.6B Q8 | 0.8 GB | وظایف پایه |

| 16 GB RAM (CPU) | Llama 4 Scout 8B Q4_K_M | 5 GB | مناسب برای چت |

| 8 GB VRAM | Qwen 3 14B Q4_K_M | 9 GB | بسیار خوب |

| 12 GB VRAM | Qwen 3 32B Q4_K_M | 19 GB | عالی |

| 16 GB VRAM | Llama 4 Scout 109B Q3_K_M | 14 GB | عالی |

| 24 GB VRAM (RTX 4090) | DeepSeek Coder V3 Q4_K_M | 18 GB | نزدیک به کیفیت ابری |

| Apple M4 Pro 24GB | Qwen 3 32B Q4_K_M | 19 GB | عالی |

| Apple M4 Max 64GB | Llama 4 Maverick Q4_K_M | 55 GB | رقابتی با ابر |

نحوه دانلود مدل

- به تب Discover در LM Studio بروید

- نام مدل را جستجو کنید (مثلاً "Qwen 3 14B")

- کوانتیزاسیون GGUF که میخواهید را انتخاب کنید (Q4_K_M پیشفرض خوبی است)

- روی Download کلیک کنید

- منتظر تکمیل دانلود بمانید (مدلها 2 تا 60+ گیگابایت هستند)

درک کوانتیزاسیون

کوانتیزاسیون اندازه مدل و استفاده از حافظه را به هزینه کمی کیفیت کاهش میدهد. در اینجا راهنمایی برای سطوح رایج کوانتیزاسیون GGUF آمده است:

| کوانتیزاسیون | بیت | اندازه در مقابل FP16 | تأثیر بر کیفیت |

|---|---|---|---|

| Q2_K | 2-bit | ~25% | کاهش کیفیت قابل توجه |

| Q3_K_M | 3-bit | ~35% | کاهش کیفیت محسوس |

| Q4_K_M | 4-bit | ~45% | کاهش کیفیت حداقلی (توصیهشده) |

| Q5_K_M | 5-bit | ~55% | کاهش کیفیت بسیار جزئی |

| Q6_K | 6-bit | ~65% | نزدیک به بدون اتلاف |

| Q8_0 | 8-bit | ~85% | عملاً بدون اتلاف |

| FP16 | 16-bit | 100% | کیفیت اصلی |

Q4_K_M برای اکثر کاربران نقطه شیرینی است: کاهش کیفیت حداقلی با تقریباً نیمی از استفاده از حافظه مدل کامل.

مرحله ۳: چت با مدل

- به تب Chat بروید

- مدل دانلود شده خود را از منوی کشویی انتخاب کنید

- شروع به تایپ پیامها کنید

تنظیمات مفید چت

| تنظیم | پیشفرض | توصیهشده | هدف |

|---|---|---|---|

| دما | 0.7 | 0.1-0.3 برای کد، 0.7-0.9 برای خلاق | کنترل تصادفی بودن |

| طول زمینه | 4096 | حداکثری که سختافزار شما پشتیبانی میکند | مقدار متنی که مدل به یاد میآورد |

| لایههای GPU | خودکار | همه (اگر VRAM اجازه میدهد) | تعداد لایههایی که روی GPU اجرا میشوند |

| پرامپت سیستم | هیچ | بر اساس کاربرد تنظیم شود | رفتار مدل را راهنمایی میکند |

مثالهای پرامپت سیستم

برای کمک به کدنویسی:

You are an expert software developer. Write clean, well-documented code.

Always include error handling and type annotations. Prefer standard library

solutions over third-party dependencies. Explain your reasoning briefly.

برای کمک به نوشتن:

You are a professional editor. Help improve writing clarity, grammar, and

structure. Suggest specific edits rather than general advice. Maintain the

author's voice and intent.

مرحله ۴: استفاده از سرور API محلی

LM Studio شامل یک سرور API سازگار با OpenAI است. این به شما اجازه میدهد از مدلهای محلی با هر ابزاری که از فرمت OpenAI API پشتیبانی میکند استفاده کنید — از جمله Cursor، Continue، Cline، Aider و برنامههای سفارشی.

راهاندازی سرور API

- به تب Developer (یا Local Server) بروید

- مدل خود را انتخاب کنید

- روی Start Server کلیک کنید

- سرور به طور پیشفرض در

http://localhost:1234اجرا میشود

تست API

curl http://localhost:1234/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "qwen3-14b",

"messages": [

{"role": "system", "content": "You are a helpful coding assistant."},

{"role": "user", "content": "Write a Python function to flatten a nested dictionary."}

],

"temperature": 0.2,

"max_tokens": 1000

}'

استفاده با Python

from openai import OpenAI

# اشاره به سرور محلی LM Studio

client = OpenAI(

base_url="http://localhost:1234/v1",

api_key="not-needed" # LM Studio به کلید API نیاز ندارد

)

response = client.chat.completions.create(

model="qwen3-14b",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Explain how HTTP caching works."}

],

temperature=0.3

)

print(response.choices[0].message.content)

اتصال به Cursor

- Cursor > Settings > Models را باز کنید

- یک مدل سفارشی اضافه کنید:

- API Key:

lm-studio(هر رشته غیر خالی) - Base URL:

http://localhost:1234/v1 - Model name: نام مدل بارگذاری شده شما

- API Key:

- مدل را در پنل چت یا عامل Cursor انتخاب کنید

اتصال به Continue (VS Code)

// ~/.continue/config.json

{

"models": [

{

"title": "LM Studio - Qwen 3 14B",

"provider": "openai",

"model": "qwen3-14b",

"apiBase": "http://localhost:1234/v1",

"apiKey": "not-needed"

}

]

}

اتصال به Aider

# استفاده از LM Studio به عنوان backend برای Aider

aider --model openai/qwen3-14b \

--openai-api-base http://localhost:1234/v1 \

--openai-api-key not-needed

مرحله ۵: بهینهسازی عملکرد

به حداکثر رساندن offloading GPU

تأثیرگذارترین تنظیم عملکرد، offloading GPU است. لایههای GPU را به حداکثری که VRAM شما اجازه میدهد تنظیم کنید:

| اندازه مدل | VRAM GPU مورد نیاز (Q4_K_M) | سرعت تقریبی |

|---|---|---|

| 7-8B | 5-6 GB | 30-60 توکن در ثانیه |

| 14B | 9-10 GB | 20-40 توکن در ثانیه |

| 32B | 19-22 GB | 10-25 توکن در ثانیه |

| 70B | 40-45 GB | 5-15 توکن در ثانیه |

طول زمینه در مقابل سرعت

پنجرههای زمینه طولانیتر از حافظه بیشتری استفاده میکنند و استنتاج را کند میکنند. طول زمینه را بر اساس نیاز واقعی خود تنظیم کنید:

چت عمومی: 4096-8192 توکن

کمک به کد: 8192-16384 توکن

تحلیل سند: 16384-32768 توکن

پایگاه کد بزرگ: 32768-65536 توکن

نکات حافظه

- برنامههای دیگر را ببندید تا RAM برای بارگذاری مدل آزاد شود

- از کوانتیزاسیون Q4_K_M به عنوان پیشفرض استفاده کنید (بهترین نسبت کیفیت/اندازه)

- اگر مدلی به سختی در VRAM جا میشود، Q3_K_M را امتحان کنید تا مقداری حافظه آزاد کنید

- در Apple Silicon، حافظه یکپارچه یعنی RAM سیستم بین CPU و GPU مشترک است. یک Mac با 32 GB میتواند مدلهایی که به 28-30 GB نیاز دارند را کاملاً بارگذاری کند

LM Studio در مقابل Ollama

LM Studio و Ollama دو ابزار محبوبترین استنتاج محلی هستند. در اینجا مقایسهای از آنها آمده است:

| ویژگی | LM Studio | Ollama |

|---|---|---|

| رابط | GUI + API | CLI + API |

| فرمت مدل | GGUF، MLX | GGUF (از طریق Modelfile) |

| کشف مدل | مرورگر داخلی | ollama pull |

| سازگاری API | سازگار با OpenAI | سازگار با OpenAI |

| پلتفرم | macOS، Windows، Linux | macOS، Windows، Linux |

| استفاده از منابع | بیشتر (برنامه Electron) | کمتر (CLI) |

| سهولت استفاده | آسانتر برای مبتدیان | آسانتر برای کاربران CLI |

| قیمت | رایگان | رایگان |

LM Studio را انتخاب کنید اگر رابط گرافیکی برای مرور، دانلود و مدیریت مدلها را ترجیح میدهید. Ollama را انتخاب کنید اگر یک جریان کاری CLI-first را ترجیح میدهید و سربار منابع کمتری میخواهید.

سوالات متداول

آیا LM Studio رایگان است؟ بله، LM Studio برای استفاده شخصی کاملاً رایگان است. هیچ هزینه API، اشتراک یا محدودیت استفادهای وجود ندارد.

با چه مدلی شروع کنم؟ اگر 16 GB RAM یا 8+ GB VRAM دارید، با Qwen 3 14B Q4_K_M شروع کنید. برای کدنویسی به طور خاص، DeepSeek Coder V3 یا Qwen 2.5 Coder را امتحان کنید.

آیا مدلهای محلی میتوانند با کیفیت API ابری برابری کنند؟ برای بسیاری از وظایف، بله. یک مدل 32B یا 70B خوب کوانتیزه شده که بهصورت محلی اجرا میشود خروجی قابل مقایسه با GPT-4o برای کدنویسی، نوشتن و تحلیل تولید میکند. برای طلبکارترین وظایف، مدلهای ابری (GPT-5، Claude Opus 4) هنوز برتری دارند.

آیا میتوانم از LM Studio با Cursor/Cline/Aider استفاده کنم؟ بله. سرور API سازگار با OpenAI از LM Studio با هر ابزاری که از endpoint های سفارشی OpenAI پشتیبانی میکند کار میکند. به مثالهای پیکربندی در مرحله ۴ مراجعه کنید.

آیا LM Studio بهصورت آفلاین کار میکند؟ بله. پس از دانلود مدل، LM Studio کاملاً آفلاین کار میکند. برای استنتاج نیازی به اتصال اینترنت نیست.

به چه مقدار فضای دیسک نیاز دارم؟ مدلها از 1 GB (مدلهای کوچک 3B) تا 60+ GB (مدلهای بزرگ 70B+) متغیر هستند. بسته به تعداد مدلهایی که میخواهید دانلود نگه دارید، ۱۰ تا ۵۰ گیگابایت برنامهریزی کنید.

جمعبندی

LM Studio استنتاج محلی LLM را برای همه قابل دسترس میکند. با مدل مناسب برای سختافزار خود، یک دستیار هوش مصنوعی خصوصی، رایگان و آفلاین دارید که وظایف کدنویسی، نوشتن، تحلیل و خلاق را انجام میدهد. سرور API سازگار با OpenAI به این معنی است که مدلهای محلی شما به طور یکپارچه با Cursor، Aider، Continue و برنامههای سفارشی ادغام میشوند.

برای وظایفی که به تواناییهای هوش مصنوعی سطح ابری نیاز دارند — مانند تصاویر، ویدیو و صدا تولید شده توسط هوش مصنوعی — Hypereal AI را رایگان امتحان کنید — ۳۵ کردیت، بدون نیاز به کارت اعتباری. Hypereal برای توسعهدهندگان ایرانی بدون محدودیتهای تحریم در دسترس است و تولید متن محلی LM Studio را با API تولید رسانه ابری ترکیب میکند تا برنامههای هوش مصنوعی قدرتمندی بسازید.

مقالات مرتبط

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.