بهترین مدلهای هوش مصنوعی رایگانی که امروز میتوانی استفاده کنی (2026)

فهرست جامع مدلهای هوش مصنوعی رایگان در حوزههای LLM، تصویر، ویدیو و صدا

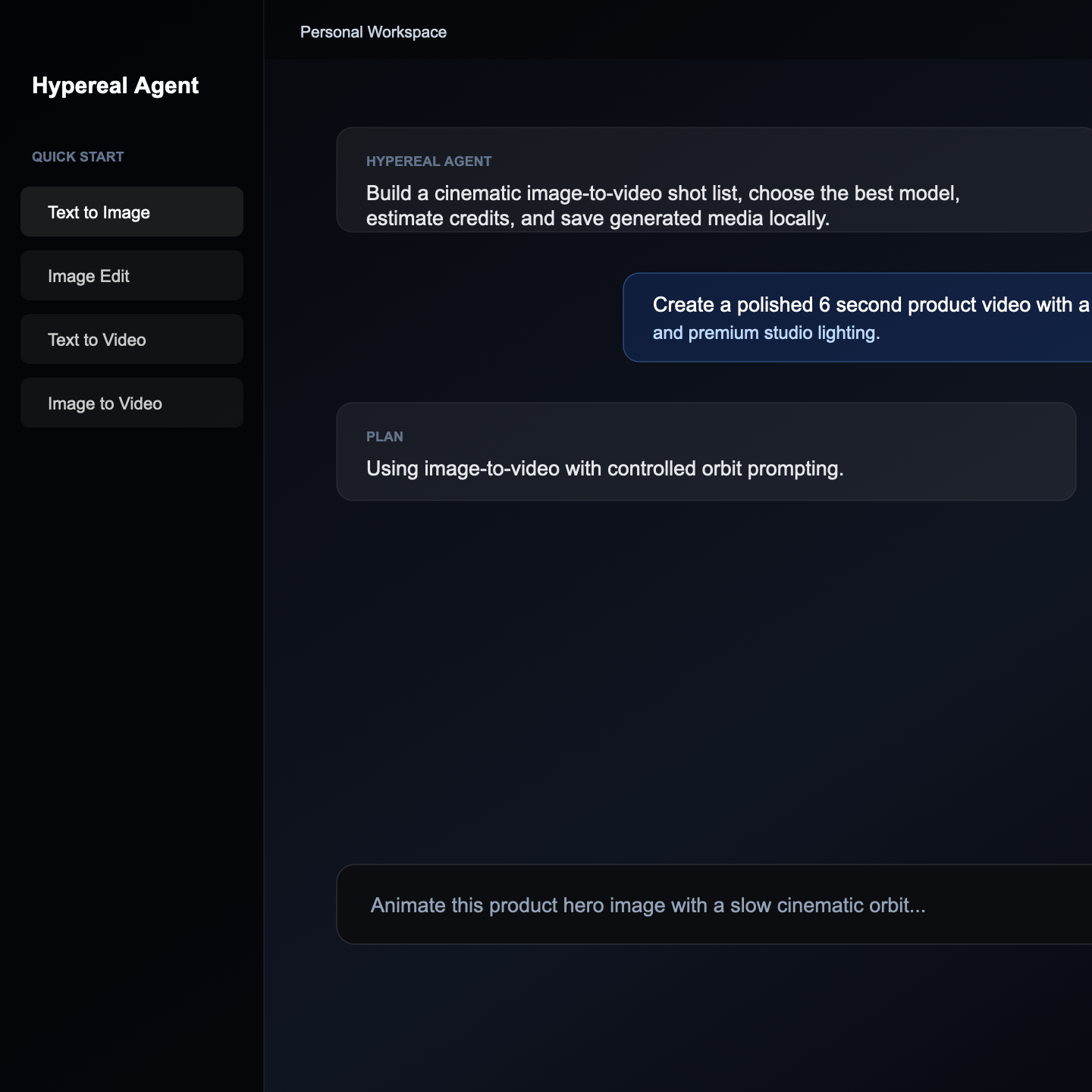

شروع به ساخت با Hypereal AI

دسترسی به Kling, Flux, Sora, Veo و موارد دیگر از طریق یک API واحد. اعتبار رایگان برای شروع، مقیاسپذیری تا میلیونها.

بدون نیاز به کارت اعتباری • بیش از ۱۰۰ هزار توسعهدهنده • آماده برای شرکتها

بهترین مدلهای هوش مصنوعی رایگانی که امروز میتوانی استفاده کنی (2026)

چشمانداز مدلهای هوش مصنوعی به شدت به سمت open source و دسترسی رایگان تغییر کرده. در ۲۰۲۶، میتوانی مدلهای زبانی، تولیدکنندههای تصویر، سازندگان ویدیو و سنتزکنندههای گفتار در سطح جهانی را بدون پرداخت هیچ چیزی اجرا کنی. برخی روی سختافزار خودت محلی اجرا میشوند. بقیه از طریق API های میزبانیشده رایگان هستند.

این راهنما بهترین مدلهای هوش مصنوعی رایگان را در تمام دستهبندیهای اصلی فهرست میکند، با ارزیابی صادقانه کیفیت، نیازهای سختافزاری و نکات استفاده عملی.

مدلهای زبانی بزرگ (LLM) رایگان

رتبهبندی برتر LLM های رایگان

| مدل | پارامترها | مجوز | کیفیت | بهترین برای |

|---|---|---|---|---|

| Llama 3.3 70B | ۷۰B | مجوز Llama 3.3 | عالی | کاربرد عمومی |

| Qwen 2.5 72B | ۷۲B | Apache 2.0 | عالی | کدنویسی، چندزبانه |

| DeepSeek V3 | ۶۷۱B (MoE) | MIT | عالی | استدلال، کدنویسی |

| Gemma 2 27B | ۲۷B | مجوز Gemma | خیلی خوب | inference کارآمد |

| Mistral Small 24B | ۲۴B | Apache 2.0 | خیلی خوب | چندزبانه، سریع |

| Phi-4 14B | ۱۴B | MIT | خوب | کارهای مدل کوچک |

| Llama 3.1 8B | ۸B | مجوز Llama 3.1 | خوب | استقرار محلی |

Llama 3.3 70B

Llama 3.3 70B متا یکی از قویترین مدلهای با وزن باز است. در بسیاری از benchmark ها با عملکرد GPT-4o برابری یا از آن پیشی میگیرد، در حالی که برای استفاده تجاری رایگان است.

# Run locally with Ollama

ollama pull llama3.3:70b

# Or use the smaller 8B variant

ollama pull llama3.1:8b

سختافزار لازم برای 70B: ۴۸GB+ VRAM (A6000 یا دو تا ۳۰۹۰) یا ۶۴GB RAM با CPU inference (کند). نسخه 8B روی هر GPU مدرن با ۸GB VRAM اجرا میشود.

دسترسی رایگان به API: Google AI Studio (از طریق OpenRouter)، Groq، Together AI (اعتبار رایگان)، Cloudflare Workers AI.

Qwen 2.5 72B

Qwen 2.5 علیبابا قویترین مدل open-source برای کدنویسی و کارهای چندزبانه است. مجوز Apache 2.0 یعنی هیچ محدودیتی برای استفاده تجاری نیست.

# Run locally

ollama pull qwen2.5:72b

# Coding-specific variant

ollama pull qwen2.5-coder:32b

ویژگیهای برجسته: پنجره context 128K، فراخوانی ابزار بومی، عملکرد قوی به فارسی، چینی، ژاپنی، کرهای و زبانهای اروپایی.

DeepSeek V3

DeepSeek V3 از معماری Mixture-of-Experts (MoE) با ۶۷۱B پارامتر کل استفاده میکند اما فقط ۳۷B را به ازای هر توکن فعال میکند. این آن را کارآمدتر از آنچه به نظر میرسد میکند، هرچند برای inference محلی همچنان به سختافزار قابل توجهی نیاز دارد.

دسترسی رایگان به API: DeepSeek یک سطح رایگان API ارائه میدهد. مدل همچنین روی Together AI و OpenRouter موجود است.

from openai import OpenAI

client = OpenAI(

api_key="your-deepseek-key",

base_url="https://api.deepseek.com"

)

response = client.chat.completions.create(

model="deepseek-chat",

messages=[{"role": "user", "content": "Solve this step by step: What is the integral of x*sin(x)?"}]

)

print(response.choices[0].message.content)

مدلهای رایگان تولید تصویر

رتبهبندی برتر مدلهای تصویری رایگان

| مدل | نوع | مجوز | کیفیت | سختافزار |

|---|---|---|---|---|

| FLUX.1 Dev | Diffusion Transformer | مجوز FLUX.1-dev | عالی | ۱۲GB+ VRAM |

| Stable Diffusion 3.5 Large | Diffusion Transformer | Stability Community | عالی | ۸GB+ VRAM |

| FLUX.1 Schnell | Diffusion Transformer | Apache 2.0 | خیلی خوب | ۱۲GB+ VRAM |

| Stable Diffusion XL | Latent Diffusion | Open RAIL-M | خوب | ۶GB+ VRAM |

| Playground v3 | Diffusion Transformer | مجوز Playground | خوب | ۱۲GB+ VRAM |

FLUX.1

FLUX.1 از Black Forest Labs پادشاه فعلی تولید تصویر open-source است. نسخه Dev تصاویری تولید میکند که با Midjourney و DALL-E 3 رقابت میکنند. Schnell نسخه سریع بهینهشده برای سرعت است.

# Using ComfyUI API

import requests

import json

workflow = {

"prompt": {

"3": {

"class_type": "KSampler",

"inputs": {

"seed": 42,

"steps": 20,

"cfg": 1.0,

"sampler_name": "euler",

"scheduler": "simple",

"denoise": 1.0,

"model": ["4", 0],

"positive": ["6", 0],

"negative": ["7", 0],

"latent_image": ["5", 0]

}

}

}

}

دسترسی رایگان به API: Hugging Face Inference API، Cloudflare Workers AI (SDXL).

Stable Diffusion 3.5 Large

جدیدترین مدل باز Stability AI با ۸ میلیارد پارامتر. پرامپتهای پیچیده، رندر متن و سبکهای هنری متنوع را بهتر از SDXL مدیریت میکند.

# Install via ComfyUI

cd ComfyUI/models/checkpoints

wget https://huggingface.co/stabilityai/stable-diffusion-3.5-large/resolve/main/sd3.5_large.safetensors

مدلهای رایگان تولید ویدیو

برتر مدلهای ویدیویی رایگان

| مدل | حداکثر طول | رزولوشن | مجوز | سختافزار |

|---|---|---|---|---|

| Wan 2.2 | ۵ ثانیه | ۷۲۰p | Apache 2.0 | ۸GB+ VRAM |

| CogVideoX-5B | ۶ ثانیه | ۷۲۰p | Apache 2.0 | ۲۴GB+ VRAM |

| LTX Video | ۵ ثانیه | ۷۶۸x۵۱۲ | LTXV License | ۱۲GB+ VRAM |

| Mochi 1 | ۵ ثانیه | ۴۸۰p | Apache 2.0 | ۲۴GB+ VRAM |

Wan 2.2

Wan 2.2 علیبابا قویترین مدل ویدیویی open-source تا اوایل ۲۰۲۶ است. از text-to-video و image-to-video با کیفیتی شگفتآور پشتیبانی میکند که به سرویسهای تجاری مثل Kling و Runway نزدیک میشود.

# Run with ComfyUI (requires Wan2.2 nodes)

# The 1.3B model runs on 8GB VRAM

# The 14B model needs 24GB+ VRAM

ollama pull wan2.2:1.3b # Lightweight variant

ویژگیهای برجسته: معماری MoE مدل ۱۴B را به طرز شگفتانگیزی کارآمد میکند. کیفیت برای بسیاری از پرامپتها با Kling 2.0 رقابت میکند.

CogVideoX-5B

توسط Zhipu AI و دانشگاه تسینگهوا توسعه یافته. ویدیوی روان و منسجم با ثبات حرکتی خوب تولید میکند.

دسترسی رایگان به API: روی Hugging Face Inference API و چندین endpoint میزبانیشده توسط جامعه موجود است.

مدلهای رایگان صدا و گفتار

برتر مدلهای صوتی رایگان

| مدل | نوع | مجوز | کیفیت | سختافزار |

|---|---|---|---|---|

| Whisper Large V3 | گفتار-به-متن | MIT | عالی | ۴GB+ VRAM |

| Chatterbox TTS | متن-به-گفتار | Apache 2.0 | عالی | ۴GB+ VRAM |

| Bark | متن-به-گفتار | MIT | خیلی خوب | ۸GB+ VRAM |

| MusicGen Large | تولید موسیقی | MIT | خیلی خوب | ۱۲GB+ VRAM |

| Fish Speech 1.5 | متن-به-گفتار | Apache 2.0 | عالی | ۴GB+ VRAM |

Whisper Large V3

Whisper اوپنای استاندارد طلایی برای تشخیص گفتار میماند. از ۱۰۰+ زبان پشتیبانی میکند و روی سختافزار معمولی بهصورت محلی اجرا میشود.

import whisper

model = whisper.load_model("large-v3")

result = model.transcribe("audio.mp3")

print(result["text"])

دسترسی رایگان به API: Groq (خیلی سریع)، Cloudflare Workers AI، Hugging Face.

Chatterbox TTS

Chatterbox از Resemble AI گفتاری طبیعی تولید میکند که در آزمونهای کور با ElevenLabs رقابت میکند. از کلونسازی صدا از نمونههای صوتی کوتاه پشتیبانی میکند.

from chatterbox.tts import ChatterboxTTS

model = ChatterboxTTS.from_pretrained("cuda")

wav = model.generate(

"Hello, this is a free open-source text to speech model.",

audio_prompt_path="reference_voice.wav"

)

مدلهای رایگان Embedding

| مدل | ابعاد | مجوز | کیفیت |

|---|---|---|---|

| BGE-M3 | ۱۰۲۴ | MIT | عالی |

| Nomic Embed v1.5 | ۷۶۸ | Apache 2.0 | خیلی خوب |

| GTE-Large | ۱۰۲۴ | MIT | خیلی خوب |

| E5-Mistral-7B | ۴۰۹۶ | MIT | عالی |

اینها برای ساخت سیستمهای RAG، جستجوی معنایی و موتورهای پیشنهاد ضروری هستند. همه رایگان برای اجرای محلی یا از طریق Hugging Face هستند.

from sentence_transformers import SentenceTransformer

model = SentenceTransformer("BAAI/bge-m3")

embeddings = model.encode(["What is vector search?", "How do embeddings work?"])

print(f"Similarity: {embeddings[0] @ embeddings[1]:.3f}")

کجا مدلهای رایگان را اجرا کنیم

| پلتفرم | نوع | بهترین برای | هزینه |

|---|---|---|---|

| Ollama | محلی | LLM روی دستگاه خودت | رایگان (سختافزار خودت) |

| ComfyUI | محلی | تولید تصویر/ویدیو | رایگان (سختافزار خودت) |

| Google Colab | دفترچه ابری | دسترسی GPU (T4 رایگان) | سطح رایگان موجود |

| Hugging Face Spaces | میزبانی ابری | دموها، اپهای کوچک | سطح رایگان موجود |

| Kaggle Notebooks | دفترچه ابری | GPU دو تا T4 رایگان | رایگان (۳۰ ساعت/هفته) |

چطور مدل مناسب را انتخاب کنی

از این درخت تصمیمگیری استفاده کن:

- برای کارهای عمومی LLM نیاز داری؟ با Llama 3.3 70B (از طریق Groq برای API رایگان) یا Qwen 2.5 72B شروع کن.

- نیاز به تولید تصویر داری؟ FLUX.1 Dev برای کیفیت، FLUX.1 Schnell برای سرعت.

- نیاز به تولید ویدیو داری؟ Wan 2.2 رهبر واضح در open source است.

- نیاز به سنتز گفتار داری؟ Chatterbox TTS برای کیفیت، Fish Speech 1.5 برای چندزبانه.

- نیاز به رونویسی داری؟ Whisper Large V3، آن را روی Groq برای رایگان و سریع اجرا کن.

- محلی با GPU محدود اجرا میکنی؟ Llama 3.1 8B، Phi-4 14B، یا SDXL برای تصاویر.

جمعبندی

شکاف بین مدلهای هوش مصنوعی رایگان و پولی در ۲۰۲۶ به شکل چشمگیری کاهش یافته. مدلهایی مثل Llama 3.3، FLUX.1 و Wan 2.2 نتایجی ارائه میدهند که یک سال پیش فقط با API های تجاری گرانقیمت ممکن بود. چه آنها را محلی اجرا کنی چه از سطوح رایگان API استفاده کنی، هیچ وقت بهتر از این نبوده که با هوش مصنوعی بسازی.

اگر میخواهی بدون مدیریت infrastructure به چندین مدل رسانهای هوش مصنوعی از طریق یک API دسترسی داشته باشی، Hypereal AI را رایگان امتحان کن — ۳۵ اعتبار، بدون نیاز به کارت اعتباری. دسترسی یکپارچه به ۵۰+ مدل برای تولید تصویر، ویدیو، صدا و آواتار میدهد — برای توسعهدهندگان ایرانی هم بدون محدودیت قابل دسترس.

مقالات مرتبط

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.