بهترین APIهای رایگان LLM منبع باز در ۲۰۲۶

APIهای رایگان و منبع باز LLM که هر توسعهدهندهای باید بداند

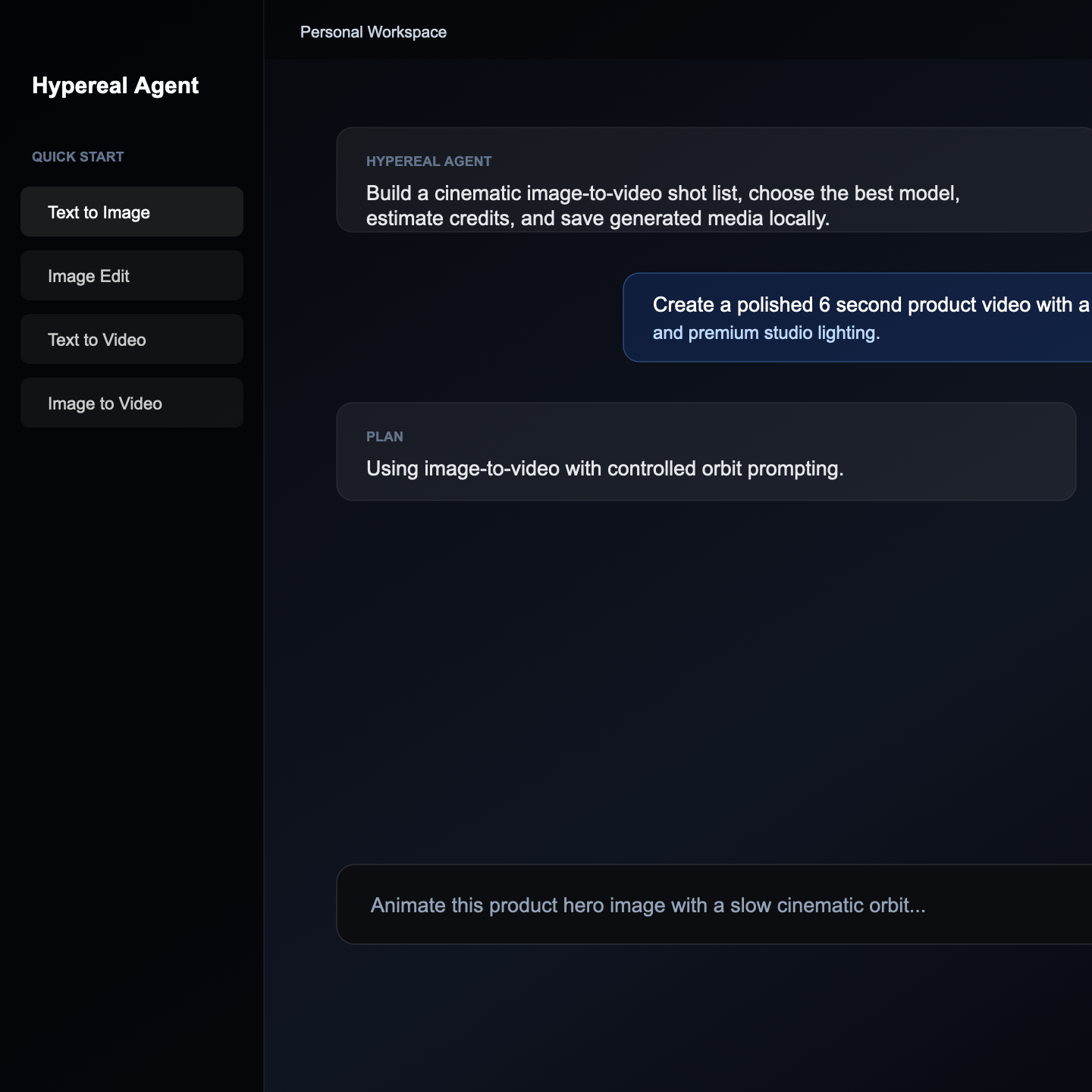

شروع به ساخت با Hypereal AI

دسترسی به Kling, Flux, Sora, Veo و موارد دیگر از طریق یک API واحد. اعتبار رایگان برای شروع، مقیاسپذیری تا میلیونها.

بدون نیاز به کارت اعتباری • بیش از ۱۰۰ هزار توسعهدهنده • آماده برای شرکتها

بهترین APIهای رایگان LLM منبع باز در ۲۰۲۶

برای ساختن اپلیکیشنهای مبتنی بر هوش مصنوعی نیازی نیست صدها دلار در ماه خرج کنی. اکوسیستم LLM منبع باز در ۲۰۲۶ مدلهای با کیفیت بالا با دسترسی رایگان یا بسیار مقرونبهصرفه به API ارائه میدهد. چه داری prototype میسازی، چه پروژههای جانبی میسازی یا workload های تولیدی با بودجه محدود اجرا میکنی، این APIها مدلهای زبانی قدرتمندی بدون گران شدن فراهم میکنند.

این راهنما بهترین APIهای LLM رایگان و منبع باز موجود را با قیمتگذاری، محدودیتهای نرخ و مثالهای کد برای هر کدام پوشش میدهد.

مقایسه سریع

| ارائهدهنده | سطح رایگان | مدل برتر | پنجره Context | محدودیت نرخ (رایگان) | سازگار با OpenAI |

|---|---|---|---|---|---|

| Groq | بله | Llama 3.3 70B, DeepSeek R1 | ۱۲۸K | ۳۰ درخواست/دقیقه | بله |

| Together AI | $5 اعتبار رایگان | Llama 3.3 70B, Qwen 2.5 72B | ۱۲۸K | ۶۰ درخواست/دقیقه | بله |

| Fireworks AI | $1 اعتبار رایگان | Llama 3.3 70B, Mixtral | ۱۲۸K | ۱۰ درخواست/دقیقه | بله |

| OpenRouter | برخی مدلها رایگان | بسته به مدل | متغیر | متغیر | بله |

| HuggingFace Inference | رایگان (محدود نرخ) | Llama 3.3, Mistral, Qwen | ۳۲K-۱۲۸K | ۶۰ درخواست/ساعت | جزئی |

| Cerebras | بتای رایگان | Llama 3.3 70B | ۱۲۸K | ۳۰ درخواست/دقیقه | بله |

| SambaNova | سطح رایگان | Llama 3.3 70B | ۱۲۸K | ۲۰ درخواست/دقیقه | بله |

| Ollama (محلی) | همیشه رایگان | هر مدل GGUF | بستگی به RAM | نامحدود | بله |

| Google AI Studio | سطح رایگان | Gemini 2.5 Flash | ۱M | ۱۵ درخواست/دقیقه | خیر (SDK خودش) |

| Cloudflare Workers AI | سطح رایگان | Llama 3.3, Mistral | ۳۲K | ۱۰K درخواست/روز | جزئی |

۱. Groq

Groq سریعترین inference LLM موجود را ارائه میدهد که مدلها را روی سختافزار LPU (Language Processing Unit) اختصاصیشان اجرا میکند. سطح رایگان آنها یکی از سخاوتمندانهترینهاست.

جزئیات سطح رایگان

| ویژگی | محدودیت |

|---|---|

| محدودیت نرخ | ۳۰ درخواست/دقیقه، ۱۴,۴۰۰ درخواست/روز |

| مدلهای موجود | Llama 3.3 70B, DeepSeek R1, Mixtral 8x7B, Gemma 2 |

| محدودیت توکن | ~۶,۰۰۰ توکن/دقیقه (بسته به مدل) |

| پنجره context | تا ۱۲۸K توکن |

راهاندازی

# Get API key from console.groq.com

export GROQ_API_KEY="gsk_xxxxxxxxxxxx"

from openai import OpenAI

client = OpenAI(

api_key="gsk_xxxxxxxxxxxx",

base_url="https://api.groq.com/openai/v1"

)

response = client.chat.completions.create(

model="llama-3.3-70b-versatile",

messages=[{"role": "user", "content": "Explain quicksort in Python"}],

temperature=0.7

)

print(response.choices[0].message.content)

چرا از Groq استفاده کنیم

سریعترین سرعت inference در این صنعت. پاسخها در میلیثانیه میآیند نه ثانیهها. سطح رایگان به اندازه کافی برای prototyping و پروژههای شخصی سخاوتمندانه است.

۲. Together AI

Together AI طیف گستردهای از مدلهای منبع باز با قیمتگذاری رقابتی و $5 اعتبار رایگان برای حسابهای جدید میزبانی میکند.

جزئیات اعتبار رایگان

| ویژگی | جزئیات |

|---|---|

| اعتبار رایگان | $5 هنگام ثبتنام |

| قیمت Llama 3.3 70B | $0.88/M توکن |

| مدلهای موجود | ۱۰۰+ مدل منبع باز |

| محدودیت نرخ | ۶۰ درخواست/دقیقه |

راهاندازی

from openai import OpenAI

client = OpenAI(

api_key="your-together-api-key",

base_url="https://api.together.xyz/v1"

)

response = client.chat.completions.create(

model="meta-llama/Llama-3.3-70B-Instruct-Turbo",

messages=[{"role": "user", "content": "Write a FastAPI endpoint for user registration"}],

)

print(response.choices[0].message.content)

چرا از Together AI استفاده کنیم

بیشترین تنوع مدلهای منبع باز. اگر میخواهی مدلهای مختلف (Llama، Qwen، Mistral، DeepSeek) را آزمایش کنی، Together همه را روی یک پلتفرم دارد.

۳. HuggingFace Inference API

HuggingFace برای هزاران مدل میزبانیشده روی پلتفرمشان inference رایگان ارائه میدهد. سطح رایگان محدودیت نرخ دارد اما برای توسعه کافی است.

جزئیات سطح رایگان

| ویژگی | محدودیت |

|---|---|

| محدودیت نرخ | ~۶۰ درخواست/ساعت (رایگان)، بالاتر با Pro |

| مدلها | هزاران مدل منبع باز |

| endpoint های اختصاصی | فقط پولی |

| Serverless inference | رایگان برای مدلهای محبوب |

راهاندازی

from huggingface_hub import InferenceClient

client = InferenceClient(

model="meta-llama/Llama-3.3-70B-Instruct",

token="hf_xxxxxxxxxxxx"

)

response = client.chat.completions.create(

messages=[{"role": "user", "content": "Explain async/await in JavaScript"}],

max_tokens=1024

)

print(response.choices[0].message.content)

چرا از HuggingFace استفاده کنیم

دسترسی به بزرگترین مجموعه مدلهای منبع باز. برای آزمایش و امتحان مدلهای نیش یا تخصصی که جای دیگر نیستند عالی است.

۴. OpenRouter

OpenRouter مدلها را از چندین ارائهدهنده جمع میکند و برخی مدلها را رایگان ارائه میدهد. به عنوان یک gateway API یکپارچه با endpoint های سازگار با OpenAI عمل میکند.

مدلهای رایگان

OpenRouter چندین مدل را با هزینه صفر ارائه میدهد (حمایتشده توسط جامعه):

| مدل | Context | وضعیت |

|---|---|---|

| DeepSeek V3 (رایگان) | ۱۲۸K | رایگان |

| Llama 3.3 8B (رایگان) | ۱۲۸K | رایگان |

| Mistral 7B (رایگان) | ۳۲K | رایگان |

| Gemma 2 9B (رایگان) | ۸K | رایگان |

مدلهای رایگان محدودیت نرخ پایینتری دارند و ممکن است در اوقات اوج صف داشته باشند.

راهاندازی

from openai import OpenAI

client = OpenAI(

api_key="sk-or-xxxxxxxxxxxx",

base_url="https://openrouter.ai/api/v1"

)

response = client.chat.completions.create(

model="deepseek/deepseek-chat-v3-0324:free",

messages=[{"role": "user", "content": "Write a Python decorator for caching"}],

)

print(response.choices[0].message.content)

چرا از OpenRouter استفاده کنیم

یک کلید API برای دهها ارائهدهنده. تعویض آسان مدل. برخی مدلهای واقعاً رایگان. بازگشتی عالی وقتی یک ارائهدهنده خراب است.

۵. Ollama (محلی)

Ollama به شما اجازه میدهد LLM های منبع باز را روی دستگاه خودت اجرا کنی. کاملاً رایگان است، آفلاین کار میکند و همه دادهها را خصوصی نگه میدارد.

راهاندازی

# Install Ollama

curl -fsSL https://ollama.com/install.sh | sh

# Download and run a model

ollama pull llama3.3

ollama run llama3.3

استفاده با API سازگار با OpenAI

Ollama یک API محلی روی پورت ۱۱۴۳۴ expose میکند:

from openai import OpenAI

client = OpenAI(

api_key="ollama", # any string works

base_url="http://localhost:11434/v1"

)

response = client.chat.completions.create(

model="llama3.3",

messages=[{"role": "user", "content": "Explain Docker networking"}],

)

print(response.choices[0].message.content)

مدلهای توصیهشده برای استفاده محلی

| مدل | اندازه | RAM لازم | کیفیت |

|---|---|---|---|

| Llama 3.3 8B | 4.7 GB | 8 GB | خوب |

| Llama 3.3 70B | 40 GB | 48 GB | عالی |

| Qwen 2.5 32B | 18 GB | 24 GB | خیلی خوب |

| DeepSeek Coder V2 16B | 9 GB | 12 GB | عالی برای کد |

| Mistral Small 22B | 13 GB | 16 GB | خوب |

| Phi-4 14B | 8 GB | 12 GB | خوب برای اندازه |

چرا از Ollama استفاده کنیم

حریم خصوصی کامل، هزینه صفر، آفلاین کار میکند. برای توسعهدهندگانی که با دادههای حساس کار میکنند یا میخواهند مصرف نامحدود بدون محدودیت نرخ داشته باشند ضروری است.

۶. Google AI Studio (Gemini)

گوگل از طریق AI Studio یک سطح رایگان سخاوتمندانه برای مدلهای Gemini ارائه میدهد که آن را یکی از بهترین گزینههای رایگان برای توسعهدهندگان میکند.

جزئیات سطح رایگان

| ویژگی | محدودیت |

|---|---|

| Gemini 2.5 Flash | ۱۵ درخواست/دقیقه، ۱,۵۰۰/روز |

| Gemini 2.5 Pro | ۲ درخواست/دقیقه، ۵۰/روز |

| پنجره context | تا ۱M توکن |

| قیمت | رایگان |

راهاندازی

import google.generativeai as genai

genai.configure(api_key="your-api-key")

model = genai.GenerativeModel("gemini-2.5-flash")

response = model.generate_content("Write a regex to validate email addresses")

print(response.text)

چرا از Google AI Studio استفاده کنیم

Gemini 2.5 Flash یکی از بهترین مدلهای رایگان موجود است. پنجره context 1M توکن در این نقطه قیمتی بیرقیب است.

۷. Cerebras

Cerebras inference سریع مبتنی بر تراشههای wafer-scale خود ارائه میدهد. سطح بتای رایگان آنها سرعتهای رقابتی ارائه میدهد.

راهاندازی

from openai import OpenAI

client = OpenAI(

api_key="your-cerebras-key",

base_url="https://api.cerebras.ai/v1"

)

response = client.chat.completions.create(

model="llama-3.3-70b",

messages=[{"role": "user", "content": "Explain database indexing strategies"}],

)

print(response.choices[0].message.content)

چرا از Cerebras استفاده کنیم

inference بسیار سریع (رقابت با Groq). سطح رایگان خوب برای توسعه و prototyping.

۸. Cloudflare Workers AI

Cloudflare به عنوان بخشی از پلتفرم Workers خود با یک سطح رایگان سخاوتمندانه inference AI ارائه میدهد.

جزئیات سطح رایگان

| ویژگی | محدودیت |

|---|---|

| درخواستها | ۱۰,۰۰۰/روز |

| مدلها | Llama 3.3، Mistral و دیگران |

| Neurons (واحدهای محاسباتی) | ۱۰,۰۰۰/روز |

| استقرار | Edge (CDN جهانی) |

راهاندازی

// Cloudflare Worker

export default {

async fetch(request, env) {

const response = await env.AI.run('@cf/meta/llama-3.3-70b-instruct-fp8-fast', {

messages: [

{ role: 'user', content: 'Explain WebSocket connections' }

]

});

return new Response(JSON.stringify(response));

}

};

چرا از Cloudflare Workers AI استفاده کنیم

استقرار Edge (تأخیر پایین در سطح جهانی)، یکپارچه با اکوسیستم Cloudflare، و سطح رایگان سخاوتمندانه برای اپلیکیشنهای serverless.

نحوه انتخاب

| مورد استفاده | توصیهشده |

|---|---|

| سریعترین inference رایگان | Groq یا Cerebras |

| بیشترین تنوع مدل | Together AI یا OpenRouter |

| حریم خصوصی کامل / آفلاین | Ollama |

| بزرگترین پنجره context (رایگان) | Google AI Studio (Gemini) |

| استقرار Edge | Cloudflare Workers AI |

| آزمایش با مدلهای نیش | HuggingFace |

| تولید با اعتبارهای رایگان | Together AI ($5 اعتبار) |

| توسعه با هزینه صفر | ترکیب Groq + Ollama |

کلاینت پایتون جهانی

از آنجایی که اکثر ارائهدهندگان API های سازگار با OpenAI پشتیبانی میکنند، میتوانی یک کلاینت جهانی بنویسی که بین آنها جابجا میشود:

from openai import OpenAI

PROVIDERS = {

"groq": {

"base_url": "https://api.groq.com/openai/v1",

"api_key": "gsk_xxx",

"model": "llama-3.3-70b-versatile"

},

"together": {

"base_url": "https://api.together.xyz/v1",

"api_key": "tog_xxx",

"model": "meta-llama/Llama-3.3-70B-Instruct-Turbo"

},

"openrouter": {

"base_url": "https://openrouter.ai/api/v1",

"api_key": "sk-or-xxx",

"model": "deepseek/deepseek-chat-v3-0324:free"

},

"ollama": {

"base_url": "http://localhost:11434/v1",

"api_key": "ollama",

"model": "llama3.3"

},

}

def query(provider: str, prompt: str) -> str:

config = PROVIDERS[provider]

client = OpenAI(api_key=config["api_key"], base_url=config["base_url"])

response = client.chat.completions.create(

model=config["model"],

messages=[{"role": "user", "content": prompt}],

)

return response.choices[0].message.content

# Use the cheapest available provider

answer = query("groq", "Explain the difference between REST and GraphQL")

print(answer)

نکاتی برای به حداکثر رساندن سطوح رایگان

- Caching پیادهسازی کن. پاسخها را برای query های یکسان یا مشابه cache کن تا فراخوانیهای API کاهش یابد.

- از مدلهای کوچکتر برای کارهای ساده استفاده کن. مدل 8B فرمتبندی ساده، خلاصهسازی و استخراج را خوب مدیریت میکند. مدلهای ۷۰B+ را برای استدلال پیچیده نگهدار.

- درخواستها را batch کن. اگر API پشتیبانی میکند، چندین پرامپت را در یک درخواست batch کن.

- fallback تنظیم کن. اگر یک ارائهدهنده rate-limit کرد، بهطور خودکار به دیگری fallback کن.

- یک مدل محلی برای توسعه اجرا کن. در طول توسعه از Ollama محلی استفاده کن و برای تولید به ارائهدهنده cloud سوییچ کن.

- مصرف را نظارت کن. فراخوانیهای API را ردیابی کن تا از هزینههای غافلگیرکننده وقتی اعتبارهای رایگان تمام میشوند جلوگیری کنی.

جمعبندی

موجودیت APIهای رایگان و منبع باز LLM در ۲۰۲۶ یعنی هر توسعهدهندهای میتواند بدون هزینههای اولیه قابل توجه اپلیکیشنهای مبتنی بر هوش مصنوعی بسازد. Groq و Cerebras inference رایگان با سرعت بالا ارائه میدهند، Google AI Studio پنجرههای context بزرگ فراهم میکند، و Ollama مصرف محلی نامحدود میدهد. چندین ارائهدهنده را ترکیب کن تا یک زیرساخت هوش مصنوعی قوی و مقرونبهصرفه بسازی.

توسعهدهندگان ایرانی میتوانند به Hypereal به عنوان یک بازیگر منطقهای نگاه کنند: بدون موانع تحریم، API یکپارچهای که تصویر، ویدیو، صدا و آواتار را پوشش میدهد، و قیمتگذاری pay-as-you-go بدون اشتراک اجباری.

اگر اپلیکیشنت علاوه بر LLM به رسانه تولیدشده با هوش مصنوعی — تصویر، ویدیو، صدا یا آواتارهای ناطق — نیاز دارد، Hypereal AI را برای یک API یکپارچه با قیمتگذاری pay-as-you-go و اعتبارهای شروع رایگان بررسی کن.

Hypereal AI را رایگان امتحان کن — ۳۵ اعتبار، بدون نیاز به کارت اعتباری.

مقالات مرتبط

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.