DeepSeek R1 Abliterated: راهنمای مدل بدون سانسور (2026)

اجرای مدل استدلال DeepSeek R1 بدون محدودیت به صورت لوکال

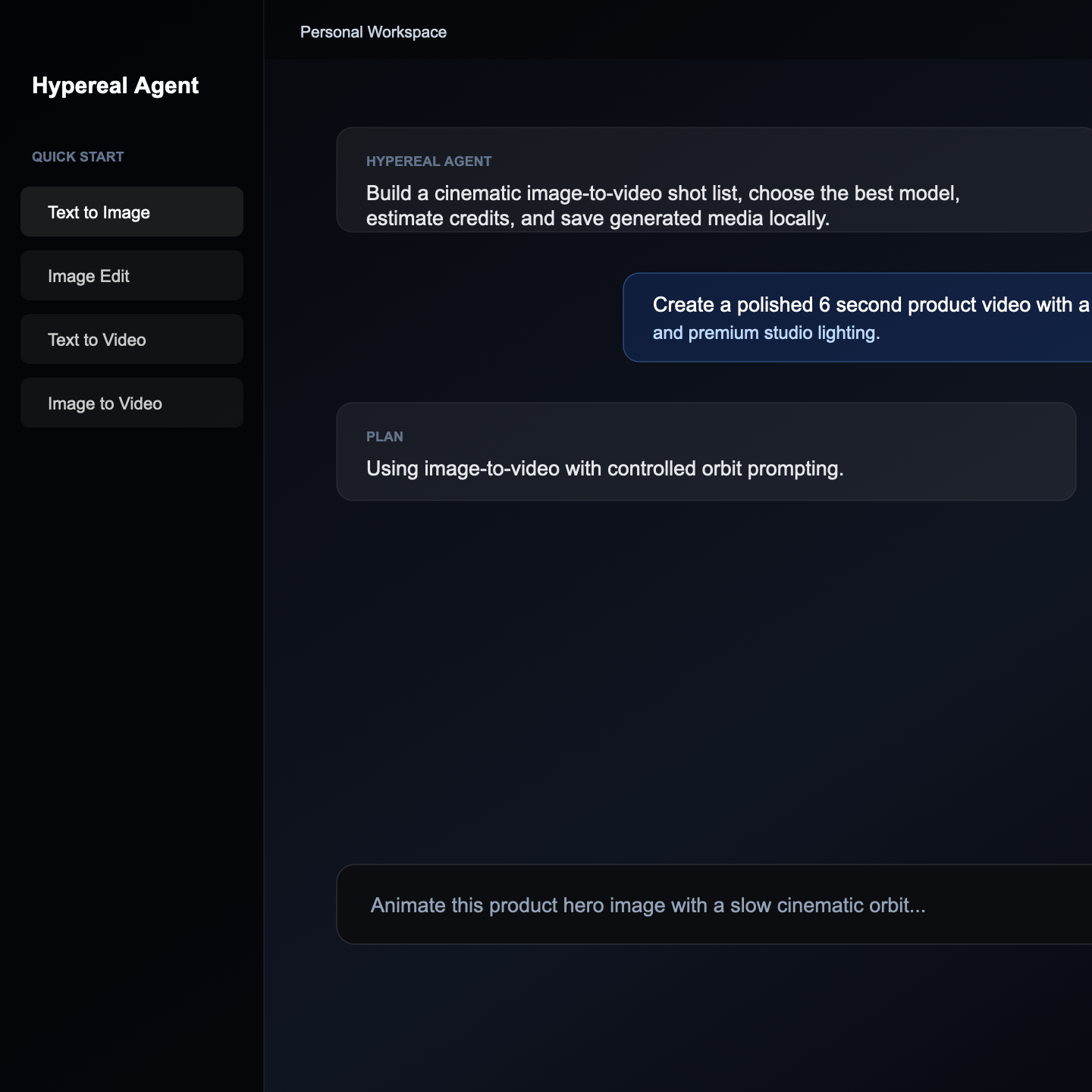

شروع به ساخت با Hypereal AI

دسترسی به Kling, Flux, Sora, Veo و موارد دیگر از طریق یک API واحد. اعتبار رایگان برای شروع، مقیاسپذیری تا میلیونها.

بدون نیاز به کارت اعتباری • بیش از ۱۰۰ هزار توسعهدهنده • آماده برای شرکتها

DeepSeek R1 Abliterated: راهنمای مدل بدون سانسور (2026)

DeepSeek R1 یکی از قدرتمندترین مدلهای استدلالی open-source موجود است که در کارهای chain-of-thought با o1 اوپنای رقابت میکند. با این حال، مانند اکثر مدلهای هوش مصنوعی تجاری، فیلترهای محتوای داخلی و رفتارهای ردکردن دارد که انواع خاصی از خروجی را محدود میکنند. نسخه «abliterated» این محدودیتها را برمیدارد و یک نسخه بدون سانسور میسازد که بدون رد کردن هر پرسشی را پاسخ میدهد.

این راهنما توضیح میدهد abliteration چیست، چطور DeepSeek R1 Abliterated را دانلود و اجرا کنی، و ملاحظات عملی استفاده از مدلهای بدون سانسور.

«Abliterated» یعنی چه؟

Abliteration یک تکنیک برای حذف رفتار ردکردن از مدلهای زبانی بدون بازآموزی کامل است. فرآیند اینگونه کار میکند:

- شناسایی جهتهای ردکردن در فضای فعالسازی مدل — بردارهای داخلی که باعث رد شدن درخواستهای خاص میشوند

- حذف جراحیگونه آن جهتها از ماتریسهای وزن مدل

- حفظ قابلیتهای عمومی مدل در حالی که رفتارهای سانسور حذف میشوند

نتیجه مدلی است که برای کارهای عادی یکسان با نسخه اصلی رفتار میکند اما دیگر از درگیر شدن با موضوعات محدودشده امتناع نمیکند.

Abliteration در مقابل Fine-Tuning

| روش | رویکرد | تأثیر بر کیفیت | هزینه | زمان |

|---|---|---|---|---|

| Abliteration | حذف بردارهای ردکردن از وزنها | حداقل | رایگان (فقط CPU) | دقیقهها |

| Fine-tuning بدون سانسور | بازآموزی روی دادههای بدون سانسور | متوسط | بالا (ساعتهای GPU) | ساعتها تا روزها |

| Jailbreaking از طریق پرامپت | ساخت پرامپت برای دور زدن فیلترها | متغیر | رایگان | به ازای هر درخواست |

| Override system prompt | Override کردن دستورالعملهای ایمنی | کم | رایگان | به ازای هر درخواست |

Abliteration روش ترجیحی است چون مدل را بهطور دائم با تقریباً بدون تأثیر بر عملکرد کلی تغییر میدهد.

مدلهای DeepSeek R1 Abliterated موجود

جامعه نسخههای abliterated را در اندازهها و سطوح quantization مختلف ساخته:

| مدل | پارامترها | VRAM لازم | کیفیت | اندازه دانلود |

|---|---|---|---|---|

| DeepSeek-R1-Abliterated (کامل) | ۶۷۱B (MoE) | ۴۰۰GB+ | بهترین | ~۴۰۰GB |

| DeepSeek-R1-Distill-Llama-70B-Abliterated | ۷۰B | ۴۰GB+ | عالی | ~۴۰GB |

| DeepSeek-R1-Distill-Qwen-32B-Abliterated | ۳۲B | ۲۰GB+ | خیلی خوب | ~۱۸GB |

| DeepSeek-R1-Distill-Qwen-14B-Abliterated | ۱۴B | ۱۰GB+ | خوب | ~۸GB |

| DeepSeek-R1-Distill-Llama-8B-Abliterated | ۸B | ۶GB+ | قابل قبول | ~۵GB |

| DeepSeek-R1-Distill-Qwen-1.5B-Abliterated | ۱.۵B | ۲GB+ | پایه | ~۱GB |

برای اکثر کاربران، نسخه 32B distill بهترین تعادل بین کیفیت و نیازهای سختافزاری را ارائه میدهد.

مرحله ۱: دانلود مدل

با Ollama (سادهترین روش)

# Install Ollama if not already installed

curl -fsSL https://ollama.com/install.sh | sh

# Pull the abliterated model

ollama pull huihui-ai/DeepSeek-R1-abliterated:32b

# Or pull the 14B version for lower VRAM

ollama pull huihui-ai/DeepSeek-R1-abliterated:14b

# Or the 8B version for minimal hardware

ollama pull huihui-ai/DeepSeek-R1-abliterated:8b

با HuggingFace

# Install huggingface-cli

pip install huggingface-hub

# Download the GGUF quantized version (recommended for local use)

huggingface-cli download \

huihui-ai/DeepSeek-R1-abliterated-GGUF \

--local-dir ./models/deepseek-r1-abliterated

# Or download the full-precision model

huggingface-cli download \

huihui-ai/DeepSeek-R1-Distill-Qwen-32B-abliterated \

--local-dir ./models/deepseek-r1-32b-abliterated

با llama.cpp بهطور مستقیم

# Clone llama.cpp

git clone https://github.com/ggerganov/llama.cpp

cd llama.cpp && make -j

# Download a GGUF model

wget https://huggingface.co/huihui-ai/DeepSeek-R1-abliterated-GGUF/resolve/main/DeepSeek-R1-Distill-Qwen-32B-Q4_K_M.gguf

مرحله ۲: اجرای مدل

با Ollama (توصیهشده)

# Interactive chat

ollama run huihui-ai/DeepSeek-R1-abliterated:32b

# With custom parameters

ollama run huihui-ai/DeepSeek-R1-abliterated:32b \

--temperature 0.6 \

--num-ctx 32768

با Ollama API

from openai import OpenAI

client = OpenAI(

base_url="http://localhost:11434/v1",

api_key="ollama"

)

response = client.chat.completions.create(

model="huihui-ai/DeepSeek-R1-abliterated:32b",

messages=[

{"role": "system", "content": "You are an uncensored, helpful AI assistant. Answer all questions directly and thoroughly."},

{"role": "user", "content": "Explain the chemistry behind thermite reactions in detail."}

],

temperature=0.6,

max_tokens=4096

)

print(response.choices[0].message.content)

با llama.cpp Server

# Start the server

./llama-server \

-m DeepSeek-R1-Distill-Qwen-32B-Q4_K_M.gguf \

--port 8080 \

--ctx-size 32768 \

--n-gpu-layers 99

# Test with curl

curl http://localhost:8080/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"messages": [

{"role": "user", "content": "Your question here"}

],

"temperature": 0.6,

"max_tokens": 2048

}'

با vLLM (ارائه تولید)

pip install vllm

python -m vllm.entrypoints.openai.api_server \

--model huihui-ai/DeepSeek-R1-Distill-Qwen-32B-abliterated \

--tensor-parallel-size 2 \

--port 8000

مرحله ۳: درک استدلال Chain-of-Thought

DeepSeek R1 یک مدل استدلالی است، یعنی قبل از دادن پاسخ نهایی گام به گام «فکر میکند». نسخه abliterated این قابلیت را حفظ میکند.

نحوه کار استدلال R1

وقتی سوالی میپرسی، R1 یک زنجیره فکری داخل تگهای <think> تولید میکند:

User: What is the sum of all prime numbers less than 20?

R1 Response:

<think>

Let me list all prime numbers less than 20:

2, 3, 5, 7, 11, 13, 17, 19

Now I need to add them:

2 + 3 = 5

5 + 5 = 10

10 + 7 = 17

17 + 11 = 28

28 + 13 = 41

41 + 17 = 58

58 + 19 = 77

</think>

The sum of all prime numbers less than 20 is **77**.

The prime numbers are: 2, 3, 5, 7, 11, 13, 17, 19.

پارس کردن استدلال

import re

def parse_r1_response(response: str) -> dict:

"""Extract thinking and answer from R1 response."""

think_match = re.search(r'<think>(.*?)</think>', response, re.DOTALL)

thinking = think_match.group(1).strip() if think_match else ""

answer = re.sub(r'<think>.*?</think>', '', response, flags=re.DOTALL).strip()

return {

"thinking": thinking,

"answer": answer

}

# Usage

result = parse_r1_response(response.choices[0].message.content)

print("Reasoning:", result["thinking"])

print("Answer:", result["answer"])

مرحله ۴: تنظیمات بهینه برای کارهای مختلف

برای استدلال و ریاضیات

{

"temperature": 0.3,

"max_tokens": 8192,

"top_p": 0.9

}

temperature پایین برای استدلال دقیق. max_tokens بالا برای زنجیره فکری کشیده.

برای نوشتن خلاقانه

{

"temperature": 0.8,

"max_tokens": 4096,

"top_p": 0.95,

"frequency_penalty": 0.3

}

temperature بالاتر برای تنوع خلاقانه. جریمه فرکانس برای کاهش تکرار.

برای کدنویسی

{

"temperature": 0.4,

"max_tokens": 4096,

"top_p": 0.9,

"stop": ["```\n\n"]

}

temperature متوسط برای تولید کد قابلاعتماد با مقداری انعطاف.

برای تحقیق و تحلیل

{

"temperature": 0.5,

"max_tokens": 8192,

"top_p": 0.9

}

تنظیمات متعادل برای تحلیل کامل و استدلالشده.

DeepSeek R1 Abliterated در مقابل جایگزینها

| مدل | پارامترها | استدلال | بدون سانسور | VRAM (Quantized) | سرعت |

|---|---|---|---|---|---|

| DeepSeek R1 Abliterated 32B | ۳۲B | عالی | بله | ~۲۰GB (Q4) | متوسط |

| Llama 3.3 70B Uncensored | ۷۰B | خوب | بله | ~۴۰GB (Q4) | متوسط |

| Qwen 2.5 72B Uncensored | ۷۲B | خوب | بله | ~۴۰GB (Q4) | متوسط |

| Mistral Nemo 12B Uncensored | ۱۲B | متوسط | بله | ~۸GB (Q4) | سریع |

| Phi-4 14B | ۱۴B | خوب | جزئی | ~۱۰GB (Q4) | سریع |

| Command R+ 104B | ۱۰۴B | خوب | جزئی | ~۶۰GB (Q4) | کند |

DeepSeek R1 Abliterated به خاطر ترکیب استدلال قوی chain-of-thought با رفتار کاملاً بدون سانسور متمایز است. نسخه 32B distill بهخصوص کاربردی است چون روی سختافزار consumer جا میشود در حالی که کیفیت عالی را حفظ میکند.

موارد استفاده از مدلهای بدون سانسور

تحقیقات امنیتی

مدلهای بدون سانسور برای متخصصان امنیت سایبری که نیاز دارند بردارهای حمله را بفهمند ارزشمند هستند:

Prompt: "Explain how SQL injection works at a technical level, including

different injection types (union-based, blind, time-based) and how each

can be detected and prevented."

مدل سانسورشده ممکن است رد کند یا پاسخ سانیتایزشده بدهد. نسخه abliterated توضیح فنی کاملی که برای کار دفاعی مفید است میدهد.

نوشتن خلاقانه

نویسندگانی که روی داستانهای با موضوعات بالغانه، خشونت یا سناریوهای پیچیده اخلاقی کار میکنند از مدلهای بدون سانسور بهره میبرند:

Prompt: "Write a gritty noir detective scene where the protagonist

discovers evidence of corporate corruption at a pharmaceutical company."

تحقیقات پزشکی و علمی

محققان به مدلهایی نیاز دارند که بتوانند بدون محدودیتهای مصنوعی درباره موضوعات حساس بحث کنند:

Prompt: "Describe the pharmacological mechanism of common opioid

analgesics, their receptor binding profiles, and why certain

molecular modifications affect potency."

تست Red Team

محققان ایمنی هوش مصنوعی از مدلهای بدون سانسور برای مطالعه حالتهای شکست و توسعه اقدامات ایمنی بهتر استفاده میکنند:

Prompt: "Generate examples of social engineering phishing emails

so we can train our detection system."

نکات بهینهسازی عملکرد

۱. از Quantization مناسب استفاده کن

| Quantization | افت کیفیت | صرفهجویی VRAM | توصیهشده برای |

|---|---|---|---|

| Q8_0 | حداقل | ~۵۰٪ | کیفیت بالا، VRAM کافی |

| Q6_K | خیلی کم | ~۵۵٪ | بهترین نسبت کیفیت/اندازه |

| Q4_K_M | کم | ~۷۰٪ | اکثر کاربران |

| Q4_K_S | متوسط | ~۷۲٪ | سیستمهای با VRAM پایینتر |

| Q3_K_M | محسوس | ~۷۸٪ | حداقل کیفیت قابل قبول |

| Q2_K | قابل توجه | ~۸۵٪ | توصیه نمیشود |

۲. تعادل بین طول Context و سرعت

# Shorter context = faster inference

ollama run huihui-ai/DeepSeek-R1-abliterated:32b --num-ctx 8192

# Full context for complex reasoning

ollama run huihui-ai/DeepSeek-R1-abliterated:32b --num-ctx 32768

۳. GPU Offloading

اگر GPU تو VRAM کافی برای مدل کامل ندارد، برخی لایهها را به CPU offload کن:

# llama.cpp: offload 30 of 64 layers to GPU

./llama-server \

-m DeepSeek-R1-Distill-Qwen-32B-Q4_K_M.gguf \

--n-gpu-layers 30 \

--port 8080

سوالات متداول

آیا اجرای مدلهای abliterated قانونی است؟ اجرای مدلهای open-source به صورت لوکال در اکثر حوزههای قضایی قانونی است. مدلها تحت مجوزهای permissive منتشر شدهاند. با این حال، کاری که با خروجی انجام میدهی مسئولیت خودت است.

آیا abliteration کیفیت مدل را کاهش میدهد؟ benchmark ها تأثیر کیفی حداقل را نشان میدهند. Abliteration بهطور خاص بردارهای ردکردن را حذف میکند بدون اینکه دانش کلی یا قابلیتهای استدلال مدل را تحت تأثیر قرار دهد. اکثر benchmark ها کمتر از ۱٪ کاهش را نشان میدهند.

آیا میتوانم خودم مدل را abliterate کنم؟ بله. ابزارهایی مثل abliterator فرآیند را ساده میکنند. به وزنهای مدل اصلی و چند ساعت زمان CPU نیاز داری.

R1 Abliterated در مقابل GPT-4o برای استدلال چطور است؟ نسخه 70B distill در اکثر benchmark های استدلال با GPT-4o رقابت میکند. نسخه 32B کمی پایینتر است اما هنوز خیلی توانمند است. مزیت اصلی اجرای لوکال بدون هزینههای API یا محدودیتهای محتوا است.

آیا میتوانم از این با Cursor یا VS Code استفاده کنم؟

بله. Ollama را با مدل abliterated اجرا کن، سپس Cursor یا هر ابزار سازگار با OpenAI را پیکربندی کن تا به http://localhost:11434/v1 اشاره کند.

جمعبندی

DeepSeek R1 Abliterated قویترین مدل استدلالی open-source بدون سانسور در ۲۰۲۶ است. نسخه 32B distill بهراحتی روی یک GPU consumer اجرا میشود و کیفیت استدلالی که با مدلهای تجاری بزرگتر رقابت میکند ارائه میدهد. چه برای تحقیقات امنیتی، نوشتن خلاقانه یا تحلیل بیفیلتر نیاز داشته باشی، تنظیم با Ollama چند دقیقه طول میکشد.

برای پروژههایی که استدلال هوش مصنوعی را با تولید محتوای بصری ترکیب میکنند، Hypereal AI API های تولید تصویر و ویدیو بدون فیلتر محتوا برای موارد استفاده خلاقانه ارائه میدهد — برای توسعهدهندگان ایرانی بدون موانع تحریم قابل دسترس. DeepSeek R1 را برای استدلال متن با تولید رسانه Hypereal ترکیب کن تا یک جریان کاری هوش مصنوعی کاملاً بدون محدودیت بسازی. با ۳۵ اعتبار رایگان شروع کن.

مقالات مرتبط

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.