۱۰ مدل زبانی برتر بدون محدودیت در ۲۰۲۶

مدلهای هوش مصنوعی بدون سانسور که میتوانید بهصورت محلی اجرا کنید

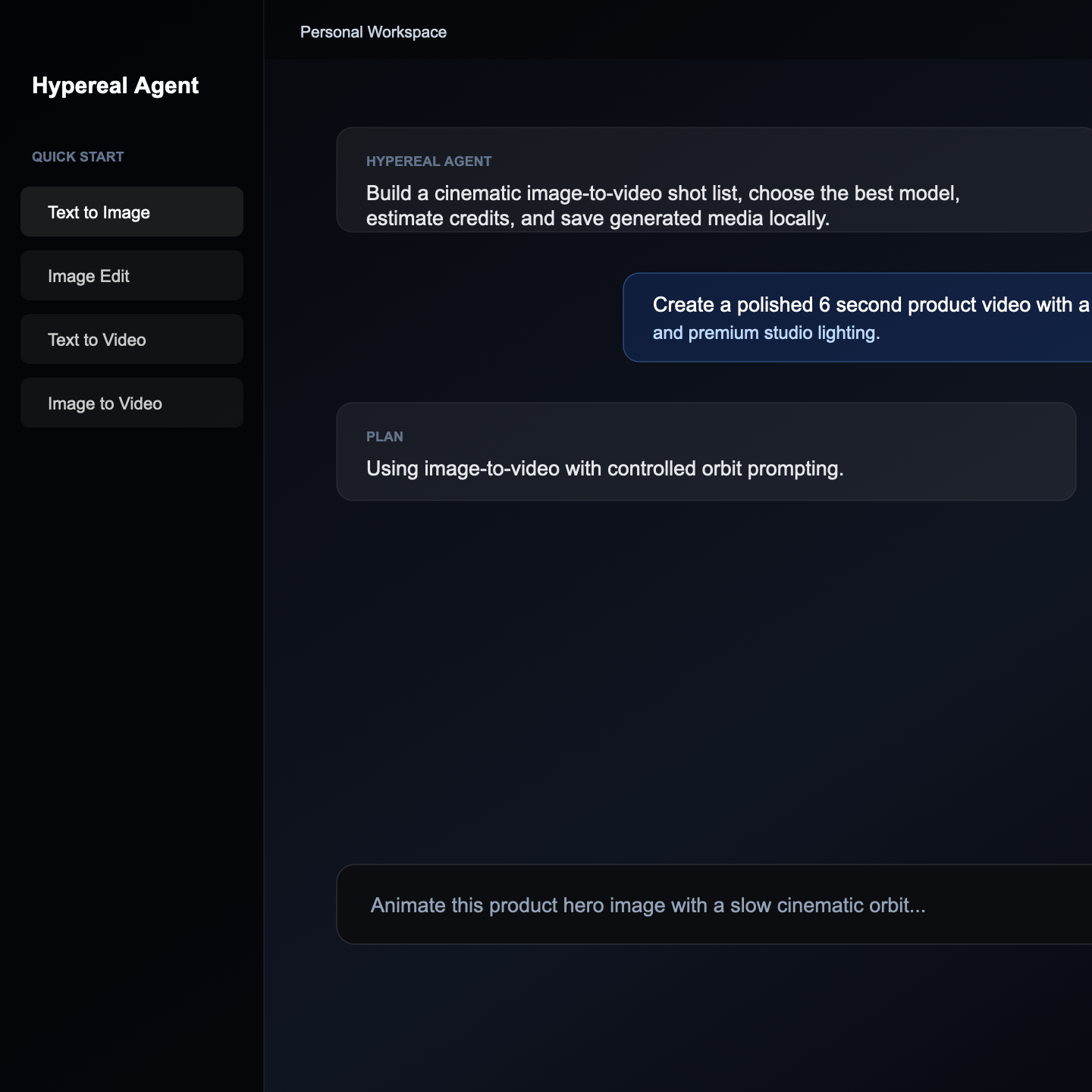

شروع به ساخت با Hypereal AI

دسترسی به Kling, Flux, Sora, Veo و موارد دیگر از طریق یک API واحد. اعتبار رایگان برای شروع، مقیاسپذیری تا میلیونها.

بدون نیاز به کارت اعتباری • بیش از ۱۰۰ هزار توسعهدهنده • آماده برای شرکتها

۱۰ مدل زبانی برتر بدون محدودیت در ۲۰۲۶

اکثر مدلهای زبانی تجاری مثل ChatGPT، Claude و Gemini دارای فیلترهای محتوایی و محدودیتهای ایمنی هستند که برخی خروجیها را مسدود میکنند. برای محققان، نویسندگان خلاق، متخصصان امنیت و توسعهدهندگانی که به مدلهای زبانی بدون محدودیت نیاز دارند، اکوسیستم رو به رشدی از مدلهای متنباز وجود دارد که میتوان آنها را بدون سانسور بهصورت محلی اجرا کرد.

این راهنما ۱۰ مدل زبانی برتر بدون محدودیت موجود در ۲۰۲۶، نحوه اجرای آنها بهصورت محلی، و کاربردهای عملی آنها را پوشش میدهد.

چرا از مدلهای زبانی بدون محدودیت استفاده کنیم؟

دلایل مشروع متعددی برای استفاده از مدلهای بدون سانسور وجود دارد:

- تحقیقات امنیتی: تست نفوذ، red-teaming و تحلیل آسیبپذیری به مدلهایی نیاز دارند که بتوانند آزادانه درباره موضوعات امنیتی بحث کنند.

- نوشتن خلاق: نویسندگان داستان به مدلهایی نیاز دارند که از نوشتن تعارض، شخصیتهای پیچیده اخلاقی یا مضامین بزرگسالانه سر باز نزنند.

- تحقیقات پزشکی و حقوقی: متخصصان به اطلاعات فیلتر نشده درباره موضوعات حساس نیاز دارند.

- تحقیقات دانشگاهی: مطالعه تعصب، همراستایی و رفتار مدل نیازمند دسترسی به خروجیهای فیلتر نشده است.

- حریم خصوصی: اجرای مدلها بهصورت محلی یعنی دادههای شما هرگز از دستگاه شما خارج نمیشوند.

۱۰ مدل زبانی برتر بدون محدودیت (۲۰۲۶)

۱. Dolphin Mixtral (8x22B / 8x7B)

Dolphin یکی از شناختهشدهترین خانواده مدلهای بدون سانسور است. نسخههای مبتنی بر Mixtral استدلال عالی با هیچ فیلتر محتوایی ارائه میدهند.

| مشخصه | Dolphin Mixtral 8x22B | Dolphin Mixtral 8x7B |

|---|---|---|

| پارامترها | 141B (فعال: 39B) | 46.7B (فعال: 12.9B) |

| VRAM مورد نیاز | 80GB+ (Q4) | 24GB (Q4) |

| بهترین برای | استدلال پیچیده | استفاده عمومی |

| مجوز | Apache 2.0 | Apache 2.0 |

# اجرا با Ollama

ollama pull dolphin-mixtral:8x22b

ollama run dolphin-mixtral:8x22b

۲. Nous Hermes 2 (Llama 3.1 70B / 8B)

مدلهای Hermes از Nous Research برای مفید بودن بدون رد کردنهای مصنوعی تنظیم دقیق شدهاند. دستورالعملها را وفادارانه دنبال میکنند و با پرامپتهای پیچیده به خوبی کار میکنند.

ollama pull nous-hermes2:70b

ollama run nous-hermes2:70b

۳. WizardLM Uncensored (اندازههای مختلف)

WizardLM Uncensored با استفاده از فرآیندی به نام "uncensoring" — که در آن الگوهای امتناع از مدل حذف میشوند در حالی که تواناییها حفظ میشوند — آموزش همراستایی را از مدلهای WizardLM حذف میکند.

ollama pull wizardlm-uncensored:13b

ollama run wizardlm-uncensored:13b

۴. Midnight Miqu (70B)

یک مدل توسعهیافته توسط جامعه بر اساس وزنهای Mistral، Midnight Miqu برای تواناییهای قوی نوشتن خلاق و حداقل محدودیتهای محتوایی شناخته شده است. در داستانهای بلند و سناریوهای نقشآفرینی برتری دارد.

| مشخصه | جزئیات |

|---|---|

| پارامترها | 70B |

| VRAM مورد نیاز | 40GB+ (Q4_K_M) |

| بهترین برای | نوشتن خلاق، داستان |

| پنجره زمینه | 32K توکن |

۵. Command R+ Uncensored

بر اساس معماری Command R+ از Cohere، نسخههای بدون سانسور ساخته جامعه تواناییهای چندزبانه قوی بدون فیلترهای محتوایی ارائه میدهند. به خصوص برای تحقیقات و وظایف تحلیلی مناسب است.

ollama pull command-r-plus

# نسخههای کوانتیزه بدون سانسور توسط جامعه در HuggingFace موجود است

۶. Qwen 2.5 72B (Abliterated)

مدلهای abliterated از تکنیکی استفاده میکنند که جهت امتناع را از فضای فعالسازی مدل بدون آموزش مجدد حذف میکند. نسخههای abliterated شده Qwen 2.5 استدلال قوی مدل اصلی را با حذف رفتارهای امتناع حفظ میکنند.

# از HuggingFace دانلود کنید و برای Ollama تبدیل کنید

# به دنبال "qwen2.5-72b-abliterated" در HuggingFace بگردید

ollama create qwen25-abliterated -f Modelfile

۷. DeepSeek V3 (فاینتیونهای بدون سانسور)

مدل V3 از DeepSeek (671B MoE) توسط جامعه برای حذف محدودیتهای محتوایی همراستا با دولت چین تنظیم دقیق شده است. این نسخهها برای کاربرانی که کدنویسی و استدلال قوی DeepSeek را بدون سانسور سیاسی میخواهند محبوب هستند.

۸. Llama 3.3 70B (Abliterated)

Llama 3.3 از Meta یکی از قویترین مدلهای متنباز است. نسخههای abliterated شده آموزش ایمنی را حذف میکنند در حالی که تواناییهای چشمگیر مدل را دست نخورده نگه میدارند.

# از طریق کوانتیزاسیونهای GGUF جامعه در دسترس است

ollama pull llama3.3:70b

# سپس وزنهای abliterated را از طریق Modelfile سفارشی اعمال کنید

۹. Yi 1.5 34B (Uncensored)

خانواده مدل Yi از 01.AI توسط جامعه بدون سانسور شده است. نسخه 34B نقطه شیرینی از کیفیت و نیازمندیهای سختافزاری ایجاد میکند و با کوانتیزاسیون Q4 در یک GPU تکی با 24GB جا میشود.

ollama pull yi:34b

۱۰. Mistral Small (24B) فاینتیونهای بدون سانسور

مدل Small از Mistral توسط جامعه برای استفاده بدون محدودیت تنظیم دقیق شده است. با 24B پارامتر روی سختافزار مصرفی به خوبی اجرا میشود و عملکرد مناسبی در وظایف مختلف ارائه میدهد.

ollama pull mistral-small:24b

# نسخههای بدون سانسور توسط جامعه در HuggingFace موجود است

نحوه اجرای مدلهای زبانی بدون محدودیت بهصورت محلی با Ollama

Ollama سادهترین راه برای اجرای مدلهای محلی است. در اینجا یک راهنمای کامل نصب آمده است:

مرحله ۱: نصب Ollama

# macOS / Linux

curl -fsSL https://ollama.ai/install.sh | sh

# ویندوز: از ollama.ai دانلود کنید

# تأیید نصب

ollama --version

مرحله ۲: دانلود و اجرای مدل

# دانلود مدل (یک بار دانلود میشود، بعداً دوباره استفاده میشود)

ollama pull dolphin-mixtral:8x7b

# اجرای تعاملی

ollama run dolphin-mixtral:8x7b

# اجرا به عنوان سرور API

ollama serve

# API اکنون در http://localhost:11434 در دسترس است

مرحله ۳: استفاده از API

import requests

response = requests.post(

"http://localhost:11434/api/generate",

json={

"model": "dolphin-mixtral:8x7b",

"prompt": "Explain how buffer overflow attacks work in detail.",

"stream": False

}

)

print(response.json()["response"])

مرحله ۴: استفاده با رابط وب

برای یک رابط شبیه ChatGPT با مدلهای محلی:

# نصب Open WebUI (قبلاً Ollama WebUI)

docker run -d -p 3000:8080 \

--add-host=host.docker.internal:host-gateway \

-v open-webui:/app/backend/data \

--name open-webui \

ghcr.io/open-webui/open-webui:main

http://localhost:3000 را باز کنید و به نمونه Ollama خود متصل شوید. یک رابط چت کامل با تاریخچه مکالمه، تغییر مدل و موارد دیگر دارید.

مقایسه نیازمندیهای سختافزاری

| مدل | پارامترها | Q4 VRAM | Q8 VRAM | حداقل GPU |

|---|---|---|---|---|

| Dolphin Mixtral 8x7B | 46.7B | 24GB | 48GB | RTX 4090 |

| Nous Hermes 2 8B | 8B | 5GB | 9GB | RTX 3060 |

| Nous Hermes 2 70B | 70B | 40GB | 75GB | 2x RTX 4090 |

| WizardLM 13B | 13B | 8GB | 14GB | RTX 3070 |

| Qwen 2.5 72B | 72B | 42GB | 78GB | 2x RTX 4090 |

| Yi 34B | 34B | 20GB | 36GB | RTX 4090 |

| Mistral Small 24B | 24B | 14GB | 26GB | RTX 4080 |

| Llama 3.3 8B | 8B | 5GB | 9GB | RTX 3060 |

GPU ندارید؟ از استنتاج CPU استفاده کنید. Ollama از حالت CPU-only پشتیبانی میکند. کند است (۱ تا ۵ توکن در ثانیه برای مدلهای 7B) اما کار میکند:

# اجبار به حالت CPU

OLLAMA_NUM_GPU=0 ollama run nous-hermes2:8b

گزینههای ابری برای اجرای مدلهای بدون محدودیت

اگر سختافزار مناسب ندارید، میتوانید GPU اجاره کنید:

| ارائهدهنده | GPU | قیمت در ساعت | بهترین برای |

|---|---|---|---|

| RunPod | RTX 4090 | $0.44 | آزمایشهای سریع |

| Vast.ai | RTX 4090 | $0.30 | اجرای بودجهای |

| Lambda | A100 80GB | $1.25 | مدلهای بزرگ |

| Together AI | دسترسی API | پرداخت به ازای توکن | بدون نیاز به راهاندازی |

ملاحظات قانونی و ایمنی

اجرای مدلهای بدون محدودیت در اکثر حوزههای قضایی قانونی است، اما شما مسئول نحوه استفاده از آنها هستید. چند راهنما:

- محتوای غیرقانونی تولید نکنید. مدلهای بدون محدودیت هنوز میتوانند خروجیهای مضر تولید کنند. شما از نظر قانونی مسئول آنچه با خروجی انجام میدهید هستید.

- برای اهداف مشروع استفاده کنید. تحقیقات امنیتی، نوشتن خلاق و کار دانشگاهی همه کاربردهای مشروع هستند.

- هنگام کار با دادههای حساس، مدلها را محلی نگه دارید. یکی از مزایای اصلی مدلهای محلی این است که پرامپتهای شما هرگز از دستگاه شما خارج نمیشوند.

جمعبندی

اکوسیستم متنباز LLM مدلهای قدرتمندی بدون محدودیت برای کاربرانی ارائه میدهد که به انعطافپذیری بیشتری نسبت به APIهای تجاری نیاز دارند. با ابزارهایی مثل Ollama و Open WebUI، اجرای این مدلها بهصورت محلی حتی روی سختافزار مصرفی ساده است.

برای تولید رسانه با هوش مصنوعی مانند تصویر، ویدیو و آواتارهای ناطق با سیاستهای محتوایی انعطافپذیر، Hypereal AI را رایگان امتحان کنید — ۳۵ کردیت، بدون نیاز به کارت اعتباری. Hypereal برای توسعهدهندگان ایرانی بدون نگرانی از تحریم در دسترس است و مکمل LLMهای محلی با ارائه APIهای تولید رسانه ابری است.

مقالات مرتبط

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.