نحوه راهاندازی LM Studio MCP Server (۲۰۲۶)

استفاده از LM Studio به عنوان سرور MCP برای فراخوانی ابزار با هوش مصنوعی

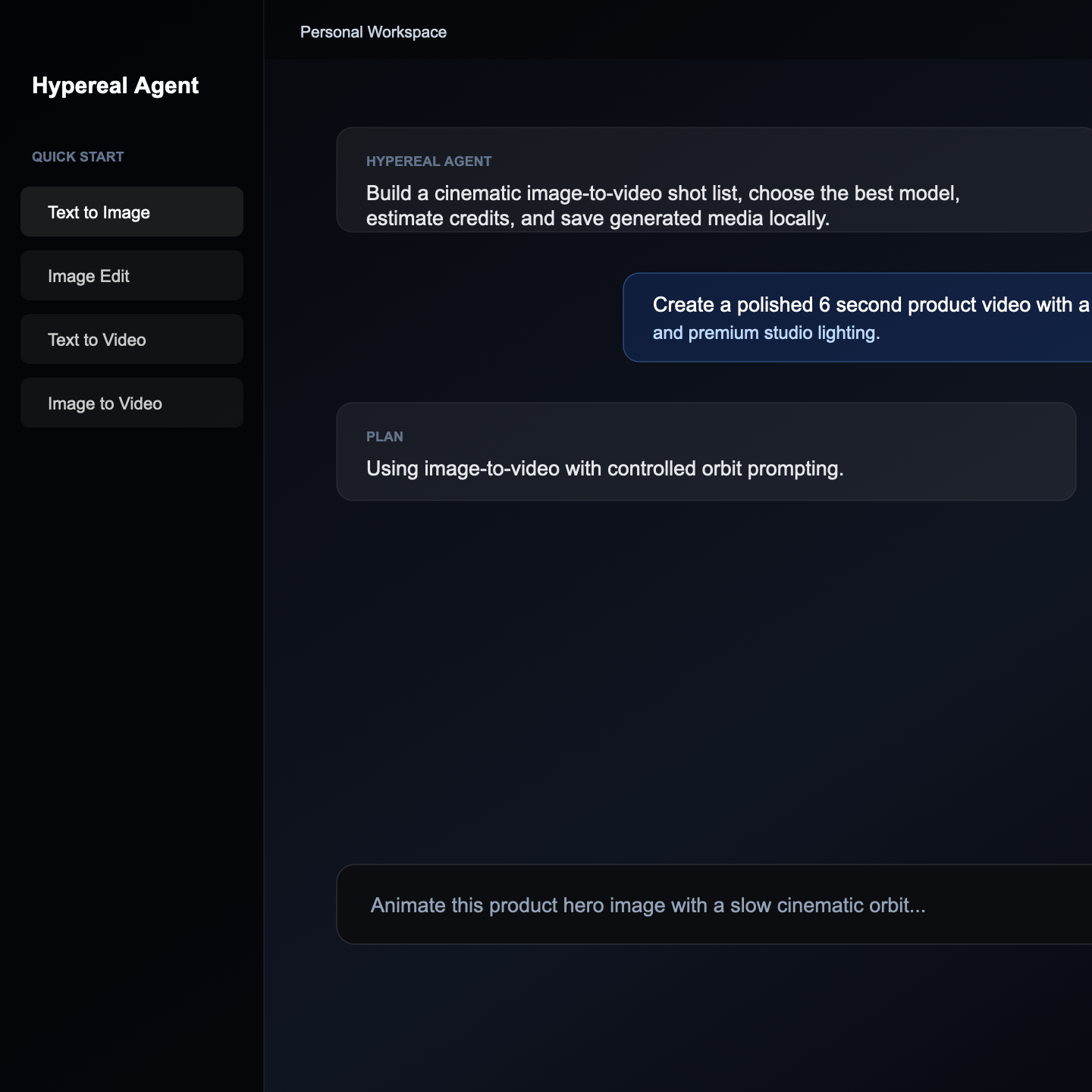

شروع به ساخت با Hypereal AI

دسترسی به Kling, Flux, Sora, Veo و موارد دیگر از طریق یک API واحد. اعتبار رایگان برای شروع، مقیاسپذیری تا میلیونها.

بدون نیاز به کارت اعتباری • بیش از ۱۰۰ هزار توسعهدهنده • آماده برای شرکتها

نحوه راهاندازی LM Studio MCP Server (۲۰۲۶)

LM Studio به شما اجازه میدهد مدلهای زبانی بزرگ را بهصورت محلی با یک رابط دسکتاپ شیک اجرا کنید. با پشتیبانی از MCP (پروتکل زمینه مدل)، اکنون میتوانید مدلهای محلی LM Studio را به کلاینتهای MCP متصل کنید، یا از LM Studio خود به عنوان کلاینت MCP که به سرورهای MCP خارجی متصل میشود استفاده کنید. این راهنما هر دو جهت را پوشش میدهد: استفاده از LM Studio به عنوان سرور MCP برای سایر کلاینتها، و اتصال سرورهای ابزار MCP به LM Studio.

LM Studio چیست؟

LM Studio یک برنامه دسکتاپ برای اجرای مدلهای زبانی متنباز بهصورت محلی در macOS، Windows و Linux است. رابط کاربری راحتی برای دانلود مدلها از Hugging Face، پیکربندی پارامترهای استنتاج و اجرای یک سرور API محلی فراهم میکند. ویژگیهای کلیدی عبارتند از:

- دانلود مدل با یک کلیک از Hugging Face

- شتابدهنده GPU (NVIDIA، AMD، Apple Silicon)

- سرور API محلی سازگار با OpenAI

- رابط چت داخلی با مدیریت مکالمه

- کوانتیزاسیون مدل و کنترل پارامتر

MCP چیست؟

MCP (پروتکل زمینه مدل) یک استاندارد باز از Anthropic است که مدلهای هوش مصنوعی را به ابزارها و منابع داده خارجی متصل میکند. در زمینه LM Studio، MCP دو جریان کاری را فعال میکند:

- LM Studio به عنوان سرور MCP: سایر برنامهها از طریق پروتکل MCP به LLM محلی LM Studio متصل میشوند

- LM Studio به عنوان کلاینت MCP: LM Studio به سرورهای ابزار MCP (سیستم فایل، پایگاه داده، APIها) متصل میشود تا مدلهای محلی شما بتوانند از ابزارهای خارجی استفاده کنند

پیشنیازها

| نیازمندی | جزئیات |

|---|---|

| LM Studio | نسخه 0.3.x یا جدیدتر (پشتیبانی MCP در 0.3.6 اضافه شد) |

| RAM | حداقل 8 GB، 16+ GB توصیهشده |

| GPU (اختیاری) | NVIDIA 6+ GB VRAM یا Apple Silicon |

| فضای ذخیرهسازی | 10+ GB آزاد برای مدلها |

| Node.js | v18+ (برای سرورهای MCP سفارشی) |

بخش ۱: استفاده از API داخلی LM Studio به عنوان سرور سازگار با MCP

سرور محلی LM Studio یک API سازگار با OpenAI را در معرض نمایش میگذارد. در حالی که این یک سرور MCP بومی نیست، میتوانید با استفاده از یک پروکسی آن را به کلاینتهای MCP متصل کنید.

مرحله ۱: دانلود و نصب LM Studio

LM Studio را از lmstudio.ai برای پلتفرم خود دانلود کنید. برنامه را نصب و راهاندازی کنید.

مرحله ۲: دانلود مدل

در نوار جستجوی LM Studio، مدلی پیدا کنید که پشتیبانی خوبی از فراخوانی ابزار دارد:

- Qwen 2.5 7B Instruct — پشتیبانی عالی از فراخوانی ابزار

- Llama 3.3 8B Instruct — مدل قدرتمند برای اهداف عمومی

- Mistral 7B Instruct v0.3 — تعادل خوب سرعت و کیفیت

- Hermes 3 8B — به طور خاص برای فراخوانی تابع تنظیم دقیق شده

روی دکمه دانلود کنار مدل انتخابی کلیک کنید. منتظر تکمیل دانلود بمانید.

مرحله ۳: راهاندازی سرور محلی

- به تب Local Server در LM Studio (آیکون

<->) بروید - مدل دانلود شده خود را از منوی کشویی انتخاب کنید

- سرور را روشن کنید (ON)

- به URL سرور (پیشفرض:

http://localhost:1234) توجه کنید

سرور اکنون در حال اجرا است و درخواستهای API سازگار با OpenAI را میپذیرد.

مرحله ۴: تأیید سرور

سرور را با یک درخواست cURL تست کنید:

curl http://localhost:1234/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "qwen2.5-7b-instruct",

"messages": [

{"role": "user", "content": "Hello, are you working?"}

],

"temperature": 0.7

}'

مرحله ۵: اتصال به MCP با lmstudio-mcp-server

برای در معرض قرار دادن LM Studio به عنوان یک سرور MCP مناسب، از پل lmstudio-mcp-server جامعه استفاده کنید:

npm install -g lmstudio-mcp-server

پل را اجرا کنید:

lmstudio-mcp-server --port 1234

این یک سرور MCP ایجاد میکند که فراخوانیهای ابزار را از طریق مدل محلی LM Studio هدایت میکند.

مرحله ۶: اتصال به Claude Desktop

پل را به پیکربندی MCP Claude Desktop اضافه کنید:

macOS: ~/Library/Application Support/Claude/claude_desktop_config.json

{

"mcpServers": {

"lmstudio": {

"command": "npx",

"args": ["lmstudio-mcp-server", "--port", "1234"]

}

}

}

Claude Desktop را مجدداً راهاندازی کنید. سرور LM Studio به عنوان یک اتصال MCP موجود ظاهر میشود.

بخش ۲: اتصال سرورهای MCP به LM Studio

LM Studio نسخه 0.3.6+ از اتصال به سرورهای MCP خارجی پشتیبانی میکند و به مدلهای محلی شما توانایی استفاده از ابزارهایی مانند دسترسی به فایل، جستجوی وب یا پرسوجوی پایگاه داده را میدهد.

مرحله ۱: باز کردن تنظیمات MCP در LM Studio

- LM Studio را باز کنید

- به Settings (آیکون چرخدنده) بروید

- به بخش MCP بروید

- روی Add Server کلیک کنید

مرحله ۲: اضافه کردن سرور MCP

میتوانید سرورهای MCP را با مشخص کردن دستور اجرای آنها اضافه کنید. به عنوان مثال، برای اضافه کردن سرور MCP سیستم فایل:

{

"filesystem": {

"command": "npx",

"args": [

"-y",

"@modelcontextprotocol/server-filesystem",

"/Users/yourname/Documents"

]

}

}

مرحله ۳: اضافه کردن چندین سرور MCP

در اینجا یک پیکربندی با چندین سرور MCP مفید آمده است:

{

"filesystem": {

"command": "npx",

"args": [

"-y",

"@modelcontextprotocol/server-filesystem",

"/Users/yourname/projects"

]

},

"github": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-github"],

"env": {

"GITHUB_TOKEN": "ghp_your_github_token"

}

},

"sqlite": {

"command": "npx",

"args": [

"-y",

"@modelcontextprotocol/server-sqlite",

"/path/to/your/database.db"

]

}

}

مرحله ۴: استفاده از ابزارها در چت

پس از اضافه کردن سرورهای MCP، یک مدل با پشتیبانی از فراخوانی ابزار بارگذاری کنید (Qwen 2.5، Hermes 3 یا Llama 3.3 Instruct). در چت، مدل اکنون میتواند از ابزارهای متصل استفاده کند.

مثال تعاملات:

- "فایلهای Python موجود در پوشه projects من را فهرست کن" (از سیستم فایل MCP استفاده میکند)

- "مشکلات باز در مخزن GitHub من را نشان بده" (از GitHub MCP استفاده میکند)

- "جدول کاربران را query کن و ۱۰ مورد اول را بر اساس تاریخ ثبتنام نشان بده" (از SQLite MCP استفاده میکند)

مدل به طور خودکار تشخیص میدهد که بر اساس درخواست شما کدام ابزار MCP را فراخوانی کند.

بهترین مدلها برای فراخوانی ابزار MCP

همه مدلها فراخوانی ابزار را به یک اندازه خوب انجام نمیدهند. در اینجا بهترین گزینهها برای استفاده MCP آمده است:

| مدل | اندازه | فراخوانی ابزار | سرعت | کیفیت |

|---|---|---|---|---|

| Qwen 2.5 7B Instruct | 4.5 GB (Q4) | عالی | سریع | بالا |

| Llama 3.3 8B Instruct | 5 GB (Q4) | خیلی خوب | سریع | بالا |

| Hermes 3 8B | 5 GB (Q4) | عالی | سریع | بالا |

| Qwen 2.5 72B Instruct | 42 GB (Q4) | عالی | کند | خیلی بالا |

| Mistral Small 24B | 14 GB (Q4) | خوب | متوسط | بالا |

برای اکثر کاربران، Qwen 2.5 7B Instruct بهترین تعادل بین قابلیت اطمینان فراخوانی ابزار و عملکرد را ارائه میدهد.

پیکربندی پارامترهای سرور LM Studio

سرور محلی خود را برای بارهای کاری MCP تنظیم کنید:

{

"contextLength": 8192,

"temperature": 0.1,

"maxTokens": 4096,

"gpu": {

"offloadLayers": -1

}

}

تنظیمات کلیدی:

- contextLength: برای زنجیرههای پیچیده فراخوانی ابزار روی 8192 یا بالاتر تنظیم کنید

- temperature: برای فراخوانی ابزار مطمئن از 0.1 یا کمتر استفاده کنید (مقادیر بالاتر باعث استفاده نامنظم از ابزار میشوند)

- maxTokens: به اندازه کافی بالا تنظیم کنید تا مدل بتواند پاسخهای فراخوانی ابزار را کامل کند

- GPU offload: برای حداکثر سرعت روی -1 تنظیم کنید تا همه لایهها به GPU منتقل شوند

استفاده از LM Studio با Python

میتوانید با سرور MCP-enabled LM Studio به صورت برنامهنویسی هم تعامل داشته باشید:

from openai import OpenAI

client = OpenAI(

api_key="lm-studio",

base_url="http://localhost:1234/v1"

)

# تعریف ابزارها

tools = [

{

"type": "function",

"function": {

"name": "get_weather",

"description": "Get current weather for a city",

"parameters": {

"type": "object",

"properties": {

"city": {"type": "string", "description": "City name"}

},

"required": ["city"]

}

}

}

]

response = client.chat.completions.create(

model="qwen2.5-7b-instruct",

messages=[

{"role": "user", "content": "What is the weather in Tokyo?"}

],

tools=tools,

tool_choice="auto"

)

# بررسی اینکه آیا مدل میخواهد ابزاری فراخوانی کند

message = response.choices[0].message

if message.tool_calls:

for tool_call in message.tool_calls:

print(f"Tool: {tool_call.function.name}")

print(f"Args: {tool_call.function.arguments}")

عیبیابی

"مدل از فراخوانی ابزار پشتیبانی نمیکند" مطمئن شوید از یک مدل instruct-tuned استفاده میکنید که از فراخوانی تابع پشتیبانی میکند. مدلهای پایه و برخی فاینتیونهای قدیمی از فرمت فراخوانی ابزار پشتیبانی نمیکنند.

سرور MCP در LM Studio نمایش داده نمیشود LM Studio را پس از اضافه کردن پیکربندیهای سرور MCP مجدداً راهاندازی کنید. بررسی کنید که Node.js نصب شده باشد و بسته سرور MCP با اجرای دستور به صورت دستی در ترمینال به درستی نصب شود.

فراخوانیهای ابزار خطا برمیگردانند دما را به 0.1 یا کمتر کاهش دهید. دماهای بالاتر میتوانند باعث شوند مدل JSON فراخوانی ابزار ناقص تولید کند. همچنین مطمئن شوید طول زمینه به اندازه کافی بالا تنظیم شده (حداقل 4096).

استنتاج کند با فراخوانی ابزار فراخوانی ابزار به توکنهای اضافی برای تعریف توابع و پاسخها نیاز دارد. از مدل کوچکتری استفاده کنید یا GPU offloading را افزایش دهید. استفاده از کوانتیزاسیون Q4_K_M برای بهترین tradeoff سرعت/کیفیت را در نظر بگیرید.

تعارض پورت اگر پورت 1234 از قبل در حال استفاده است، پورت سرور LM Studio را در تنظیمات تغییر دهید. همه پیکربندیهای MCP را برای مطابقت با پورت جدید بهروز کنید.

LM Studio MCP در مقابل سایر گزینهها

| ویژگی | LM Studio + MCP | Ollama + MCP | Claude Desktop | Cursor |

|---|---|---|---|---|

| مدلهای محلی | بله | بله | خیر | خیر |

| رابط GUI | بله | خیر (فقط CLI) | بله | بله |

| کلاینت MCP | بله (نسخه 0.3.6+) | از طریق پل | بله | بله |

| سرور MCP | از طریق پل | از طریق پل | N/A | N/A |

| فراخوانی ابزار | وابسته به مدل | وابسته به مدل | داخلی | داخلی |

| هزینه | رایگان (محاسبه محلی) | رایگان (محاسبه محلی) | $20/ماه Pro | $20/ماه |

| دشواری راهاندازی | آسان | متوسط | آسان | آسان |

جمعبندی

پشتیبانی MCP از LM Studio شکاف بین مدلهای هوش مصنوعی محلی و اکوسیستم رو به رشد ابزارهای MCP را پر میکند. چه بخواهید از مدلهای محلی به عنوان سرور MCP برای سایر برنامهها استفاده کنید یا ابزارهای خارجی را به LLM محلی خود متصل کنید، راهاندازی ساده است. کلید موفقیت انتخاب مدلی با تواناییهای قوی فراخوانی ابزار و نگه داشتن دما پایین برای اجرای قابل اطمینان تابع است.

اگر جریان کاری شما همچنین شامل تولید رسانه هوش مصنوعی مانند تصویر، ویدیو یا آواتارهای ناطق میشود، Hypereal AI را برای یک API یکپارچه بررسی کنید که همه آنها را در کنار جریانهای کاری LLM شما مدیریت میکند.

Hypereal AI را رایگان امتحان کنید — ۳۵ کردیت، بدون نیاز به کارت اعتباری.

مقالات مرتبط

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.