رفع محدودیتهای مصرف Codex: راهحلها و روشهای جایگزین (۲۰۲۶)

بر محدودیتهای نرخ OpenAI Codex غلبه کنید و بهترین جایگزینها را بیابید

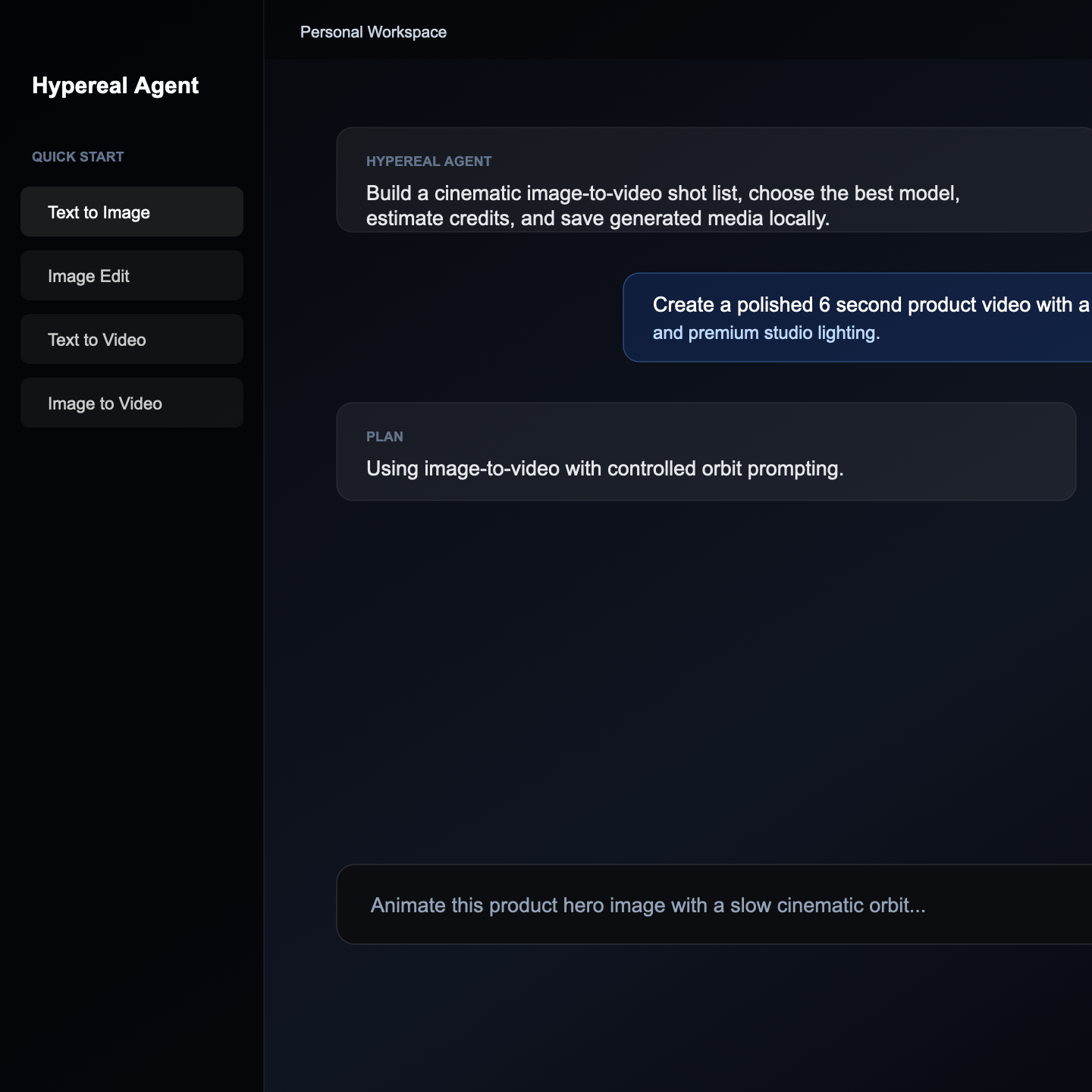

شروع به ساخت با Hypereal AI

دسترسی به Kling, Flux, Sora, Veo و موارد دیگر از طریق یک API واحد. اعتبار رایگان برای شروع، مقیاسپذیری تا میلیونها.

بدون نیاز به کارت اعتباری • بیش از ۱۰۰ هزار توسعهدهنده • آماده برای شرکتها

رفع محدودیتهای مصرف Codex: راهحلها و روشهای جایگزین (۲۰۲۶)

OpenAI Codex به یک ابزار ضروری در جریان کار توسعه با کمک هوش مصنوعی تبدیل شده، اما محدودیتهای مصرف آن یک سردردگیر مداوم باقی ماندهاند. خواه با محدودیتهای نرخ API، خواه با اتمام سریعتر از حد انتظار اعتبارات، یا با کند شدن سرویس در ساعات اوج مواجه شده باشید، این راهنما هر راهحل عملی برای بیشینه کردن مصرف Codex و بهترین جایگزینها را زمانی که محدودیتها مانع شوند پوشش میدهد.

درک محدودیتهای مصرف Codex

OpenAI چندین نوع محدودیت برای مصرف Codex اعمال میکند که بسته به نحوه دسترسی متفاوت است:

| نوع محدودیت | تیر رایگان | Plus/Pro | API (پرداخت به ازای مصرف) |

|---|---|---|---|

| درخواست در دقیقه | 3 RPM | 20 RPM | 60-500 RPM (وابسته به تیر) |

| توکن در دقیقه | 40,000 TPM | 150,000 TPM | تا 2M TPM |

| توکن در روز | 200,000 | نامحدود | نامحدود (وابسته به بودجه) |

| وظایف همزمان | 1 | 3-5 | وابسته به تیر |

| پنجره context | 192K | 192K | 192K |

چرا به محدودیتها میخورید

رایجترین دلایل رسیدن به محدودیتهای مصرف Codex:

- پنجرههای context بزرگ. Codex کل محتوای مخزن شما را پردازش میکند که توکنها را سریع مصرف میکند.

- حلقههای عاملی مکرر. وقتی Codex به صورت خودکار کار میکند، میتواند دهها درخواست داخلی در هر وظیفه ایجاد کند.

- کند شدن در ساعات اوج. OpenAI در دورههای پرتقاضا توان عملیاتی را کاهش میدهد، حتی برای کاربران پولی.

- محدودیتهای تیر. اکانتهای جدید API با تیر 1 و محدودیتهای نرخ پایینتر شروع میکنند.

راهحل ۱: ارتقای تیر API خود

OpenAI از یک سیستم تیر استفاده میکند که محدودیتهای نرخ بالاتر را بر اساس تاریخچه مخارج شما باز میکند:

| تیر | مجموع مخارج مورد نیاز | محدودیت RPM | محدودیت TPM |

|---|---|---|---|

| رایگان | $0 | 3 | 40,000 |

| تیر 1 | $5 | 60 | 200,000 |

| تیر 2 | $50 | 100 | 400,000 |

| تیر 3 | $100 | 300 | 1,000,000 |

| تیر 4 | $250 | 500 | 1,500,000 |

| تیر 5 | $1,000 | 500 | 2,000,000 |

برای بررسی و ارتقای تیر خود:

# Check your current usage and tier via the API

curl https://api.openai.com/v1/organization/usage \

-H "Authorization: Bearer $OPENAI_API_KEY"

سریعترین راه برای رسیدن به تیر بالاتر، پیشپرداخت اعتبار در داشبورد OpenAI در platform.openai.com/account/billing است.

راهحل ۲: بهینهسازی مصرف توکن

کاهش مصرف توکن به شما امکان میدهد در محدودیتهای موجود بیشتر کار کنید.

از پنجرههای context کوچکتر استفاده کنید

به جای اینکه Codex کل مخزن را ایندکس کند، وظایف را به فایلهای خاص محدود کنید:

# Bad: Vague task that forces Codex to scan everything

# "Fix the authentication bug in the project"

# Good: Specific task with targeted files

# "Fix the JWT validation error in src/auth/middleware.ts.

# The token expiry check on line 45 should use >= not >"

کشگذاری برای پرسشهای تکراری پیادهسازی کنید

اگر از API به صورت برنامهنویسی استفاده میکنید، پاسخها را برای پرسشهای مشابه کش کنید:

import hashlib

import json

from pathlib import Path

from openai import OpenAI

CACHE_DIR = Path(".codex_cache")

CACHE_DIR.mkdir(exist_ok=True)

client = OpenAI()

def cached_codex_request(prompt: str, model: str = "codex-mini-latest") -> str:

"""Send a Codex request with local caching to save tokens."""

cache_key = hashlib.sha256(f"{model}:{prompt}".encode()).hexdigest()

cache_file = CACHE_DIR / f"{cache_key}.json"

if cache_file.exists():

return json.loads(cache_file.read_text())["response"]

response = client.responses.create(

model=model,

input=prompt

)

result = response.output_text

cache_file.write_text(json.dumps({"prompt": prompt, "response": result}))

return result

از codex-mini برای وظایف معمول استفاده کنید

OpenAI در کنار مدل کامل Codex، نسخه codex-mini-latest هم عرضه میکند. نسخه mini به طور قابل توجهی توکن کمتری مصرف میکند و برای وظایف ساده سریعتر است:

# Using Codex CLI with the mini model

codex --model codex-mini-latest "Add error handling to the fetch calls in api.ts"

مدل کامل Codex را برای refactoring پیچیده چند فایله یا تغییرات معماری ذخیره کنید.

راهحل ۳: پیادهسازی مدیریت محدودیت نرخ

هنگام رسیدن به محدودیتهای نرخ در برنامهنویسی، از backoff نمایی استفاده کنید:

import time

from openai import OpenAI, RateLimitError

client = OpenAI()

def codex_with_retry(prompt: str, max_retries: int = 5) -> str:

"""Call Codex API with exponential backoff on rate limits."""

for attempt in range(max_retries):

try:

response = client.responses.create(

model="codex-mini-latest",

input=prompt

)

return response.output_text

except RateLimitError as e:

if attempt == max_retries - 1:

raise

wait_time = (2 ** attempt) + 1

print(f"Rate limited. Waiting {wait_time}s before retry...")

time.sleep(wait_time)

// Node.js version with retry logic

import OpenAI from "openai";

const client = new OpenAI();

async function codexWithRetry(prompt, maxRetries = 5) {

for (let attempt = 0; attempt < maxRetries; attempt++) {

try {

const response = await client.responses.create({

model: "codex-mini-latest",

input: prompt,

});

return response.output_text;

} catch (error) {

if (error.status !== 429 || attempt === maxRetries - 1) throw error;

const waitTime = Math.pow(2, attempt) + 1;

console.log(`Rate limited. Waiting ${waitTime}s...`);

await new Promise((r) => setTimeout(r, waitTime * 1000));

}

}

}

راهحل ۴: توزیع بار در چندین کلید API

اگر عضو یک تیم هستید، میتوانید درخواستها را در چندین اکانت سازمان OpenAI توزیع کنید تا محدودیتهای نرخ را تجمیع کنید:

import random

from openai import OpenAI

API_KEYS = [

"sk-proj-key1...",

"sk-proj-key2...",

"sk-proj-key3...",

]

def get_client() -> OpenAI:

"""Round-robin across API keys to distribute rate limits."""

key = random.choice(API_KEYS)

return OpenAI(api_key=key)

response = get_client().responses.create(

model="codex-mini-latest",

input="Refactor the database connection pool to use async/await"

)

این روش زمانی مشروع است که هر کلید متعلق به یک عضو تیم یا اکانت پروژه جداگانه باشد.

راهحل ۵: استفاده از جایگزینهای Codex

وقتی محدودیتهای Codex خیلی سختگیرانه هستند، این جایگزینها قابلیتهای کدنویسی مشابه یا بهتری ارائه میدهند:

| ابزار | مدل | محدودیت نرخ | هزینه | بهترین برای |

|---|---|---|---|---|

| Claude Code | Claude Opus 4 | مبتنی بر توکن | ~$6-18/1M توکن | کدنویسی عاملی پیچیده |

| Gemini CLI | Gemini 2.5 Pro | 60 RPM رایگان | رایگان (API) | وظایف سریع، context بزرگ |

| Aider | هر مدلی | وابسته به ارائهدهنده | BYOK | جریانهای کاری ترمینال |

| Cline | هر مدلی | وابسته به ارائهدهنده | BYOK | کدنویسی عاملی VS Code |

| Amazon Q CLI | مدلهای Amazon | رایگان سخاوتمندانه | رایگان (با AWS) | پروژههای محور AWS |

| GitHub Copilot | GPT-4o + سفارشی | 300 درخواست/ماه رایگان | $10/ماه | تکمیل inline |

راهاندازی Claude Code به عنوان جایگزین Codex

Claude Code رقیب مستقیم Codex است بدون محدودیتهای نرخ سخت (به ازای هر توکن پرداخت میکنید):

# Install Claude Code

npm install -g @anthropic-ai/claude-code

# Authenticate

claude

# Use it like Codex

claude "Refactor the auth middleware to support OAuth2"

راهاندازی Gemini CLI (رایگان)

Gemini CLI گوگل یک تیر رایگان با مدل قدرتمند Gemini 2.5 Pro ارائه میدهد:

# Install Gemini CLI

npm install -g @anthropic-ai/gemini-cli # or use the official installer

# Authenticate with Google

gemini auth login

# Use it for coding tasks

gemini "Add pagination to the /api/users endpoint"

راهحل ۶: میزبانی محلی یک جایگزین متنباز

برای مصرف نامحدود با صفر محدودیت نرخ، یک مدل کدنویسی متنباز deploy کنید:

# Using Ollama for local inference

ollama pull qwen2.5-coder:32b

# Use with Aider for a Codex-like experience

pip install aider-chat

aider --model ollama/qwen2.5-coder:32b

یا روی یک GPU ابری برای دسترسی تیمی deploy کنید:

# Deploy with vLLM on a cloud GPU

pip install vllm

python -m vllm.entrypoints.openai.api_server \

--model Qwen/Qwen2.5-Coder-32B-Instruct \

--tensor-parallel-size 2 \

--port 8000

سپس هر ابزار سازگار با OpenAI را به سرور خود متصل کنید:

# Use with Codex CLI or any tool that supports custom endpoints

export OPENAI_API_KEY="dummy"

export OPENAI_BASE_URL="http://your-server:8000/v1"

codex "Add input validation to the registration form"

مقایسه: Codex در برابر جایگزینها برای مصرف سنگین

| معیار | OpenAI Codex | Claude Code | Gemini CLI | میزبانی محلی |

|---|---|---|---|---|

| هزینه ماهانه (مصرف سنگین) | $50-200 | $50-150 | $0 (تیر رایگان) | $100-300 (GPU) |

| محدودیتهای نرخ | تیرهای سختگیر | مبتنی بر توکن | 60 RPM | هیچ |

| کیفیت کد | عالی | عالی | خیلی خوب | خوب تا عالی |

| ویرایش چند فایله | بله | بله | محدود | وابسته به ابزار |

| حالت آفلاین | خیر | خیر | خیر | بله |

| سختی راهاندازی | آسان | آسان | آسان | متوسط |

سوالات متداول

چطور مصرف فعلی Codex را بررسی کنم؟ به platform.openai.com/usage بروید تا مصرف توکن، تیر محدودیت نرخ، و جزئیات صورتحساب را ببینید.

آیا Codex CLI و ChatGPT محدودیتهای یکسانی دارند؟ خیر. Codex CLI از محدودیتهای نرخ API استفاده میکند، در حالی که ChatGPT محدودیتهای جداگانهای برای هر محصول دارد. از همان اکانت صورتحساب میشوند اما سهمیههای مستقلی دارند.

آیا میتوانم از OpenAI افزایش محدودیت نرخ بخواهم؟ بله. برای تیر 4 و بالاتر، میتوانید با پشتیبانی OpenAI تماس بگیرید تا محدودیتهای نرخ سفارشی برای موارد استفاده سازمانی درخواست کنید.

آیا جایگزینهای رایگان Codex هستند که با کیفیت آن برابری کنند؟ Gemini CLI با Gemini 2.5 Pro نزدیکترین جایگزین رایگان است. برای مدلهای متنباز، Qwen 2.5 Coder 32B برای اکثر وظایف به کیفیت Codex نزدیک میشود.

جمعبندی

محدودیتهای مصرف Codex یک محدودیت واقعی هستند، اما قابل مدیریتاند. با بهینهسازی مصرف توکن و ارتقای تیر API شروع کنید. اگر محدودیتها همچنان مانع میشوند، ابزارهایی مثل Claude Code و Gemini CLI با مدلهای قیمتگذاری متفاوت کیفیت مشابه ارائه میدهند. برای مصرف نامحدود، میزبانی محلی Qwen 2.5 Coder کنترل کامل را به شما میدهد.

اگر جریان کاری توسعه شما شامل رسانههای تولیدشده با هوش مصنوعی میشود، Hypereal AI دسترسی API به مدلهای تولید تصویر، ویدیو، و صدا با قیمتگذاری شفاف به ازای هر اعتبار و بدون محدودیتهای نرخ سختگیرانه فراهم میکند. توسعهدهندگان ایرانی میتوانند بدون مشکل تحریم از Hypereal استفاده کنند. ۳۵ اعتبار رایگان برای شروع دریافت کنید.

مقالات مرتبط

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.