Как настроить MCP-сервер в LM Studio (2026)

Используйте LM Studio как MCP-сервер для вызова инструментов через ИИ

Начните создавать с Hypereal AI

Получите доступ к Kling, Flux, Sora, Veo и другим через единый API. Бесплатные кредиты для начала, масштабирование до миллионов.

Кредитная карта не требуется • 100k+ разработчиков • Готовность к корпоративному использованию

Как настроить MCP-сервер в LM Studio (2026)

LM Studio позволяет запускать большие языковые модели локально с удобным настольным интерфейсом. Благодаря поддержке MCP (Model Context Protocol) вы теперь можете подключать локальные модели LM Studio к MCP-клиентам или использовать сам LM Studio как MCP-клиент для подключения к внешним MCP-серверам. Это руководство охватывает оба направления: использование LM Studio как MCP-сервера для других клиентов и подключение MCP-серверов инструментов к LM Studio.

Что такое LM Studio?

LM Studio — настольное приложение для локального запуска open-source языковых моделей на macOS, Windows и Linux. Оно предоставляет удобный интерфейс для загрузки моделей с Hugging Face, настройки параметров инференса и запуска локального API-сервера. Ключевые функции:

- Загрузка моделей в один клик с Hugging Face

- GPU-ускорение (NVIDIA, AMD, Apple Silicon)

- Локальный API-сервер, совместимый с OpenAI

- Встроенный чат-интерфейс с управлением диалогами

- Квантизация моделей и управление параметрами

Что такое MCP?

MCP (Model Context Protocol) — открытый стандарт от Anthropic, соединяющий ИИ-модели с внешними инструментами и источниками данных. В контексте LM Studio MCP обеспечивает два рабочих процесса:

- LM Studio как MCP-сервер: Другие приложения подключаются к локальной LLM в LM Studio через протокол MCP

- LM Studio как MCP-клиент: LM Studio подключается к MCP-серверам инструментов (файловые системы, базы данных, API), чтобы локальные модели могли использовать внешние инструменты

Предварительные требования

| Требование | Подробности |

|---|---|

| LM Studio | Версия 0.3.x или новее (поддержка MCP добавлена в 0.3.6) |

| RAM | Минимум 8 ГБ, рекомендуется 16+ ГБ |

| GPU (опционально) | NVIDIA 6+ ГБ VRAM или Apple Silicon |

| Хранилище | 10+ ГБ свободно для моделей |

| Node.js | v18+ (для пользовательских MCP-серверов) |

Часть 1: Использование встроенного API LM Studio как MCP-совместимого сервера

Локальный сервер LM Studio предоставляет API, совместимый с OpenAI. Хотя это не нативный MCP-сервер, вы можете соединить его с MCP-клиентами с помощью прокси.

Шаг 1: Скачайте и установите LM Studio

Скачайте LM Studio с lmstudio.ai для вашей платформы. Установите и запустите приложение.

Шаг 2: Скачайте модель

В строке поиска LM Studio найдите модель с хорошей поддержкой вызова инструментов:

- Qwen 2.5 7B Instruct — отличная поддержка вызова инструментов

- Llama 3.3 8B Instruct — сильная модель общего назначения

- Mistral 7B Instruct v0.3 — хороший баланс скорости и качества

- Hermes 3 8B — специально настроен для вызова функций

Нажмите кнопку загрузки рядом с выбранной моделью. Дождитесь завершения загрузки.

Шаг 3: Запустите локальный сервер

- Перейдите на вкладку Local Server в LM Studio (иконка

<->) - Выберите скачанную модель из выпадающего списка

- Переключите сервер в состояние ON

- Запомните URL сервера (по умолчанию:

http://localhost:1234)

Сервер теперь работает и принимает запросы в формате OpenAI API.

Шаг 4: Проверьте сервер

Протестируйте сервер с помощью cURL-запроса:

curl http://localhost:1234/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "qwen2.5-7b-instruct",

"messages": [

{"role": "user", "content": "Hello, are you working?"}

],

"temperature": 0.7

}'

Шаг 5: Свяжите с MCP через lmstudio-mcp-server

Для предоставления LM Studio как полноценного MCP-сервера используйте мост lmstudio-mcp-server от сообщества:

npm install -g lmstudio-mcp-server

Запустите мост:

lmstudio-mcp-server --port 1234

Это создаёт MCP-сервер, маршрутизирующий вызовы инструментов через локальную модель LM Studio.

Шаг 6: Подключитесь к Claude Desktop

Добавьте мост в конфигурацию MCP Claude Desktop:

macOS: ~/Library/Application Support/Claude/claude_desktop_config.json

{

"mcpServers": {

"lmstudio": {

"command": "npx",

"args": ["lmstudio-mcp-server", "--port", "1234"]

}

}

}

Перезапустите Claude Desktop. Сервер LM Studio появится как доступное MCP-подключение.

Часть 2: Подключение MCP-серверов к LM Studio

LM Studio версии 0.3.6+ поддерживает подключение к внешним MCP-серверам, предоставляя вашим локальным моделям доступ к инструментам: файловой системе, веб-поиску или запросам к базам данных.

Шаг 1: Откройте настройки MCP в LM Studio

- Откройте LM Studio

- Перейдите в Settings (иконка шестерёнки)

- Перейдите в раздел MCP

- Нажмите Add Server

Шаг 2: Добавьте MCP-сервер

Вы можете добавлять MCP-серверы, указывая команду для их запуска. Например, для добавления MCP-сервера файловой системы:

{

"filesystem": {

"command": "npx",

"args": [

"-y",

"@modelcontextprotocol/server-filesystem",

"/Users/yourname/Documents"

]

}

}

Шаг 3: Добавьте несколько MCP-серверов

Вот конфигурация с несколькими полезными MCP-серверами:

{

"filesystem": {

"command": "npx",

"args": [

"-y",

"@modelcontextprotocol/server-filesystem",

"/Users/yourname/projects"

]

},

"github": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-github"],

"env": {

"GITHUB_TOKEN": "ghp_your_github_token"

}

},

"sqlite": {

"command": "npx",

"args": [

"-y",

"@modelcontextprotocol/server-sqlite",

"/path/to/your/database.db"

]

}

}

Шаг 4: Используйте инструменты в чате

После добавления MCP-серверов загрузите модель с поддержкой вызова инструментов (Qwen 2.5, Hermes 3 или Llama 3.3 Instruct). В чате модель теперь может использовать подключённые инструменты.

Примеры взаимодействий:

- «Перечисли все Python-файлы в директории моих проектов» (использует filesystem MCP)

- «Покажи открытые задачи в моём GitHub-репозитории» (использует GitHub MCP)

- «Запроси таблицу пользователей и покажи первые 10 по дате регистрации» (использует SQLite MCP)

Модель автоматически определит, какой MCP-инструмент вызвать, исходя из вашего запроса.

Лучшие модели для вызова инструментов MCP

Не все модели одинаково хорошо справляются с вызовом инструментов. Вот лучшие варианты для MCP:

| Модель | Размер | Вызов инструментов | Скорость | Качество |

|---|---|---|---|---|

| Qwen 2.5 7B Instruct | 4.5 ГБ (Q4) | Отличный | Быстрый | Высокое |

| Llama 3.3 8B Instruct | 5 ГБ (Q4) | Очень хороший | Быстрый | Высокое |

| Hermes 3 8B | 5 ГБ (Q4) | Отличный | Быстрый | Высокое |

| Qwen 2.5 72B Instruct | 42 ГБ (Q4) | Отличный | Медленный | Очень высокое |

| Mistral Small 24B | 14 ГБ (Q4) | Хороший | Средний | Высокое |

Для большинства пользователей Qwen 2.5 7B Instruct предлагает оптимальный баланс надёжности вызова инструментов и производительности.

Настройка параметров сервера LM Studio

Тонкая настройка локального сервера для рабочих нагрузок MCP:

{

"contextLength": 8192,

"temperature": 0.1,

"maxTokens": 4096,

"gpu": {

"offloadLayers": -1

}

}

Ключевые настройки:

- contextLength: Установите 8192 или выше для сложных цепочек вызовов инструментов

- temperature: Используйте 0.1 или ниже для надёжного вызова инструментов (высокие значения вызывают нестабильный вызов инструментов)

- maxTokens: Установите достаточно высоко, чтобы модель могла завершить ответы на вызовы инструментов

- GPU offload: Установите -1 для выгрузки всех слоёв на GPU с максимальной скоростью

Использование LM Studio с Python

Вы также можете взаимодействовать с MCP-совместимым сервером LM Studio программно:

from openai import OpenAI

client = OpenAI(

api_key="lm-studio",

base_url="http://localhost:1234/v1"

)

# Определяем инструменты

tools = [

{

"type": "function",

"function": {

"name": "get_weather",

"description": "Get current weather for a city",

"parameters": {

"type": "object",

"properties": {

"city": {"type": "string", "description": "City name"}

},

"required": ["city"]

}

}

}

]

response = client.chat.completions.create(

model="qwen2.5-7b-instruct",

messages=[

{"role": "user", "content": "What is the weather in Tokyo?"}

],

tools=tools,

tool_choice="auto"

)

# Проверяем, хочет ли модель вызвать инструмент

message = response.choices[0].message

if message.tool_calls:

for tool_call in message.tool_calls:

print(f"Tool: {tool_call.function.name}")

print(f"Args: {tool_call.function.arguments}")

Устранение неполадок

«Модель не поддерживает вызов инструментов» Убедитесь, что вы используете instruct-настроенную модель с поддержкой вызова функций. Базовые модели и некоторые старые дообученные версии не поддерживают формат вызова инструментов.

MCP-сервер не отображается в LM Studio Перезапустите LM Studio после добавления конфигураций MCP-серверов. Убедитесь, что Node.js установлен и MCP-сервер устанавливается корректно — проверьте это, запустив команду вручную в терминале.

Ошибки при вызовах инструментов Снизьте температуру до 0.1 или ниже. Высокие значения температуры могут заставить модель генерировать некорректный JSON для вызова инструментов. Также убедитесь, что длина контекста достаточна (не менее 4096).

Медленный инференс при вызове инструментов Вызов инструментов требует дополнительных токенов для определений функций и ответов. Используйте меньшую модель или увеличьте выгрузку на GPU. Рассмотрите квантизацию Q4_K_M для лучшего компромисса скорость/качество.

Конфликты портов Если порт 1234 уже используется, измените порт сервера LM Studio в настройках. Обновите все конфигурации MCP под новый порт.

LM Studio MCP против других решений

| Функция | LM Studio + MCP | Ollama + MCP | Claude Desktop | Cursor |

|---|---|---|---|---|

| Локальные модели | Да | Да | Нет | Нет |

| GUI-интерфейс | Да | Нет (только CLI) | Да | Да |

| MCP-клиент | Да (v0.3.6+) | Через мост | Да | Да |

| MCP-сервер | Через мост | Через мост | Н/Д | Н/Д |

| Вызов инструментов | Зависит от модели | Зависит от модели | Встроенный | Встроенный |

| Стоимость | Бесплатно (локальные вычисления) | Бесплатно (локальные вычисления) | $20/мес Pro | $20/мес |

| Сложность настройки | Лёгкая | Средняя | Лёгкая | Лёгкая |

Итог

Поддержка MCP в LM Studio устраняет разрыв между локальными ИИ-моделями и растущей экосистемой MCP-инструментов. Хотите ли вы использовать локальные модели как MCP-сервер для других приложений или подключить внешние инструменты к своей локальной LLM — настройка проста. Ключ к успеху — выбор модели с сильными возможностями вызова инструментов и поддержание низкой температуры для надёжного выполнения функций.

Если ваш рабочий процесс также включает генерацию ИИ-медиа — изображений, видео или talking-аватаров — загляните на Hypereal AI: единый API для всего этого рядом с вашими LLM-рабочими процессами. Hypereal принимает карты российских банков без VPN.

Попробуйте Hypereal AI бесплатно — 35 кредитов, карта не нужна.

Похожие статьи

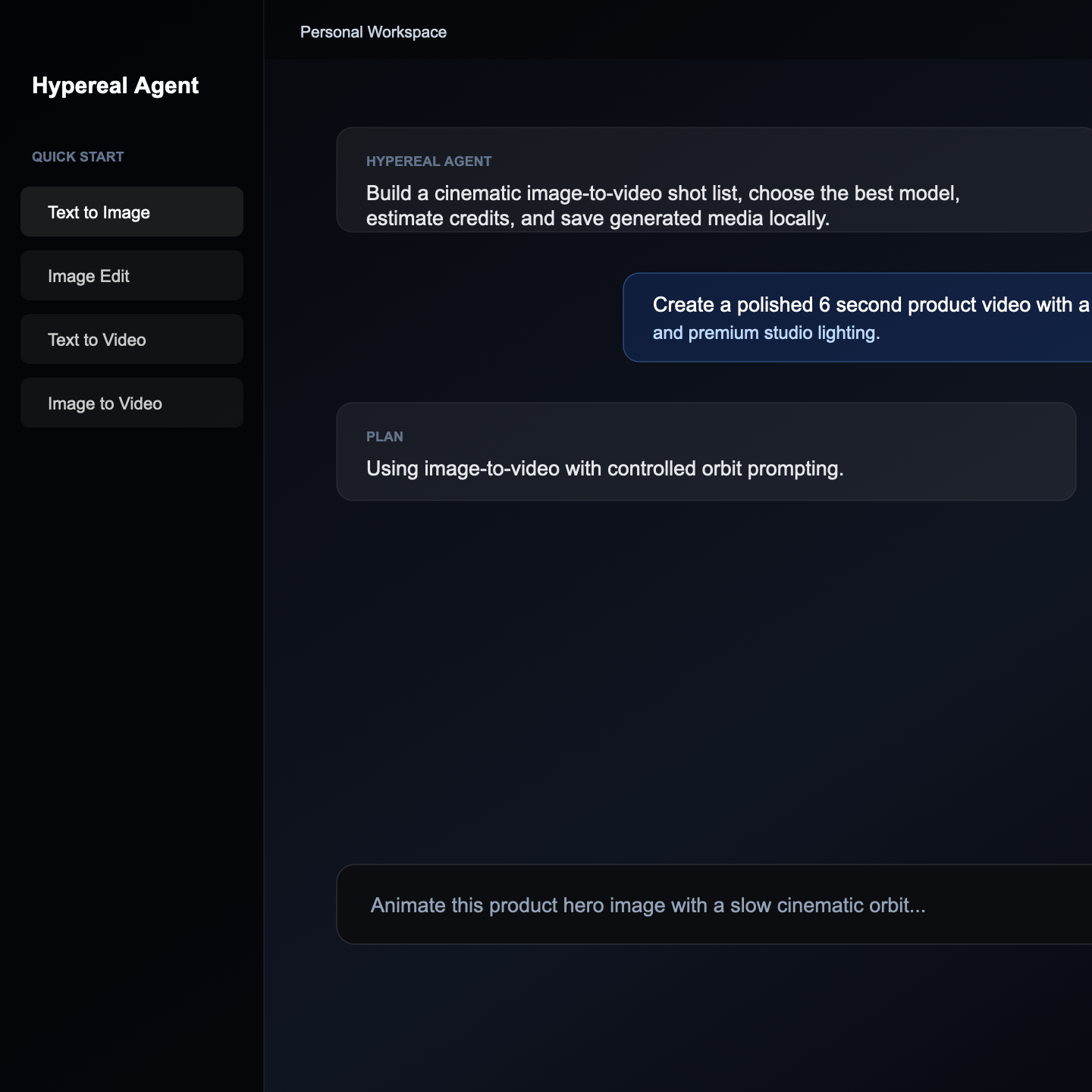

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.