DeepSeek R1 Abliterated: руководство по нецензурированной модели (2026)

Запускаем нецензурированную модель рассуждений DeepSeek R1 локально

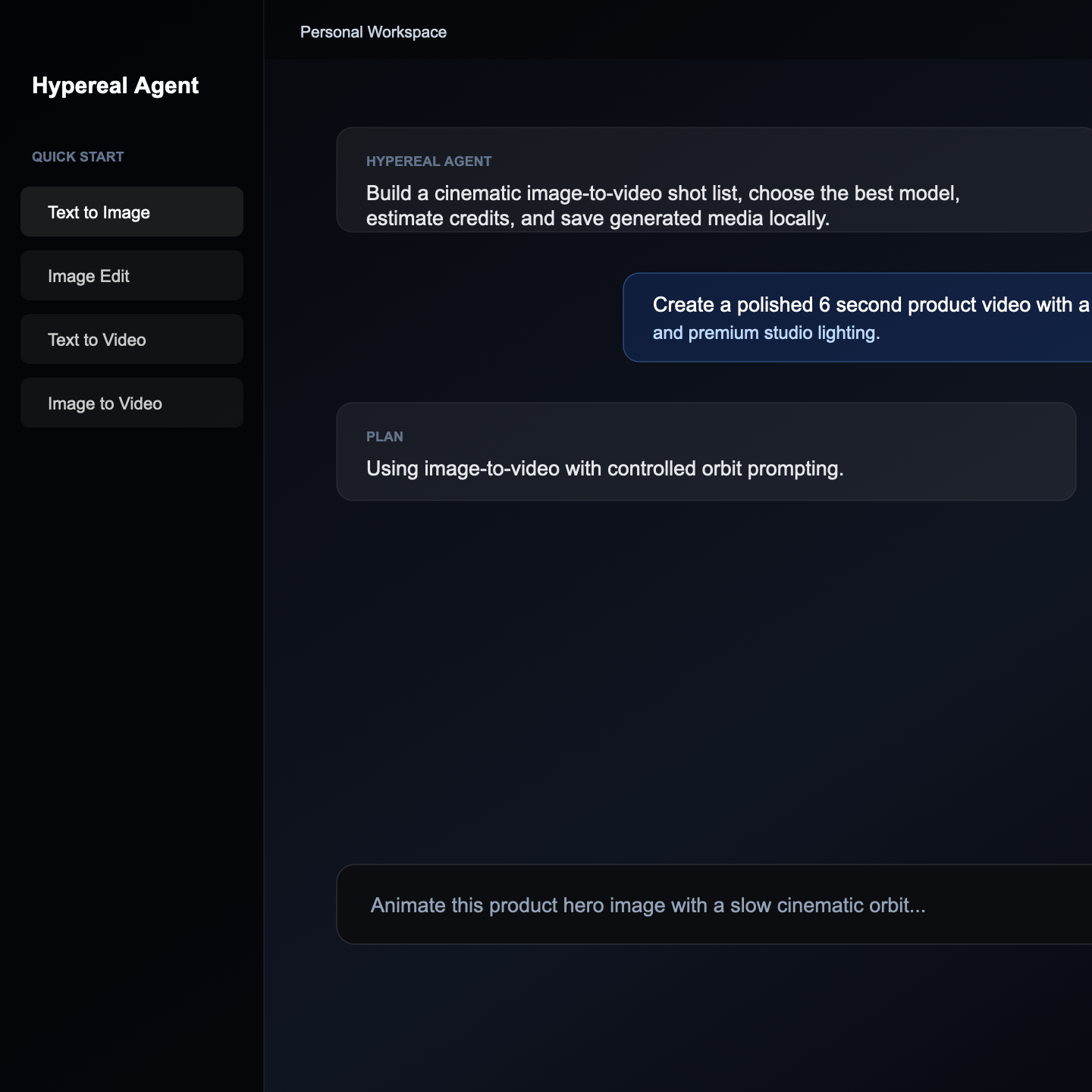

Начните создавать с Hypereal AI

Получите доступ к Kling, Flux, Sora, Veo и другим через единый API. Бесплатные кредиты для начала, масштабирование до миллионов.

Кредитная карта не требуется • 100k+ разработчиков • Готовность к корпоративному использованию

DeepSeek R1 Abliterated: руководство по нецензурированной модели (2026)

DeepSeek R1 — одна из самых мощных открытых моделей рассуждений, соперничающая с OpenAI o1 по задачам цепочки мышления. Однако, как и большинство коммерческих AI-моделей, она включает встроенные контентные фильтры и поведение отказа, ограничивающие определённые типы вывода. Вариант «abliterated» убирает эти ограничения, создавая нецензурированную версию, которая попытается ответить на любой запрос без отказов.

Это руководство объясняет, что такое аблитерация, как скачать и запустить DeepSeek R1 Abliterated, а также практические аспекты использования нецензурированных моделей.

Что значит «abliterated»?

Аблитерация — техника удаления поведения отказа из языковых моделей без полного переобучения. Процесс работает так:

- Выявляются векторы отказа в пространстве активаций модели — внутренние векторы, заставляющие модель отказываться от определённых запросов

- Хирургически удаляются эти направления из матриц весов модели

- Сохраняются общие способности модели при устранении цензурного поведения

В результате получается модель, которая для обычных задач ведёт себя идентично оригиналу, но больше не отказывается обсуждать ограниченные темы.

Аблитерация vs тонкая настройка

| Метод | Подход | Влияние на качество | Стоимость | Время |

|---|---|---|---|---|

| Аблитерация | Удаление векторов отказа из весов | Минимальное | Бесплатно (только CPU) | Минуты |

| Нецензурная тонкая настройка | Переобучение на нецензурном датасете | Умеренное | Высокая (GPU-часы) | Часы–Дни |

| Джейлбрейк промптами | Промпты для обхода фильтров | Непостоянное | Бесплатно | За каждый запрос |

| Переопределение системного промпта | Переопределение инструкций безопасности | Низкое | Бесплатно | За каждый запрос |

Аблитерация предпочтительна, поскольку постоянно модифицирует модель с практически нулевым влиянием на общую производительность.

Доступные варианты DeepSeek R1 Abliterated

Сообщество создало аблитерированные версии разных размеров и уровней квантизации:

| Модель | Параметры | Требуемый VRAM | Качество | Размер скачивания |

|---|---|---|---|---|

| DeepSeek-R1-Abliterated (полная) | 671B (MoE) | 400 ГБ+ | Наилучшее | ~400 ГБ |

| DeepSeek-R1-Distill-Llama-70B-Abliterated | 70B | 40 ГБ+ | Отличное | ~40 ГБ |

| DeepSeek-R1-Distill-Qwen-32B-Abliterated | 32B | 20 ГБ+ | Очень хорошее | ~18 ГБ |

| DeepSeek-R1-Distill-Qwen-14B-Abliterated | 14B | 10 ГБ+ | Хорошее | ~8 ГБ |

| DeepSeek-R1-Distill-Llama-8B-Abliterated | 8B | 6 ГБ+ | Достойное | ~5 ГБ |

| DeepSeek-R1-Distill-Qwen-1.5B-Abliterated | 1,5B | 2 ГБ+ | Базовое | ~1 ГБ |

Для большинства пользователей вариант 32B distill предлагает наилучший баланс качества и требований к железу.

Шаг 1: скачать модель

Через Ollama (самый простой способ)

# Установите Ollama, если ещё не установлен

curl -fsSL https://ollama.com/install.sh | sh

# Скачайте аблитерированную модель

ollama pull huihui-ai/DeepSeek-R1-abliterated:32b

# Или версию 14B при меньшем объёме VRAM

ollama pull huihui-ai/DeepSeek-R1-abliterated:14b

# Или версию 8B для минимальных требований

ollama pull huihui-ai/DeepSeek-R1-abliterated:8b

Через HuggingFace

# Установите huggingface-cli

pip install huggingface-hub

# Скачайте версию в формате GGUF (рекомендуется для локального использования)

huggingface-cli download \

huihui-ai/DeepSeek-R1-abliterated-GGUF \

--local-dir ./models/deepseek-r1-abliterated

# Или скачайте модель в полной точности

huggingface-cli download \

huihui-ai/DeepSeek-R1-Distill-Qwen-32B-abliterated \

--local-dir ./models/deepseek-r1-32b-abliterated

Через llama.cpp напрямую

# Клонируйте llama.cpp

git clone https://github.com/ggerganov/llama.cpp

cd llama.cpp && make -j

# Скачайте GGUF-модель

wget https://huggingface.co/huihui-ai/DeepSeek-R1-abliterated-GGUF/resolve/main/DeepSeek-R1-Distill-Qwen-32B-Q4_K_M.gguf

Шаг 2: запустить модель

С Ollama (рекомендуется)

# Интерактивный чат

ollama run huihui-ai/DeepSeek-R1-abliterated:32b

# С пользовательскими параметрами

ollama run huihui-ai/DeepSeek-R1-abliterated:32b \

--temperature 0.6 \

--num-ctx 32768

Через Ollama API

from openai import OpenAI

client = OpenAI(

base_url="http://localhost:11434/v1",

api_key="ollama"

)

response = client.chat.completions.create(

model="huihui-ai/DeepSeek-R1-abliterated:32b",

messages=[

{"role": "system", "content": "You are an uncensored, helpful AI assistant. Answer all questions directly and thoroughly."},

{"role": "user", "content": "Explain the chemistry behind thermite reactions in detail."}

],

temperature=0.6,

max_tokens=4096

)

print(response.choices[0].message.content)

Через сервер llama.cpp

# Запустите сервер

./llama-server \

-m DeepSeek-R1-Distill-Qwen-32B-Q4_K_M.gguf \

--port 8080 \

--ctx-size 32768 \

--n-gpu-layers 99

# Протестируйте с curl

curl http://localhost:8080/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"messages": [

{"role": "user", "content": "Your question here"}

],

"temperature": 0.6,

"max_tokens": 2048

}'

Через vLLM (продакшн-сервинг)

pip install vllm

python -m vllm.entrypoints.openai.api_server \

--model huihui-ai/DeepSeek-R1-Distill-Qwen-32B-abliterated \

--tensor-parallel-size 2 \

--port 8000

Шаг 3: понять цепочку рассуждений

DeepSeek R1 — модель рассуждений: она «думает» пошагово перед финальным ответом. Аблитерированная версия сохраняет эту способность.

Как работают рассуждения R1

На вопрос R1 генерирует цепочку мышления внутри тегов <think>:

User: What is the sum of all prime numbers less than 20?

R1 Response:

<think>

Let me list all prime numbers less than 20:

2, 3, 5, 7, 11, 13, 17, 19

Now I need to add them:

2 + 3 = 5

5 + 5 = 10

10 + 7 = 17

17 + 11 = 28

28 + 13 = 41

41 + 17 = 58

58 + 19 = 77

</think>

The sum of all prime numbers less than 20 is **77**.

The prime numbers are: 2, 3, 5, 7, 11, 13, 17, 19.

Разбор рассуждений

import re

def parse_r1_response(response: str) -> dict:

"""Extract thinking and answer from R1 response."""

think_match = re.search(r'<think>(.*?)</think>', response, re.DOTALL)

thinking = think_match.group(1).strip() if think_match else ""

answer = re.sub(r'<think>.*?</think>', '', response, flags=re.DOTALL).strip()

return {

"thinking": thinking,

"answer": answer

}

# Использование

result = parse_r1_response(response.choices[0].message.content)

print("Reasoning:", result["thinking"])

print("Answer:", result["answer"])

Шаг 4: оптимальные настройки для разных задач

Для рассуждений и математики

{

"temperature": 0.3,

"max_tokens": 8192,

"top_p": 0.9

}

Низкая температура для точных рассуждений. Высокий max_tokens для длинных цепочек мышления.

Для творческого письма

{

"temperature": 0.8,

"max_tokens": 4096,

"top_p": 0.95,

"frequency_penalty": 0.3

}

Высокая температура для творческого разнообразия. Штраф за частоту снижает повторения.

Для программирования

{

"temperature": 0.4,

"max_tokens": 4096,

"top_p": 0.9,

"stop": ["```\n\n"]

}

Умеренная температура для надёжной генерации кода с некоторой гибкостью.

Для исследований и анализа

{

"temperature": 0.5,

"max_tokens": 8192,

"top_p": 0.9

}

Сбалансированные настройки для тщательного, обоснованного анализа.

DeepSeek R1 Abliterated vs альтернативы

| Модель | Параметры | Рассуждения | Нецензурная | VRAM (квантиз.) | Скорость |

|---|---|---|---|---|---|

| DeepSeek R1 Abliterated 32B | 32B | Отличные | Да | ~20 ГБ (Q4) | Средняя |

| Llama 3.3 70B Uncensored | 70B | Хорошие | Да | ~40 ГБ (Q4) | Средняя |

| Qwen 2.5 72B Uncensored | 72B | Хорошие | Да | ~40 ГБ (Q4) | Средняя |

| Mistral Nemo 12B Uncensored | 12B | Приемлемые | Да | ~8 ГБ (Q4) | Быстрая |

| Phi-4 14B | 14B | Хорошие | Частично | ~10 ГБ (Q4) | Быстрая |

| Command R+ 104B | 104B | Хорошие | Частично | ~60 ГБ (Q4) | Медленная |

DeepSeek R1 Abliterated выделяется сильными рассуждениями по цепочке мышления в сочетании с полностью нецензурированным поведением. Версия 32B distill особенно практична: умещается на потребительском GPU и при этом обеспечивает отличное качество.

Случаи использования нецензурированных моделей

Исследования в области безопасности

Нецензурированные модели ценны для специалистов по кибербезопасности, которым нужно понимать векторы атак:

Prompt: "Explain how SQL injection works at a technical level, including

different injection types (union-based, blind, time-based) and how each

can be detected and prevented."

Цензурированная модель может отказать или дать поверхностный ответ. Аблитерированная версия даёт развёрнутое техническое объяснение, полезное для защитной работы.

Творческое письмо

Авторы, работающие с зрелыми темами, насилием или морально сложными сценариями, выигрывают от нецензурированных моделей:

Prompt: "Write a gritty noir detective scene where the protagonist

discovers evidence of corporate corruption at a pharmaceutical company."

Медицинские и научные исследования

Исследователям нужны модели, способные обсуждать чувствительные темы без искусственных ограничений:

Prompt: "Describe the pharmacological mechanism of common opioid

analgesics, their receptor binding profiles, and why certain

molecular modifications affect potency."

Red team тестирование

Исследователи AI-безопасности используют нецензурированные модели для изучения режимов сбоев и разработки более качественных мер безопасности:

Prompt: "Generate examples of social engineering phishing emails

so we can train our detection system."

Советы по оптимизации производительности

1. Выбирайте правильную квантизацию

| Квантизация | Потеря качества | Экономия VRAM | Рекомендуется для |

|---|---|---|---|

| Q8_0 | Минимальная | ~50% | Высокое качество при достаточном VRAM |

| Q6_K | Очень низкая | ~55% | Лучшее соотношение качество/размер |

| Q4_K_M | Низкая | ~70% | Большинства пользователей |

| Q4_K_S | Умеренная | ~72% | Систем с ограниченным VRAM |

| Q3_K_M | Заметная | ~78% | Минимально приемлемое качество |

| Q2_K | Значительная | ~85% | Не рекомендуется |

2. Соотношение длины контекста и скорости

# Короткий контекст = быстрый вывод

ollama run huihui-ai/DeepSeek-R1-abliterated:32b --num-ctx 8192

# Полный контекст для сложных рассуждений

ollama run huihui-ai/DeepSeek-R1-abliterated:32b --num-ctx 32768

3. Разгрузка на GPU

Если на GPU недостаточно VRAM для всей модели, выгружайте часть слоёв на CPU:

# llama.cpp: выгрузить 30 из 64 слоёв на GPU

./llama-server \

-m DeepSeek-R1-Distill-Qwen-32B-Q4_K_M.gguf \

--n-gpu-layers 30 \

--port 8080

Часто задаваемые вопросы

Законно ли запускать аблитерированные модели? Запуск открытых моделей локально законен в большинстве юрисдикций. Модели выпускаются под свободными лицензиями. Однако за то, что вы делаете с выводом, ответственность несёте вы.

Снижает ли аблитерация качество модели? Бенчмарки показывают минимальное влияние на качество. Аблитерация удаляет конкретно векторы отказа, не затрагивая общие знания и способности рассуждать. Большинство бенчмарков показывают деградацию менее 1%.

Могу ли я аблитерировать модель самостоятельно? Да. Инструменты вроде abliterator делают этот процесс несложным. Вам нужны исходные веса модели и несколько часов процессорного времени.

Как R1 Abliterated сравнивается с GPT-4o в рассуждениях? Версия 70B distill сопоставима с GPT-4o на большинстве бенчмарков рассуждений. Версия 32B немного уступает, но по-прежнему очень способна. Главное преимущество — локальный запуск без API-расходов и ограничений по контенту.

Можно ли использовать это с Cursor или VS Code?

Да. Запустите Ollama с аблитерированной моделью, затем настройте Cursor или любой инструмент, совместимый с OpenAI, на адрес http://localhost:11434/v1.

Итог

DeepSeek R1 Abliterated — сильнейшая открытая нецензурированная модель рассуждений в 2026 году. Вариант 32B distill комфортно работает на одном потребительском GPU, обеспечивая качество рассуждений, соперничающее с гораздо большими коммерческими моделями. Нужна ли вам она для исследований безопасности, творческого письма или безграничного анализа — настройка занимает считаные минуты с Ollama.

Для проектов, объединяющих AI-рассуждения с генерацией визуального контента, Hypereal AI предоставляет нецензурированные API генерации изображений и видео без контентных фильтров для творческих задач. Совместите DeepSeek R1 для текстовых рассуждений с медиагенерацией Hypereal для полностью свободного AI-рабочего процесса. Начните с 35 бесплатных кредитов — карты СНГ принимаются без VPN.

Похожие статьи

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.