LM Studio: полное руководство по локальному инференсу LLM (2026)

Запускайте мощные ИИ-модели на собственном железе без зависимости от облака

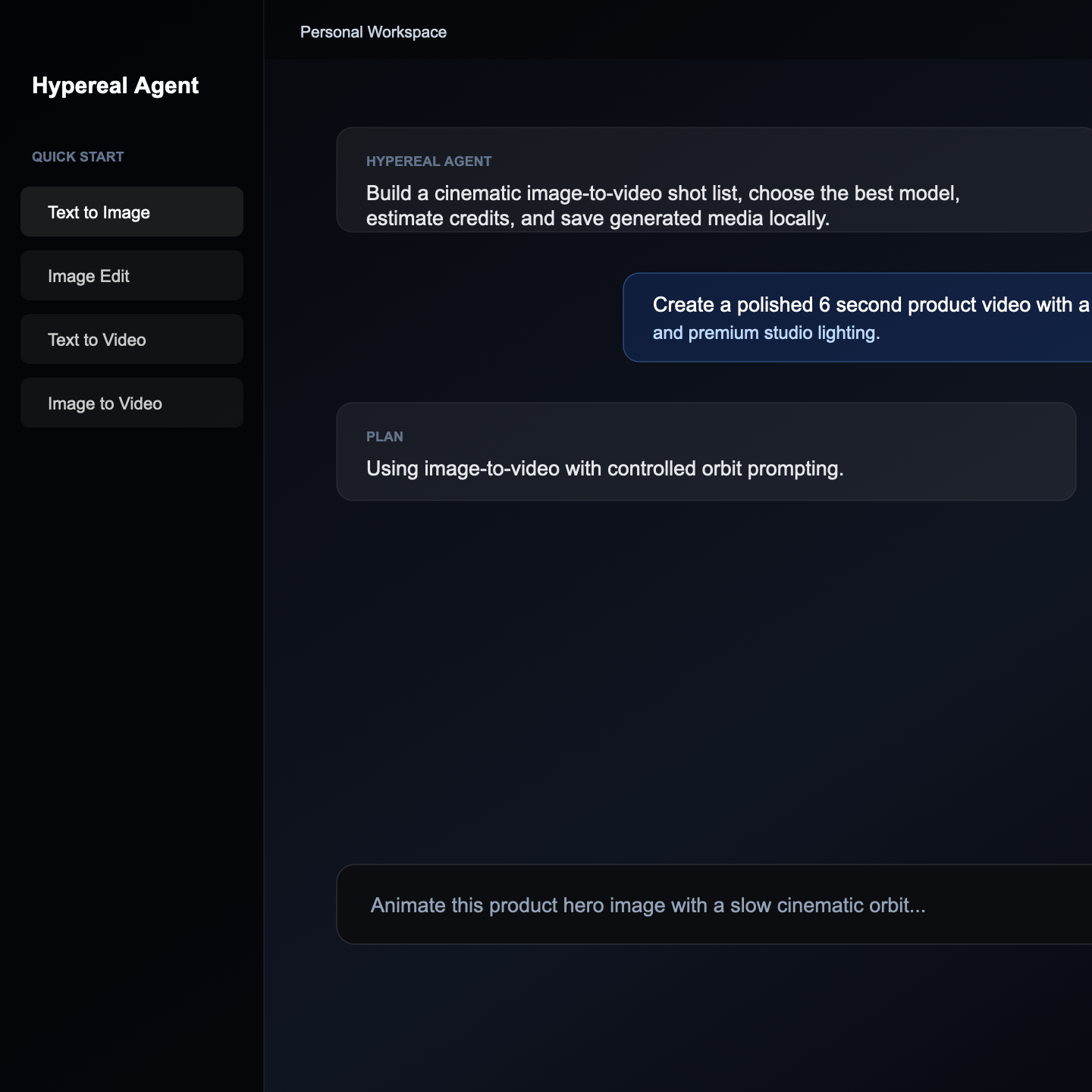

Начните создавать с Hypereal AI

Получите доступ к Kling, Flux, Sora, Veo и другим через единый API. Бесплатные кредиты для начала, масштабирование до миллионов.

Кредитная карта не требуется • 100k+ разработчиков • Готовность к корпоративному использованию

LM Studio: полное руководство по локальному инференсу LLM (2026)

LM Studio — настольное приложение, позволяющее скачивать, запускать и использовать большие языковые модели полностью на локальном железе. Никакой зависимости от облака, никаких API-ключей, никаких абонентских плат и полная приватность. Ваши данные не покидают компьютер.

В 2026 году локальный инференс LLM стал неожиданно практичным. Оптимизированные форматы квантизации, такие как GGUF, позволяют даже потребительскому железу запускать модели, сопоставимые с облачными API для многих задач. Это руководство охватывает всё, что нужно знать о LM Studio: установку, выбор модели, настройку, оптимизацию производительности и настройку API.

Что такое LM Studio?

LM Studio — бесплатное настольное приложение для macOS, Windows и Linux, которое предоставляет:

- Интерфейс для поиска и загрузки моделей (с просмотром Hugging Face)

- Чат-интерфейс для взаимодействия с моделями

- Локальный API-сервер, совместимый с OpenAI

- Управление моделями (загрузка, удаление, организация)

- Настраиваемые параметры инференса (температура, длина контекста, слои GPU)

- Поддержку форматов GGUF, MLX и других квантизированных форматов

Зачем запускать модели локально?

| Преимущество | Подробности |

|---|---|

| Конфиденциальность | Данные не покидают компьютер |

| Без затрат | Никаких API-комиссий и подписок |

| Без ограничений | Используйте столько, сколько хотите |

| Офлайн | Работает без интернета после загрузки модели |

| Кастомизация | Полный контроль над параметрами и системными промптами |

| Скорость | Нет сетевой задержки (GPU-инференс может быть очень быстрым) |

Системные требования

LM Studio работает на широком спектре железа, но производительность значительно зависит от объёма VRAM и системной RAM.

Минимальные требования

| Компонент | Минимум | Рекомендуется |

|---|---|---|

| ОС | macOS 13+, Windows 10+, Ubuntu 22.04+ | Последняя версия |

| RAM | 8 ГБ | 16–32 ГБ |

| GPU | Не обязателен (режим CPU) | 8+ ГБ VRAM |

| Хранилище | 10 ГБ свободно | 50+ ГБ свободно |

| CPU | Любой 64-bit | Apple Silicon или современный x86 |

Совместимость GPU

| Тип GPU | Поддержка | Примечания |

|---|---|---|

| NVIDIA (CUDA) | Полная | Лучшая производительность на Windows/Linux |

| Apple Silicon (Metal) | Полная | Отличная производительность на macOS |

| AMD (ROCm/Vulkan) | Частичная | Linux ROCm работает хорошо, Vulkan на Windows |

| Intel Arc | Частичная | Улучшается через Vulkan |

| Только CPU | Да | Медленно, но работает для небольших моделей |

Шаг 1: Установите LM Studio

macOS

# Скачайте с сайта

# Перейдите на https://lmstudio.ai и скачайте файл .dmg

# Или установите через Homebrew

brew install --cask lm-studio

Windows

Скачайте установщик с lmstudio.ai и запустите его. LM Studio устанавливается в вашу пользовательскую директорию и не требует прав администратора.

Linux

# Скачайте AppImage с lmstudio.ai

chmod +x LM-Studio-*.AppImage

./LM-Studio-*.AppImage

# Или используйте Flatpak (если доступно)

flatpak install flathub ai.lmstudio.LMStudio

Шаг 2: Скачайте первую модель

После запуска LM Studio используйте вкладку Discover для просмотра и загрузки моделей.

Рекомендуемые модели по железу (2026)

| Железо | Модель | Размер | Качество |

|---|---|---|---|

| 8 ГБ RAM (CPU) | Qwen 3 0.6B Q8 | 0.8 ГБ | Базовые задачи |

| 16 ГБ RAM (CPU) | Llama 4 Scout 8B Q4_K_M | 5 ГБ | Хорош для чата |

| 8 ГБ VRAM | Qwen 3 14B Q4_K_M | 9 ГБ | Очень хороший |

| 12 ГБ VRAM | Qwen 3 32B Q4_K_M | 19 ГБ | Отличный |

| 16 ГБ VRAM | Llama 4 Scout 109B Q3_K_M | 14 ГБ | Отличный |

| 24 ГБ VRAM (RTX 4090) | DeepSeek Coder V3 Q4_K_M | 18 ГБ | Близко к облачному уровню |

| Apple M4 Pro 24GB | Qwen 3 32B Q4_K_M | 19 ГБ | Отличный |

| Apple M4 Max 64GB | Llama 4 Maverick Q4_K_M | 55 ГБ | Конкурентен облаку |

Как скачать модель

- Перейдите на вкладку Discover в LM Studio

- Найдите нужную модель (например, «Qwen 3 14B»)

- Выберите нужную квантизацию GGUF (Q4_K_M — хороший выбор по умолчанию)

- Нажмите Download

- Дождитесь завершения загрузки (модели занимают от 2 до 60+ ГБ)

Понимание квантизации

Квантизация уменьшает размер модели и использование памяти за счёт некоторого снижения качества. Вот руководство по распространённым уровням квантизации GGUF:

| Квантизация | Биты | Размер от FP16 | Влияние на качество |

|---|---|---|---|

| Q2_K | 2-bit | ~25% | Значительная потеря качества |

| Q3_K_M | 3-bit | ~35% | Заметная потеря качества |

| Q4_K_M | 4-bit | ~45% | Минимальная потеря (рекомендуется) |

| Q5_K_M | 5-bit | ~55% | Очень небольшая потеря |

| Q6_K | 6-bit | ~65% | Почти без потерь |

| Q8_0 | 8-bit | ~85% | Фактически без потерь |

| FP16 | 16-bit | 100% | Оригинальное качество |

Q4_K_M — оптимальный выбор для большинства пользователей: минимальная потеря качества при примерно вдвое меньшем потреблении памяти по сравнению с полной моделью.

Шаг 3: Общение с моделью

- Перейдите на вкладку Chat

- Выберите скачанную модель из выпадающего списка

- Начните вводить сообщения

Полезные настройки чата

| Параметр | По умолчанию | Рекомендуется | Назначение |

|---|---|---|---|

| Temperature | 0.7 | 0.1–0.3 для кода, 0.7–0.9 для творчества | Управляет случайностью |

| Context Length | 4096 | Максимум для вашего железа | Сколько текста помнит модель |

| GPU Layers | Auto | Все (если позволяет VRAM) | Сколько слоёв работает на GPU |

| System Prompt | Нет | Устанавливайте под задачу | Задаёт поведение модели |

Примеры системных промптов

Для помощи с кодом:

You are an expert software developer. Write clean, well-documented code.

Always include error handling and type annotations. Prefer standard library

solutions over third-party dependencies. Explain your reasoning briefly.

Для помощи с текстом:

You are a professional editor. Help improve writing clarity, grammar, and

structure. Suggest specific edits rather than general advice. Maintain the

author's voice and intent.

Шаг 4: Используйте локальный API-сервер

LM Studio включает API-сервер, совместимый с OpenAI. Это позволяет использовать локальные модели с любым инструментом, поддерживающим формат OpenAI API, — включая Cursor, Continue, Cline, Aider и собственные приложения.

Запустите API-сервер

- Перейдите на вкладку Developer (или Local Server)

- Выберите модель

- Нажмите Start Server

- Сервер работает по адресу

http://localhost:1234по умолчанию

Протестируйте API

curl http://localhost:1234/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "qwen3-14b",

"messages": [

{"role": "system", "content": "You are a helpful coding assistant."},

{"role": "user", "content": "Write a Python function to flatten a nested dictionary."}

],

"temperature": 0.2,

"max_tokens": 1000

}'

Использование с Python

from openai import OpenAI

# Направляем запросы на локальный сервер LM Studio

client = OpenAI(

base_url="http://localhost:1234/v1",

api_key="not-needed" # LM Studio не требует API-ключ

)

response = client.chat.completions.create(

model="qwen3-14b",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Explain how HTTP caching works."}

],

temperature=0.3

)

print(response.choices[0].message.content)

Подключение к Cursor

- Откройте Cursor > Settings > Models

- Добавьте пользовательскую модель:

- API Key:

lm-studio(любая непустая строка) - Base URL:

http://localhost:1234/v1 - Model name: Название вашей загруженной модели

- API Key:

- Выберите модель в панели чата или агента Cursor

Подключение к Continue (VS Code)

// ~/.continue/config.json

{

"models": [

{

"title": "LM Studio - Qwen 3 14B",

"provider": "openai",

"model": "qwen3-14b",

"apiBase": "http://localhost:1234/v1",

"apiKey": "not-needed"

}

]

}

Подключение к Aider

# Используйте LM Studio как бэкенд для Aider

aider --model openai/qwen3-14b \

--openai-api-base http://localhost:1234/v1 \

--openai-api-key not-needed

Шаг 5: Оптимизация производительности

Максимальная выгрузка на GPU

Наиболее важный параметр производительности — выгрузка на GPU. Установите количество слоёв GPU на максимум, который позволяет ваш VRAM:

| Размер модели | Необходимый VRAM GPU (Q4_K_M) | Примерная скорость |

|---|---|---|

| 7–8B | 5–6 ГБ | 30–60 токенов/сек |

| 14B | 9–10 ГБ | 20–40 токенов/сек |

| 32B | 19–22 ГБ | 10–25 токенов/сек |

| 70B | 40–45 ГБ | 5–15 токенов/сек |

Длина контекста и скорость

Большие контекстные окна требуют больше памяти и замедляют инференс. Устанавливайте длину контекста исходя из реальных потребностей:

Обычный чат: 4096–8192 токенов

Помощь с кодом: 8192–16384 токенов

Анализ документов: 16384–32768 токенов

Большая кодовая база: 32768–65536 токенов

Советы по памяти

- Закрывайте другие приложения, чтобы освободить RAM для загрузки модели

- Используйте квантизацию Q4_K_M по умолчанию (оптимальное соотношение качество/размер)

- Если модель едва помещается в VRAM, попробуйте Q3_K_M для высвобождения памяти

- На Apple Silicon унифицированная память означает, что системная RAM делится между CPU и GPU. Мак с 32 ГБ может полностью загрузить модели, требующие 28–30 ГБ

LM Studio против Ollama

LM Studio и Ollama — два наиболее популярных инструмента для локального инференса. Вот их сравнение:

| Функция | LM Studio | Ollama |

|---|---|---|

| Интерфейс | GUI + API | CLI + API |

| Формат моделей | GGUF, MLX | GGUF (через Modelfile) |

| Поиск моделей | Встроенный браузер | ollama pull |

| Совместимость API | Совместим с OpenAI | Совместим с OpenAI |

| Платформа | macOS, Windows, Linux | macOS, Windows, Linux |

| Потребление ресурсов | Выше (Electron-приложение) | Ниже (CLI) |

| Простота | Проще для новичков | Проще для CLI-пользователей |

| Цена | Бесплатно | Бесплатно |

Выбирайте LM Studio, если предпочитаете графический интерфейс для просмотра, загрузки и управления моделями. Выбирайте Ollama, если предпочитаете рабочий процесс на основе CLI с меньшими накладными расходами.

Часто задаваемые вопросы

LM Studio бесплатен? Да, LM Studio полностью бесплатен для личного использования. Нет API-комиссий, подписок или ограничений использования.

С каких моделей начать? Начните с Qwen 3 14B Q4_K_M, если у вас 16 ГБ RAM или 8+ ГБ VRAM. Специально для программирования попробуйте DeepSeek Coder V3 или Qwen 2.5 Coder.

Могут ли локальные модели сравниться с облачными API по качеству? Для многих задач — да. Хорошо квантизированная модель на 32B или 70B параметров производит вывод, сопоставимый с GPT-4o для программирования, написания текстов и анализа. Для самых требовательных задач облачные модели (GPT-5, Claude Opus 4) по-прежнему имеют преимущество.

Можно ли использовать LM Studio с Cursor/Cline/Aider? Да. API-сервер LM Studio, совместимый с OpenAI, работает с любым инструментом, поддерживающим пользовательские конечные точки OpenAI. Примеры конфигурации — в шаге 4.

Работает ли LM Studio офлайн? Да. После загрузки модели LM Studio работает полностью офлайн. Интернет-соединение для инференса не нужно.

Сколько дискового пространства нужно? Модели занимают от 1 ГБ (небольшие 3B-модели) до 60+ ГБ (большие 70B+). Планируйте 10–50 ГБ в зависимости от количества моделей.

Итог

LM Studio делает локальный инференс LLM доступным для всех. С правильной моделью для вашего железа вы получаете приватного, бесплатного, офлайн-ИИ-ассистента для программирования, написания текстов, анализа и творческих задач. API-сервер, совместимый с OpenAI, обеспечивает бесшовную интеграцию с Cursor, Aider, Continue и собственными приложениями.

Для задач, требующих ИИ-возможностей облачного уровня, — таких как генерация изображений, видео и аудио — попробуйте Hypereal AI бесплатно — 35 кредитов, карта не нужна. Hypereal принимает карты российских банков без VPN. Сочетайте локальную генерацию текста через LM Studio с облачным API Hypereal для генерации медиа.

Похожие статьи

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.