Лучшие бесплатные API для открытых LLM в 2026 году

Бесплатные и открытые API для LLM, которые должен знать каждый разработчик

Начните создавать с Hypereal AI

Получите доступ к Kling, Flux, Sora, Veo и другим через единый API. Бесплатные кредиты для начала, масштабирование до миллионов.

Кредитная карта не требуется • 100k+ разработчиков • Готовность к корпоративному использованию

Лучшие бесплатные API для открытых LLM в 2026 году

Чтобы создавать AI-приложения, не нужно тратить сотни долларов в месяц. Экосистема открытых LLM в 2026 году предлагает высококачественные модели с бесплатным или исключительно доступным API-доступом. Прототипируете, строите пет-проекты или запускаете продакшн-нагрузки с ограниченным бюджетом — эти API дают мощные языковые модели, не опустошая кошелёк.

Это руководство охватывает лучшие бесплатные и открытые LLM API, доступные прямо сейчас, с ценами, лимитами и примерами кода для каждого.

Быстрое сравнение

| Провайдер | Бесплатный уровень | Топ-модель | Окно контекста | Лимит (бесплатно) | OpenAI-совместим |

|---|---|---|---|---|---|

| Groq | Да | Llama 3.3 70B, DeepSeek R1 | 128К | 30 запр./мин | Да |

| Together AI | $5 кредит | Llama 3.3 70B, Qwen 2.5 72B | 128К | 60 запр./мин | Да |

| Fireworks AI | $1 кредит | Llama 3.3 70B, Mixtral | 128К | 10 запр./мин | Да |

| OpenRouter | Некоторые модели бесплатно | Зависит от модели | Варьируется | Варьируется | Да |

| HuggingFace Inference | Бесплатно (с лимитами) | Llama 3.3, Mistral, Qwen | 32К–128К | 60 запр./ч | Частично |

| Cerebras | Бесплатная бета | Llama 3.3 70B | 128К | 30 запр./мин | Да |

| SambaNova | Бесплатный уровень | Llama 3.3 70B | 128К | 20 запр./мин | Да |

| Ollama (локальный) | Бесплатно навсегда | Любая GGUF-модель | Зависит от RAM | Без ограничений | Да |

| Google AI Studio | Бесплатный уровень | Gemini 2.5 Flash | 1М | 15 запр./мин | Нет (свой SDK) |

| Cloudflare Workers AI | Бесплатный уровень | Llama 3.3, Mistral | 32К | 10К запр./день | Частично |

1. Groq

Groq предлагает быстрейший LLM-инференс, запуская модели на своём кастомном LPU (Language Processing Unit). Их бесплатный уровень — один из самых щедрых.

Детали бесплатного уровня

| Параметр | Лимит |

|---|---|

| Лимит запросов | 30 запросов/мин, 14 400 запросов/день |

| Доступные модели | Llama 3.3 70B, DeepSeek R1, Mixtral 8x7B, Gemma 2 |

| Лимит токенов | ~6 000 токенов/мин (зависит от модели) |

| Окно контекста | До 128К токенов |

Настройка

# Получите API-ключ на console.groq.com

export GROQ_API_KEY="gsk_xxxxxxxxxxxx"

from openai import OpenAI

client = OpenAI(

api_key="gsk_xxxxxxxxxxxx",

base_url="https://api.groq.com/openai/v1"

)

response = client.chat.completions.create(

model="llama-3.3-70b-versatile",

messages=[{"role": "user", "content": "Explain quicksort in Python"}],

temperature=0.7

)

print(response.choices[0].message.content)

Почему стоит использовать Groq

Быстрейший инференс в индустрии. Ответы приходят за миллисекунды, а не секунды. Бесплатного уровня достаточно для прототипирования и личных проектов.

2. Together AI

Together AI хостит широкий спектр открытых моделей с конкурентными ценами и $5 бесплатных кредитов для новых аккаунтов.

Детали бесплатных кредитов

| Параметр | Детали |

|---|---|

| Бесплатные кредиты | $5 при регистрации |

| Цена Llama 3.3 70B | $0.88/М токенов |

| Доступные модели | 100+ открытых моделей |

| Лимит запросов | 60 запросов/мин |

Настройка

from openai import OpenAI

client = OpenAI(

api_key="your-together-api-key",

base_url="https://api.together.xyz/v1"

)

response = client.chat.completions.create(

model="meta-llama/Llama-3.3-70B-Instruct-Turbo",

messages=[{"role": "user", "content": "Write a FastAPI endpoint for user registration"}],

)

print(response.choices[0].message.content)

Почему стоит использовать Together AI

Наибольший выбор открытых моделей. Хотите протестировать разные модели (Llama, Qwen, Mistral, DeepSeek) — Together AI собрал их на одной платформе.

3. HuggingFace Inference API

HuggingFace предлагает бесплатный инференс для тысяч моделей, размещённых на их платформе. Бесплатный уровень имеет лимиты, но достаточен для разработки.

Детали бесплатного уровня

| Параметр | Лимит |

|---|---|

| Лимит запросов | ~60 запросов/ч (бесплатно), выше с Pro |

| Модели | Тысячи открытых моделей |

| Выделенные эндпоинты | Только платно |

| Serverless инференс | Бесплатно для популярных моделей |

Настройка

from huggingface_hub import InferenceClient

client = InferenceClient(

model="meta-llama/Llama-3.3-70B-Instruct",

token="hf_xxxxxxxxxxxx"

)

response = client.chat.completions.create(

messages=[{"role": "user", "content": "Explain async/await in JavaScript"}],

max_tokens=1024

)

print(response.choices[0].message.content)

Почему стоит использовать HuggingFace

Доступ к крупнейшей коллекции открытых моделей. Отлично для экспериментов и тестирования нишевых или специализированных моделей, которых нет нигде ещё.

4. OpenRouter

OpenRouter агрегирует модели от нескольких провайдеров и предлагает некоторые модели бесплатно. Работает как единый API-шлюз с OpenAI-совместимыми эндпоинтами.

Бесплатные модели

OpenRouter предлагает несколько моделей без затрат (спонсируется сообществом):

| Модель | Контекст | Статус |

|---|---|---|

| DeepSeek V3 (free) | 128К | Бесплатно |

| Llama 3.3 8B (free) | 128К | Бесплатно |

| Mistral 7B (free) | 32К | Бесплатно |

| Gemma 2 9B (free) | 8К | Бесплатно |

Бесплатные модели имеют более низкие лимиты запросов и возможны очереди в пиковое время.

Настройка

from openai import OpenAI

client = OpenAI(

api_key="sk-or-xxxxxxxxxxxx",

base_url="https://openrouter.ai/api/v1"

)

response = client.chat.completions.create(

model="deepseek/deepseek-chat-v3-0324:free",

messages=[{"role": "user", "content": "Write a Python decorator for caching"}],

)

print(response.choices[0].message.content)

Почему стоит использовать OpenRouter

Один API-ключ для десятков провайдеров. Лёгкое переключение моделей. Некоторые действительно бесплатные модели. Хороший запасной вариант при недоступности одного провайдера.

5. Ollama (локальный)

Ollama позволяет запускать открытые LLM на собственной машине. Полностью бесплатен, работает офлайн и хранит все данные в приватности.

Настройка

# Установить Ollama

curl -fsSL https://ollama.com/install.sh | sh

# Скачать и запустить модель

ollama pull llama3.3

ollama run llama3.3

Использование через OpenAI-совместимый API

Ollama открывает локальный API на порту 11434:

from openai import OpenAI

client = OpenAI(

api_key="ollama", # подойдёт любая строка

base_url="http://localhost:11434/v1"

)

response = client.chat.completions.create(

model="llama3.3",

messages=[{"role": "user", "content": "Explain Docker networking"}],

)

print(response.choices[0].message.content)

Рекомендуемые модели для локального использования

| Модель | Размер | Требуемый RAM | Качество |

|---|---|---|---|

| Llama 3.3 8B | 4,7 ГБ | 8 ГБ | Хорошее |

| Llama 3.3 70B | 40 ГБ | 48 ГБ | Отличное |

| Qwen 2.5 32B | 18 ГБ | 24 ГБ | Очень хорошее |

| DeepSeek Coder V2 16B | 9 ГБ | 12 ГБ | Отлично для кода |

| Mistral Small 22B | 13 ГБ | 16 ГБ | Хорошее |

| Phi-4 14B | 8 ГБ | 12 ГБ | Хорошее для своего размера |

Почему стоит использовать Ollama

Полная приватность, нулевые затраты, работа офлайн. Незаменим для разработчиков, работающих с чувствительными данными или желающих безлимитного использования без лимитов API.

6. Google AI Studio (Gemini)

Google предлагает щедрый бесплатный уровень для моделей Gemini через AI Studio — один из лучших бесплатных вариантов для разработчиков.

Детали бесплатного уровня

| Параметр | Лимит |

|---|---|

| Gemini 2.5 Flash | 15 запросов/мин, 1 500/день |

| Gemini 2.5 Pro | 2 запроса/мин, 50/день |

| Окно контекста | До 1М токенов |

| Цена | Бесплатно |

Настройка

import google.generativeai as genai

genai.configure(api_key="your-api-key")

model = genai.GenerativeModel("gemini-2.5-flash")

response = model.generate_content("Write a regex to validate email addresses")

print(response.text)

Почему стоит использовать Google AI Studio

Gemini 2.5 Flash — одна из лучших бесплатных моделей. Окно контекста в 1М токенов не имеет аналогов по данной ценовой категории.

7. Cerebras

Cerebras обеспечивает быстрый инференс на чипах wafer-scale. Их бесплатная бета-версия предлагает конкурентные скорости.

Настройка

from openai import OpenAI

client = OpenAI(

api_key="your-cerebras-key",

base_url="https://api.cerebras.ai/v1"

)

response = client.chat.completions.create(

model="llama-3.3-70b",

messages=[{"role": "user", "content": "Explain database indexing strategies"}],

)

print(response.choices[0].message.content)

Почему стоит использовать Cerebras

Исключительно быстрый инференс (конкурирует с Groq). Хороший бесплатный уровень для разработки и прототипирования.

8. Cloudflare Workers AI

Cloudflare предлагает AI-инференс в рамках своей платформы Workers со щедрым бесплатным уровнем.

Детали бесплатного уровня

| Параметр | Лимит |

|---|---|

| Запросы | 10 000/день |

| Модели | Llama 3.3, Mistral и другие |

| Нейроны (единицы вычислений) | 10 000/день |

| Развёртывание | Edge (глобальный CDN) |

Настройка

// Cloudflare Worker

export default {

async fetch(request, env) {

const response = await env.AI.run('@cf/meta/llama-3.3-70b-instruct-fp8-fast', {

messages: [

{ role: 'user', content: 'Explain WebSocket connections' }

]

});

return new Response(JSON.stringify(response));

}

};

Почему стоит использовать Cloudflare Workers AI

Edge-развёртывание (низкая задержка по всему миру), интеграция с экосистемой Cloudflare и щедрый бесплатный уровень для serverless-приложений.

Как выбрать

| Задача | Рекомендуется |

|---|---|

| Быстрейший бесплатный инференс | Groq или Cerebras |

| Наибольшее разнообразие моделей | Together AI или OpenRouter |

| Полная приватность / офлайн | Ollama |

| Наибольшее окно контекста (бесплатно) | Google AI Studio (Gemini) |

| Edge-развёртывание | Cloudflare Workers AI |

| Эксперименты с нишевыми моделями | HuggingFace |

| Продакшн с бесплатными кредитами | Together AI ($5 кредит) |

| Разработка с нулевыми затратами | Связка Groq + Ollama |

Универсальный Python-клиент

Поскольку большинство провайдеров поддерживают OpenAI-совместимые API, можно написать универсальный клиент, который переключается между ними:

from openai import OpenAI

PROVIDERS = {

"groq": {

"base_url": "https://api.groq.com/openai/v1",

"api_key": "gsk_xxx",

"model": "llama-3.3-70b-versatile"

},

"together": {

"base_url": "https://api.together.xyz/v1",

"api_key": "tog_xxx",

"model": "meta-llama/Llama-3.3-70B-Instruct-Turbo"

},

"openrouter": {

"base_url": "https://openrouter.ai/api/v1",

"api_key": "sk-or-xxx",

"model": "deepseek/deepseek-chat-v3-0324:free"

},

"ollama": {

"base_url": "http://localhost:11434/v1",

"api_key": "ollama",

"model": "llama3.3"

},

}

def query(provider: str, prompt: str) -> str:

config = PROVIDERS[provider]

client = OpenAI(api_key=config["api_key"], base_url=config["base_url"])

response = client.chat.completions.create(

model=config["model"],

messages=[{"role": "user", "content": prompt}],

)

return response.choices[0].message.content

# Используем самый дешёвый доступный провайдер

answer = query("groq", "Explain the difference between REST and GraphQL")

print(answer)

Советы по максимизации бесплатных уровней

- Реализуйте кэширование. Кэшируйте ответы на идентичные или похожие запросы, чтобы сократить количество API-вызовов.

- Используйте меньшие модели для простых задач. Модель 8B справляется с простым форматированием, резюмированием и извлечением данных. Резервируйте модели 70B+ для сложных рассуждений.

- Группируйте запросы. Если API поддерживает, объединяйте несколько промптов в один запрос.

- Настройте fallback-логику. Если один провайдер вас ограничивает, автоматически переключайтесь на другой.

- Запускайте локальную модель для разработки. Используйте Ollama локально при разработке, а облачного провайдера — для продакшна.

- Мониторьте использование. Отслеживайте API-вызовы, чтобы избежать неожиданных расходов при исчерпании бесплатных кредитов.

Итог

Наличие бесплатных и открытых LLM API в 2026 году означает, что каждый разработчик может создавать AI-приложения без значительных первоначальных затрат. Groq и Cerebras предлагают молниеносный бесплатный инференс, Google AI Studio даёт огромные окна контекста, а Ollama обеспечивает безлимитное локальное использование. Комбинируйте нескольких провайдеров для надёжной и экономичной AI-инфраструктуры.

Если вашему приложению также нужна AI-генерация медиа — изображений, видео, аудио или говорящих аватаров — загляните на Hypereal AI за единым API с pay-as-you-go ценообразованием и бесплатными стартовыми кредитами. Карты банков СНГ принимаются без VPN.

Попробуйте Hypereal AI бесплатно — 35 кредитов, карта не нужна.

Похожие статьи

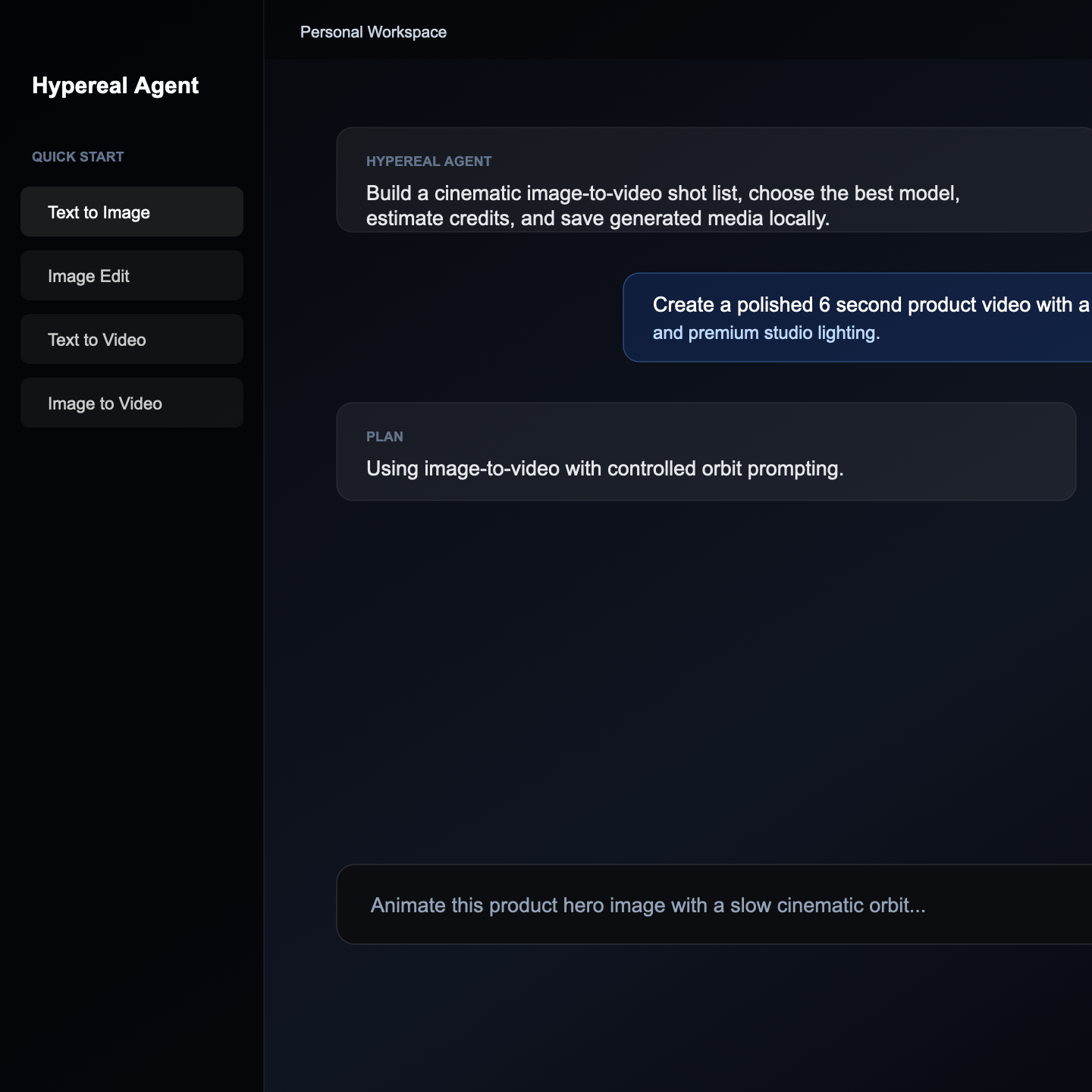

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.