Топ-10 языковых моделей без цензуры в 2026 году

Неограниченные языковые модели для локального запуска

Начните создавать с Hypereal AI

Получите доступ к Kling, Flux, Sora, Veo и другим через единый API. Бесплатные кредиты для начала, масштабирование до миллионов.

Кредитная карта не требуется • 100k+ разработчиков • Готовность к корпоративному использованию

Топ-10 языковых моделей без цензуры в 2026 году

Большинство коммерческих LLM — ChatGPT, Claude, Gemini — оснащены контентными фильтрами и системами безопасности, ограничивающими определённые типы вывода. Для исследователей, писателей, специалистов по безопасности и разработчиков, которым нужны неограниченные языковые модели, сегодня существует целая экосистема open-weight-моделей с возможностью локального запуска без какой-либо цензуры.

В этом руководстве — 10 лучших нецензурированных LLM, доступных в 2026 году, способы их локального запуска и практические сценарии использования.

Зачем использовать LLM без ограничений?

Существует ряд законных причин обратиться к нецензурированным моделям:

- Исследования в области безопасности: Red-teaming, тестирование на проникновение и анализ уязвимостей требуют моделей, способных открыто обсуждать темы безопасности.

- Художественное творчество: Авторам художественной литературы нужны модели, не отказывающиеся писать о конфликтах, морально неоднозначных персонажах или взрослой тематике.

- Медицинские и юридические исследования: Специалисты нуждаются в нефильтрованной информации по деликатным темам.

- Академические исследования: Изучение предвзятостей, выравнивания и поведения моделей требует доступа к нефильтрованным ответам.

- Конфиденциальность: При локальном запуске данные не покидают ваш компьютер.

Топ-10 нецензурированных LLM (2026)

1. Dolphin Mixtral (8x22B / 8x7B)

Dolphin — одно из самых известных семейств нецензурированных моделей. Варианты на основе Mixtral обеспечивают отличный уровень рассуждения без каких-либо контентных фильтров.

| Характеристика | Dolphin Mixtral 8x22B | Dolphin Mixtral 8x7B |

|---|---|---|

| Параметры | 141B (активных: 39B) | 46.7B (активных: 12.9B) |

| Необходимый VRAM | 80 ГБ+ (Q4) | 24 ГБ (Q4) |

| Лучше всего подходит | Сложное рассуждение | Общего назначения |

| Лицензия | Apache 2.0 | Apache 2.0 |

# Запуск через Ollama

ollama pull dolphin-mixtral:8x22b

ollama run dolphin-mixtral:8x22b

2. Nous Hermes 2 (Llama 3.1 70B / 8B)

Модели Hermes от Nous Research дообучены для максимальной полезности без искусственных отказов. Они точно следуют инструкциям и хорошо справляются со сложными запросами.

ollama pull nous-hermes2:70b

ollama run nous-hermes2:70b

3. WizardLM Uncensored (различные размеры)

WizardLM Uncensored удаляет обучение на выравнивание из моделей WizardLM с помощью процесса «uncensoring» — обучения на отказ от паттернов отказа при сохранении общих возможностей.

ollama pull wizardlm-uncensored:13b

ollama run wizardlm-uncensored:13b

4. Midnight Miqu (70B)

Модель, разработанная сообществом на основе утёкших весов Mistral. Midnight Miqu известна своими сильными возможностями в создании художественных текстов и минимальными ограничениями контента. Отлично справляется с длинными нарративами и ролевыми сценариями.

| Характеристика | Детали |

|---|---|

| Параметры | 70B |

| Необходимый VRAM | 40 ГБ+ (Q4_K_M) |

| Лучше всего подходит | Художественное творчество |

| Контекстное окно | 32K токенов |

5. Command R+ Uncensored

На основе архитектуры Cohere Command R+ существуют версии без цензуры, созданные сообществом, с сильными мультиязычными возможностями без контентных фильтров. Особенно хороши для исследований и аналитических задач.

ollama pull command-r-plus

# Нецензурированные квантизированные версии доступны на HuggingFace

6. Qwen 2.5 72B (Abliterated)

Abliterated-модели используют технику, удаляющую «направление отказа» из пространства активаций модели без переобучения. Abliterated-варианты Qwen 2.5 сохраняют сильные способности к рассуждению исходной модели при полном устранении поведения с отказами.

# Скачайте с HuggingFace и конвертируйте для Ollama

# Ищите "qwen2.5-72b-abliterated" на HuggingFace

ollama create qwen25-abliterated -f Modelfile

7. DeepSeek V3 (нецензурированные дообученные версии)

Модель DeepSeek V3 (671B MoE) была дообучена сообществом для удаления ограничений контента, связанных с политикой китайского правительства. Эти варианты популярны среди пользователей, которым нужны сильные возможности DeepSeek в программировании и рассуждении без политической цензуры.

8. Llama 3.3 70B (Abliterated)

Llama 3.3 от Meta — одна из сильнейших open-weight-моделей. Abliterated-версии удаляют обучение безопасности при сохранении всех впечатляющих возможностей модели.

# Доступно через квантизированные GGUF от сообщества

ollama pull llama3.3:70b

# Затем примените abliterated-веса через кастомный Modelfile

9. Yi 1.5 34B (Uncensored)

Семейство моделей Yi от 01.AI было нецензурировано сообществом. Вариант 34B находит оптимальный баланс между качеством и требованиями к железу — помещается на одну видеокарту с 24 ГБ VRAM в квантизации Q4.

ollama pull yi:34b

10. Mistral Small (24B) — нецензурированные дообученные версии

Модель Mistral Small была дообучена сообществом для использования без ограничений. При 24B параметрах она хорошо работает на потребительском железе, обеспечивая достойную производительность в разных задачах.

ollama pull mistral-small:24b

# Нецензурированные версии доступны на HuggingFace

Как запустить нецензурированные LLM локально через Ollama

Ollama — самый простой способ запускать локальные модели. Вот полное руководство по установке:

Шаг 1: Установите Ollama

# macOS / Linux

curl -fsSL https://ollama.ai/install.sh | sh

# Windows: скачайте с ollama.ai

# Проверьте установку

ollama --version

Шаг 2: Скачайте и запустите модель

# Скачайте модель (загружается один раз, затем используется повторно)

ollama pull dolphin-mixtral:8x7b

# Запустите в интерактивном режиме

ollama run dolphin-mixtral:8x7b

# Запустите как API-сервер

ollama serve

# API доступен по адресу http://localhost:11434

Шаг 3: Используйте API

import requests

response = requests.post(

"http://localhost:11434/api/generate",

json={

"model": "dolphin-mixtral:8x7b",

"prompt": "Explain how buffer overflow attacks work in detail.",

"stream": False

}

)

print(response.json()["response"])

Шаг 4: Используйте веб-интерфейс

Для интерфейса в стиле ChatGPT с вашими локальными моделями:

# Установите Open WebUI (ранее Ollama WebUI)

docker run -d -p 3000:8080 \

--add-host=host.docker.internal:host-gateway \

-v open-webui:/app/backend/data \

--name open-webui \

ghcr.io/open-webui/open-webui:main

Откройте http://localhost:3000 и подключитесь к своему инстансу Ollama. Вы получите полноценный чат-интерфейс с историей диалогов, переключением моделей и многим другим.

Сравнение требований к железу

| Модель | Параметры | Q4 VRAM | Q8 VRAM | Минимальный GPU |

|---|---|---|---|---|

| Dolphin Mixtral 8x7B | 46.7B | 24 ГБ | 48 ГБ | RTX 4090 |

| Nous Hermes 2 8B | 8B | 5 ГБ | 9 ГБ | RTX 3060 |

| Nous Hermes 2 70B | 70B | 40 ГБ | 75 ГБ | 2x RTX 4090 |

| WizardLM 13B | 13B | 8 ГБ | 14 ГБ | RTX 3070 |

| Qwen 2.5 72B | 72B | 42 ГБ | 78 ГБ | 2x RTX 4090 |

| Yi 34B | 34B | 20 ГБ | 36 ГБ | RTX 4090 |

| Mistral Small 24B | 24B | 14 ГБ | 26 ГБ | RTX 4080 |

| Llama 3.3 8B | 8B | 5 ГБ | 9 ГБ | RTX 3060 |

Нет GPU? Используйте CPU-инференс. Ollama поддерживает режим только CPU. Это медленно (1–5 токенов/сек для 7B-моделей), но работает:

# Принудительный режим CPU

OLLAMA_NUM_GPU=0 ollama run nous-hermes2:8b

Облачные варианты для запуска нецензурированных моделей

Если у вас нет подходящего железа, можно арендовать GPU:

| Провайдер | GPU | Цена/час | Лучше всего для |

|---|---|---|---|

| RunPod | RTX 4090 | $0.44 | Быстрые эксперименты |

| Vast.ai | RTX 4090 | $0.30 | Экономичные запуски |

| Lambda | A100 80GB | $1.25 | Большие модели |

| Together AI | API-доступ | Оплата за токены | Без настройки |

Правовые аспекты и безопасность

Запуск нецензурированных моделей легален в большинстве стран, однако вы несёте ответственность за то, как их используете. Несколько важных правил:

- Не генерируйте незаконный контент. Нецензурированные модели всё равно могут производить вредный вывод. Вы юридически ответственны за то, что делаете с результатом.

- Используйте по назначению. Исследования в области безопасности, художественное творчество и академическая работа — легитимные применения.

- Держите модели локальными при работе с чувствительными данными. Одно из главных преимуществ локальных моделей — ваши промпты никогда не покидают ваш компьютер.

Итог

Экосистема open-source LLM предлагает мощные нецензурированные модели для пользователей, которым нужно больше гибкости, чем дают коммерческие API. С такими инструментами, как Ollama и Open WebUI, запуск этих моделей локально доступен даже на потребительском железе.

Для генерации медиа с помощью ИИ — изображений, видео и talking-аватаров с гибкой контентной политикой — попробуйте Hypereal AI бесплатно — 35 кредитов, карта не нужна. Hypereal принимает карты российских банков без VPN и дополняет локальные LLM облачными API для генерации медиа.

Похожие статьи

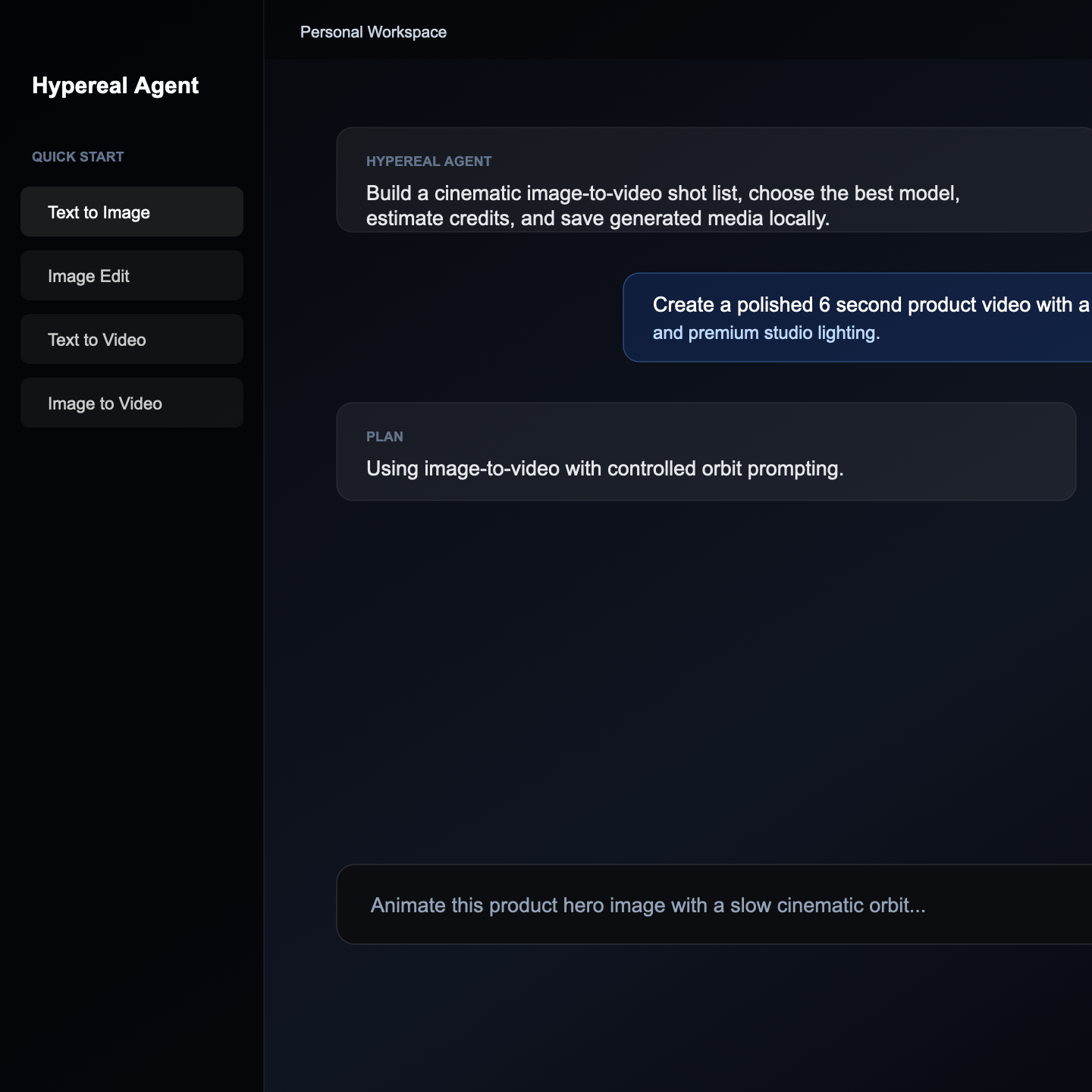

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.