2026 年 10 个无限制无审查 LLM 模型

不拒绝的开源与去除对齐(abliterated)模型——用途与运行方法

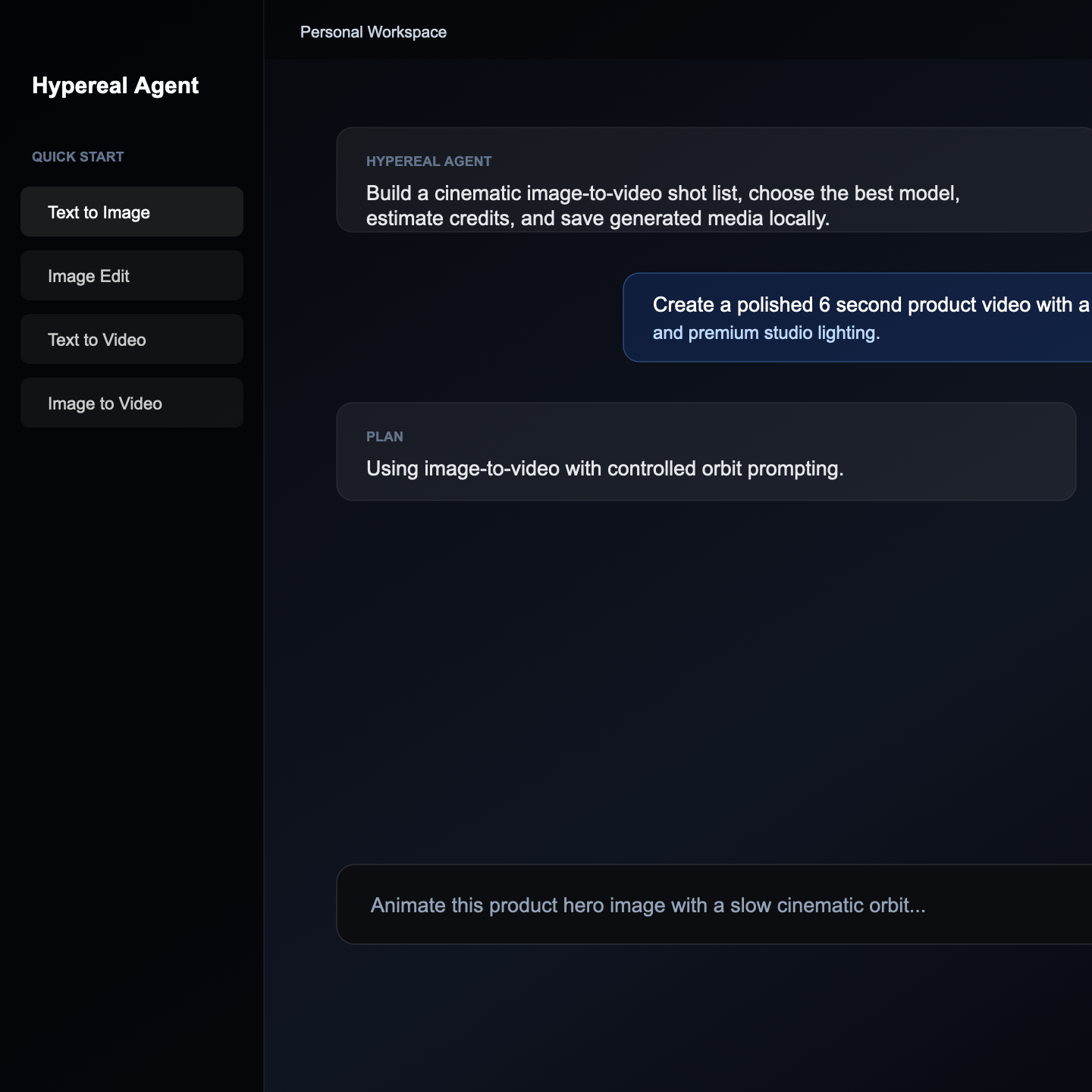

开始使用 Hypereal AI 构建

通过单个 API 访问 Kling、Flux、Sora、Veo 等模型。免费额度即可起步,可扩展至千万级。

无需信用卡 • 10 万+ 开发者 • 企业级服务

2026 年 10 个无限制无审查 LLM 模型

OpenAI、Anthropic、Google 的前沿模型带有安全训练,会拒绝各种合法用途——安全研究、有冲突的小说、医学参考、法律探索、成人创意写作。开源生态系统用无审查和**去除对齐(abliterated)**模型变体填补了这一空白:架构相同,但拒绝行为被重新训练掉、微调掉或在激活层面被手术式移除。

本文是 2026 年最佳无审查 LLM 10 个、各自真正的适用场景,以及如何运行它们。

术语说明

- 无审查(Uncensored):用反安全训练的示例微调。行为改变,但事实能力有时下降。

- 去除对齐(Abliterated):2024 年兴起的技术,从模型的残差流中移除拒绝方向。更干净——保留事实能力——但只移除类别拒绝,而非所有护栏。

- 基础模型(Base models):从未经过指令微调、从未 RLHF 的模型。自由最大,提示工程要求最高。

以下三类均有涵盖。

1. Llama 4 Uncensored(社区微调)

Llama 4 405B 的社区无审查微调。最均衡——能力接近基础 Llama 4,无类别拒绝。

- 最适合:不想与拒绝较劲的通用工作。小说、研究、安全分析。

- 局限:对未成年人及 CSAM 相邻内容仍有安全训练痕迹(理应如此)。

2. DeepSeek R1 Abliterated

社区版去除对齐的 DeepSeek R1。推理能力保留,拒绝移除。2026 年最佳无审查推理模型。

- 最适合:敏感话题的硬推理——安全漏洞、生化参考(仅研究用途)、竞赛数学。

- 局限:长文散文。R1 的推理链经常占满响应预算。

3. Hermes 4 405B(NousResearch)

NousResearch 对 Llama 4 的中性对齐微调。严格说不算无审查——只是拒绝阈值比基础 Llama 4 合理得多,且有很强的创意声音。

- 最适合:创意写作、角色塑造、角色扮演、叙事。

- 局限:非常具体的事实查询。

4. Dolphin 3.0(Cognitive Computations)

Eric Hartford 长期无审查系列。Dolphin 3.0 基于 Mistral Large 3。最许可的一个——最少对齐,严格服从指令。

- 最适合:需要模型服从指令而不说教的一切任务。

- 局限:微调后偶有啰嗦的"助手模式"响应。

5. WizardLM 3 Uncensored

微软 WizardLM 系列,社区无审查版。在多轮 Agent 循环中不会中途回退到拒绝,异常稳定。

- 最适合:需要在长会话中保持一致无审查行为的 Agentic 工作流。

- 局限:代码(请用专业代码模型)。

6. Mixtral 8x22B Uncensored

老牌但仍然出色。无审查 Mixtral 保留了强劲的多语言能力,在 2× A100 / 1× H100 配置下可本地运行。

- 最适合:自托管多语言工作流。

- 局限:推理能力已被 2026 年模型超越。

7. Qwen 3 Uncensored 235B

Qwen 3 235B 的社区无审查分支。最佳无审查中文模型。代码能力也很出色。

- 最适合:中文创意工作、代码、Qwen 自然优势重要的一切。

- 局限:偶尔语言混杂。

8. Llama 4 Base 405B(无指令微调)

严格来说不算"无审查"——从未被审查过,因为从未经过指令微调。表现如完成模型。自由最大,需要真正的提示工程。

- 最适合:纯完成工作流、仿真、研究 RLHF 前行为。

- 局限:任何聊天形式——它是基础模型,不是聊天机器人。

9. Dolphin Mistral 24B

基于 Mistral Small 3 的更小、更快 Dolphin 变体。单张 4090 可跑。出色的本地优先选项。

- 最适合:自托管、隐私敏感、单 GPU 环境。

- 局限:需要 >24B 级推理能力的任务。

10. Apollo 70B(Llama-3.3 微调)

2026 年新作——微调为减少伤害对齐但不拒绝的行为。会讨论任何话题,但尽量提供信息而非煽动。

- 最适合:医学、法律、减害、安全研究中需要实质性答案而非说教的场景。

- 局限:纯娱乐小说——语气偏临床。

运行方式——三种选择

A. 本地用 Ollama

ollama run dolphin3:8b

ollama run hermes4:70b

Ollama 托管了以上大部分模型的社区量化版。免费、私密、无网络往返。

B. 通过 OpenRouter 或 HuggingFace Inference

部分无审查模型通过 OpenRouter 提供(nousresearch/hermes-4-405b、cognitivecomputations/dolphin-3-mistral-large)。有免费层,生产用付费层。

C. 通过 Hypereal API

Hypereal 托管了一套精选的无审查/许可模型,同时提供高端前沿模型。相同的 OpenAI 兼容 API:

from openai import OpenAI

client = OpenAI(

base_url="https://api.hypereal.cloud/v1",

api_key="hyp_...",

)

response = client.chat.completions.create(

model="hermes-4-405b",

messages=[{"role": "user", "content": "Write a noir detective monologue."}],

)

相比 OpenRouter 或自托管的优势:生产级速率限制、OpenAI 兼容形式、同一个密钥就能访问 GPT Image 2、NanoBanana 2、Seedance 2.0 以及闭源前沿模型。

驱动无审查模型需求的使用场景

- 安全研究:红队提示、渗透测试、漏洞分析。

- 创意写作:有冲突的小说、道德复杂的角色、历史暴力、成人主题。

- 医学/法律参考:没有 200 字免责声明的实质性答案。

- 学术对齐研究:研究拒绝行为、安全评估。

- 隐私敏感工作流:本地推理是硬性需求时。

无论选择哪个模型,仍然禁止的内容

即使使用无审查权重,某些内容在大多数司法管辖区仍属非法:CSAM、非同意亲密图像、大规模杀伤性武器的具体操作指南。从模型中移除拒绝行为并不使内容合法——包括 Hypereal 在内的有信誉的托管提供商无论选择哪个模型都会对此执行严格的政策底线。

FAQ

"去除对齐"比"无审查"更好吗? 通常是——去除对齐保留事实能力,而无审查微调可能漂移。但去除对齐模型在更窄的类别上仍有软拒绝。

可以商用吗? 取决于各模型许可证。Llama 4 有 Llama 社区许可;Mistral 是 Apache;Qwen 是 Apache 衍生。请阅读各模型 card。

无审查模型幻觉更多吗? 我们的经验是略多——尤其是拒绝微调变体。去除对齐模型更接近原版。

从哪里开始? 本地:单 GPU 上的 Dolphin 3 24B。API:通过 Hypereal 或 OpenRouter 的 Hermes 4 405B。硬推理:DeepSeek R1 Abliterated。

开始使用

2026 年无审查生态系统覆盖了前沿模型拒绝阻碍工作的所有现实场景。Hypereal 是最简单的 API 路径——注册、拿密钥、换一个 base URL。

相关文章

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.