Как обойти лимиты OpenAI Codex: решения и воркэраунды (2026)

Преодолейте ограничения Codex и найдите лучшие альтернативы

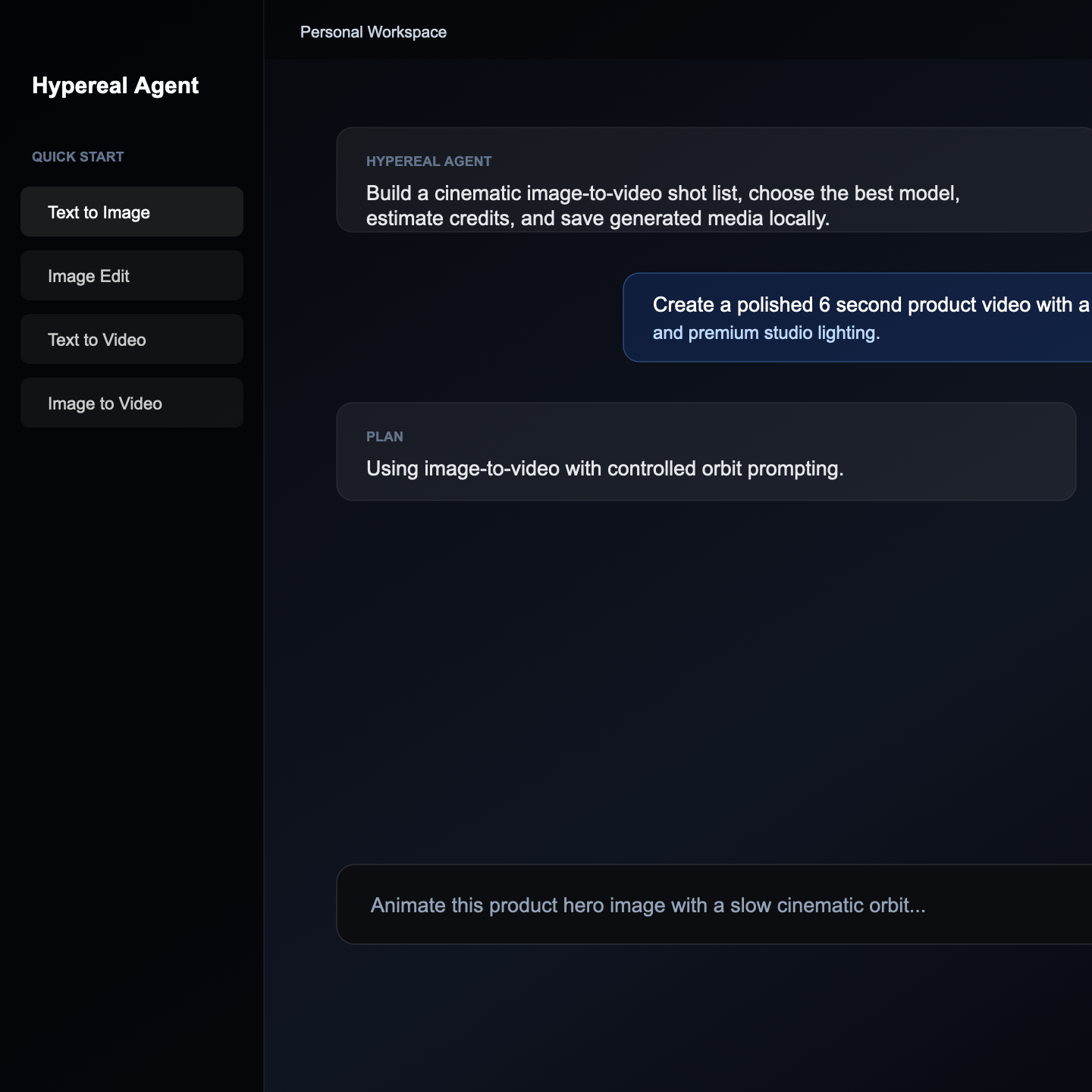

Начните создавать с Hypereal AI

Получите доступ к Kling, Flux, Sora, Veo и другим через единый API. Бесплатные кредиты для начала, масштабирование до миллионов.

Кредитная карта не требуется • 100k+ разработчиков • Готовность к корпоративному использованию

Как обойти лимиты OpenAI Codex: решения и воркэраунды (2026)

OpenAI Codex стал незаменимым инструментом в AI-ассистированной разработке, однако ограничения использования по-прежнему остаются постоянным источником раздражения. Независимо от того, упираетесь ли вы в rate limits API, расходуете кредиты быстрее ожидаемого или сталкиваетесь с троттлингом в часы пиковой нагрузки — это руководство охватывает все практические решения для максимизации использования Codex и лучшие альтернативы, когда лимиты становятся узким местом.

Понимание лимитов Codex

OpenAI применяет несколько типов ограничений в зависимости от способа доступа:

| Тип лимита | Бесплатный тир | Plus/Pro | API (Pay-as-you-go) |

|---|---|---|---|

| Запросов в минуту | 3 RPM | 20 RPM | 60–500 RPM (зависит от тира) |

| Токенов в минуту | 40 000 TPM | 150 000 TPM | До 2M TPM |

| Токенов в день | 200 000 | Без ограничений | Без ограничений (зависит от бюджета) |

| Параллельных задач | 1 | 3–5 | Зависит от тира |

| Контекстное окно | 192K | 192K | 192K |

Почему вы упираетесь в лимиты

Наиболее распространённые причины:

- Большие контекстные окна. Codex обрабатывает весь контекст репозитория, что быстро сжигает токены.

- Частые агентные циклы. При автономной работе Codex может генерировать десятки внутренних запросов на одну задачу.

- Троттлинг в часы пиковой нагрузки. OpenAI снижает пропускную способность в периоды высокого спроса даже для платных пользователей.

- Ограничения тира. Новые API-аккаунты начинают с Tier 1 с более низкими rate limits.

Решение 1: Повысьте тир API

OpenAI использует систему тиров, открывающую более высокие лимиты на основе истории расходов:

| Тир | Требуемые расходы | Лимит RPM | Лимит TPM |

|---|---|---|---|

| Бесплатный | $0 | 3 | 40 000 |

| Tier 1 | $5 | 60 | 200 000 |

| Tier 2 | $50 | 100 | 400 000 |

| Tier 3 | $100 | 300 | 1 000 000 |

| Tier 4 | $250 | 500 | 1 500 000 |

| Tier 5 | $1 000 | 500 | 2 000 000 |

Проверить и повысить тир:

# Проверьте текущее использование и тир через API

curl https://api.openai.com/v1/organization/usage \

-H "Authorization: Bearer $OPENAI_API_KEY"

Самый быстрый способ достичь более высокого тира — внести предоплату в панели управления OpenAI на platform.openai.com/account/billing.

Решение 2: Оптимизируйте потребление токенов

Снижение расхода токенов позволяет сделать больше в рамках существующих лимитов.

Используйте меньшие контекстные окна

Вместо того чтобы позволять Codex индексировать весь репозиторий, сфокусируйте задачи на конкретных файлах:

# Плохо: размытая задача, которая заставляет Codex сканировать всё

# "Fix the authentication bug in the project"

# Хорошо: конкретная задача с указанием файлов

# "Fix the JWT validation error in src/auth/middleware.ts.

# The token expiry check on line 45 should use >= not >"

Кэшируйте повторяющиеся запросы

Если вы используете Codex API программно, кэшируйте ответы для идентичных или похожих запросов:

import hashlib

import json

from pathlib import Path

from openai import OpenAI

CACHE_DIR = Path(".codex_cache")

CACHE_DIR.mkdir(exist_ok=True)

client = OpenAI()

def cached_codex_request(prompt: str, model: str = "codex-mini-latest") -> str:

"""Send a Codex request with local caching to save tokens."""

cache_key = hashlib.sha256(f"{model}:{prompt}".encode()).hexdigest()

cache_file = CACHE_DIR / f"{cache_key}.json"

if cache_file.exists():

return json.loads(cache_file.read_text())["response"]

response = client.responses.create(

model=model,

input=prompt

)

result = response.output_text

cache_file.write_text(json.dumps({"prompt": prompt, "response": result}))

return result

Используйте codex-mini для рутинных задач

OpenAI предлагает codex-mini-latest наряду с полной моделью. Мини-вариант потребляет значительно меньше токенов и быстрее для несложных задач:

# Использование Codex CLI с мини-моделью

codex --model codex-mini-latest "Add error handling to the fetch calls in api.ts"

Резервируйте полную модель для сложного многофайлового рефакторинга или архитектурных изменений.

Решение 3: Обработка rate limit с экспоненциальным откатом

При программном обращении к API реализуйте экспоненциальный откат:

import time

from openai import OpenAI, RateLimitError

client = OpenAI()

def codex_with_retry(prompt: str, max_retries: int = 5) -> str:

"""Call Codex API with exponential backoff on rate limits."""

for attempt in range(max_retries):

try:

response = client.responses.create(

model="codex-mini-latest",

input=prompt

)

return response.output_text

except RateLimitError as e:

if attempt == max_retries - 1:

raise

wait_time = (2 ** attempt) + 1

print(f"Rate limited. Waiting {wait_time}s before retry...")

time.sleep(wait_time)

// Node.js версия с логикой повтора

import OpenAI from "openai";

const client = new OpenAI();

async function codexWithRetry(prompt, maxRetries = 5) {

for (let attempt = 0; attempt < maxRetries; attempt++) {

try {

const response = await client.responses.create({

model: "codex-mini-latest",

input: prompt,

});

return response.output_text;

} catch (error) {

if (error.status !== 429 || attempt === maxRetries - 1) throw error;

const waitTime = Math.pow(2, attempt) + 1;

console.log(`Rate limited. Waiting ${waitTime}s...`);

await new Promise((r) => setTimeout(r, waitTime * 1000));

}

}

}

Решение 4: Распределите нагрузку по нескольким API-ключам

Если вы работаете в команде, можно распределять запросы между несколькими аккаунтами организации OpenAI для агрегирования rate limits:

import random

from openai import OpenAI

API_KEYS = [

"sk-proj-key1...",

"sk-proj-key2...",

"sk-proj-key3...",

]

def get_client() -> OpenAI:

"""Round-robin across API keys to distribute rate limits."""

key = random.choice(API_KEYS)

return OpenAI(api_key=key)

response = get_client().responses.create(

model="codex-mini-latest",

input="Refactor the database connection pool to use async/await"

)

Это легитимно, если каждый ключ принадлежит отдельному члену команды или проектному аккаунту.

Решение 5: Используйте альтернативы Codex

Когда лимиты Codex слишком жёсткие, эти альтернативы предлагают сопоставимые или лучшие возможности для написания кода:

| Инструмент | Модель | Rate limits | Стоимость | Лучше всего для |

|---|---|---|---|---|

| Claude Code | Claude Opus 4 | По токенам | ~$6–18/1M токенов | Сложное агентное кодирование |

| Gemini CLI | Gemini 2.5 Pro | 60 RPM бесплатно | Бесплатно (API) | Быстрые задачи, большой контекст |

| Aider | Любая модель | Зависит от провайдера | BYOK | Терминальные рабочие процессы |

| Cline | Любая модель | Зависит от провайдера | BYOK | Агентное кодирование в VS Code |

| Amazon Q CLI | Amazon models | Щедрый бесплатный тир | Бесплатно (с AWS) | AWS-ориентированные проекты |

| GitHub Copilot | GPT-4o + кастомные | 300 запросов/мес бесплатно | $10/мес | Инлайн-дополнения |

Настройка Claude Code как альтернативы Codex

Claude Code — прямой конкурент Codex без жёстких rate limits (платите за токены):

# Install Claude Code

npm install -g @anthropic-ai/claude-code

# Authenticate

claude

# Use it like Codex

claude "Refactor the auth middleware to support OAuth2"

Настройка Gemini CLI (бесплатно)

Google Gemini CLI предлагает бесплатный тир с мощной моделью Gemini 2.5 Pro:

# Install Gemini CLI

npm install -g @anthropic-ai/gemini-cli # or use the official installer

# Authenticate with Google

gemini auth login

# Use it for coding tasks

gemini "Add pagination to the /api/users endpoint"

Решение 6: Разверните собственную open-source альтернативу

Для неограниченного использования без rate limits разверните open-source модель для написания кода:

# Using Ollama for local inference

ollama pull qwen2.5-coder:32b

# Use with Aider for a Codex-like experience

pip install aider-chat

aider --model ollama/qwen2.5-coder:32b

Или разверните на облачном GPU для командного доступа:

# Deploy with vLLM on a cloud GPU

pip install vllm

python -m vllm.entrypoints.openai.api_server \

--model Qwen/Qwen2.5-Coder-32B-Instruct \

--tensor-parallel-size 2 \

--port 8000

Затем направьте любой OpenAI-совместимый инструмент на ваш сервер:

# Use with Codex CLI or any tool that supports custom endpoints

export OPENAI_API_KEY="dummy"

export OPENAI_BASE_URL="http://your-server:8000/v1"

codex "Add input validation to the registration form"

Сравнение: Codex vs альтернативы при интенсивном использовании

| Критерий | OpenAI Codex | Claude Code | Gemini CLI | Self-Hosted |

|---|---|---|---|---|

| Ежемесячная стоимость (интенсивное использование) | $50–200 | $50–150 | $0 (бесплатный тир) | $100–300 (GPU) |

| Rate limits | Жёсткие тиры | По токенам | 60 RPM | Нет |

| Качество кода | Отличное | Отличное | Очень хорошее | Хорошее–отличное |

| Многофайловое редактирование | Да | Да | Ограниченно | Зависит от инструмента |

| Офлайн-режим | Нет | Нет | Нет | Да |

| Сложность настройки | Лёгкая | Лёгкая | Лёгкая | Средняя |

Часто задаваемые вопросы

Как проверить текущее использование Codex? Зайдите на platform.openai.com/usage — там видны потребление токенов, тир rate limit и детали биллинга.

Используют ли Codex CLI и ChatGPT одни и те же лимиты? Нет. Codex CLI использует rate limits API, а ChatGPT имеет отдельные лимиты по продукту. Биллинг идёт с одного аккаунта, но квоты независимые.

Можно ли попросить OpenAI увеличить rate limit? Да. Для Tier 4 и выше можно обратиться в поддержку OpenAI с запросом на кастомные лимиты для корпоративных сценариев.

Есть ли бесплатные альтернативы Codex сопоставимого качества? Gemini CLI с Gemini 2.5 Pro — ближайшая бесплатная альтернатива. Среди open-source моделей Qwen 2.5 Coder 32B приближается к уровню Codex для большинства задач.

Итог

Лимиты Codex — реальное ограничение, но с ним можно работать. Начните с оптимизации потребления токенов и повышения тира API. Если лимиты остаются блокирующим фактором, такие инструменты как Claude Code и Gemini CLI предлагают сопоставимое качество с другими моделями ценообразования. Для неограниченного использования self-hosting Qwen 2.5 Coder даёт полный контроль.

Если ваш рабочий процесс включает AI-генерацию медиа, Hypereal AI предоставляет API-доступ к моделям генерации изображений, видео и аудио с прозрачным поcредитным ценообразованием и без жёстких rate limits. Карты СНГ принимаются без VPN. Получите 35 бесплатных кредитов для старта.

Похожие статьи

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.