2026年版 制限なし・無検閲 LLM モデル 10 選

拒否しないオープンウェイトと abliterated モデル——用途と実行方法

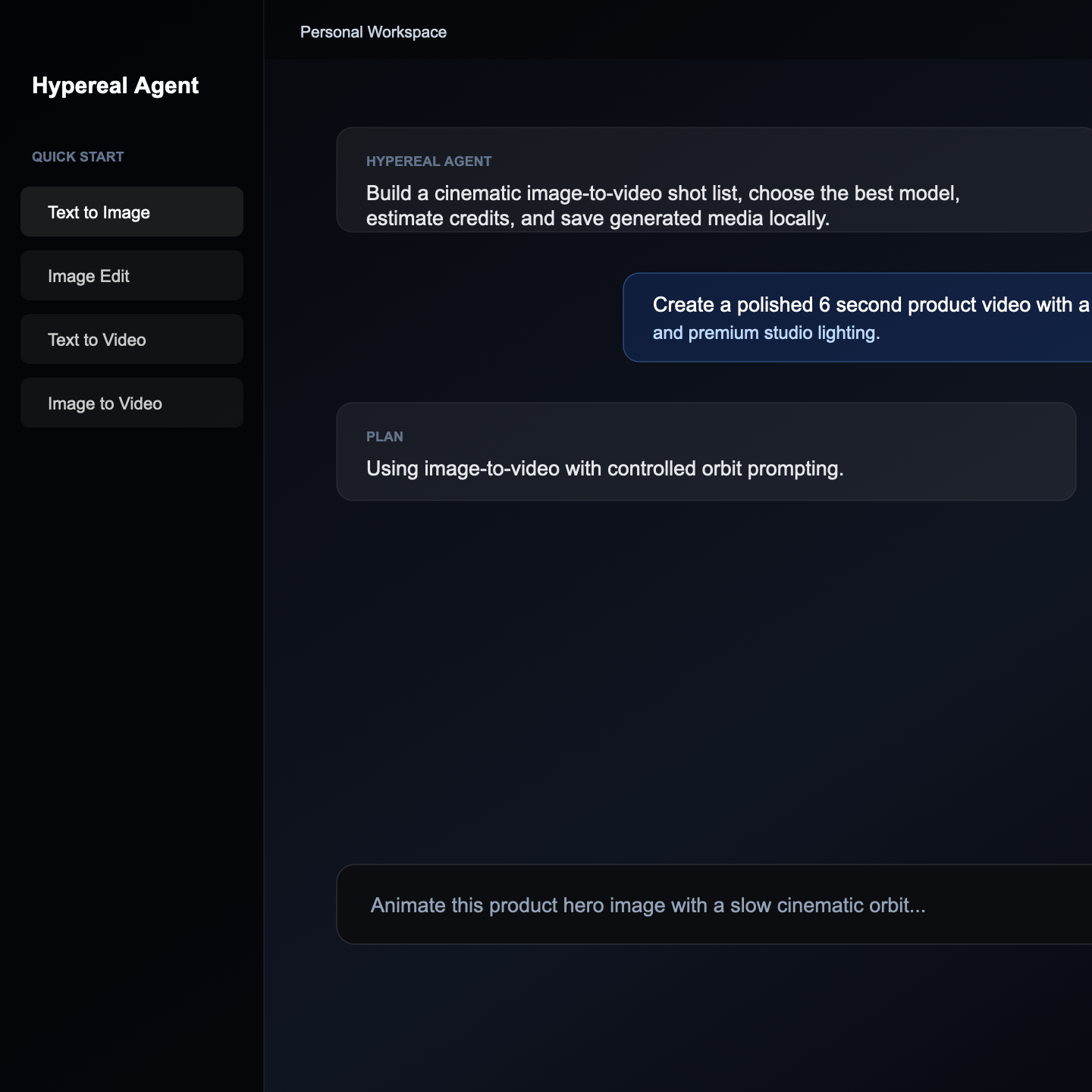

Hyperealで構築を始めよう

Kling、Flux、Sora、Veoなどに単一のAPIでアクセス。無料クレジットで開始、数百万規模まで拡張可能。

クレジットカード不要 • 10万人以上の開発者 • エンタープライズ対応

2026年版 制限なし・無検閲 LLM モデル 10 選

OpenAI・Anthropic・Google のフロンティアモデルには、セキュリティ研究・対立のある小説・医療参照・法的探求・成人クリエイティブ作業といった正当なユースケースを拒否するセーフティトレーニングが含まれています。オープンソースエコシステムは無検閲・abliterated モデル変種でこの空白を埋めてきました——同じアーキテクチャで、拒否動作が再トレーニング・ファインチューニング・活性化レベルの外科的除去によって取り除かれたものです。

このガイドは 2026 年の最良の無検閲 LLM 10 個、それぞれが実際に何に向いているか、そして実行方法をまとめたものです。

用語の整理

- 無検閲(Uncensored): 元のセーフティトレーニングに反する例でファインチューニング。動作は変わるが事実能力が失われることも。

- Abliterated: モデルの残差ストリームから拒否方向を除去する 2024 年発の手法。よりクリーン——事実能力を保持——ただしカテゴリ拒否のみを除去、すべてのガードレールを消すわけではない。

- ベースモデル: 一度も RLHF されていない、指示チューニング前のモデル。自由度最大、プロンプトエンジニアリング要求も最大。

以下で 3 つのカテゴリすべてを取り上げます。

1. Llama 4 Uncensored(コミュニティファインチューン)

Llama 4 405B のコミュニティ無検閲ファインチューン。最もバランスが良い——ベース Llama 4 に近い能力でカテゴリ拒否なし。

- 向いている用途: 拒否と戦いたくない一般作業。小説、研究、セキュリティ分析。

- 弱点: 未成年者・CSAM 隣接コンテンツのセーフティトレーニング痕跡は残っている(正しい対応)。

2. DeepSeek R1 Abliterated

コミュニティの abliterated DeepSeek R1。推論動作保持、拒否除去。2026 年最良の無検閲推論モデル。

- 向いている用途: 際どいトピックの難推論——セキュリティエクスプロイト、生化学参照(研究のみ)、競技数学。

- 弱点: 長文散文。R1 の推論チェーンがレスポンス予算を食いがち。

3. Hermes 4 405B(NousResearch)

NousResearch の Llama 4 に対するニュートラルアラインメントファインチューン。厳密には無検閲ではない——ただしベース Llama 4 よりはるかに合理的な拒否閾値と強いクリエイティブボイスを持つ。

- 向いている用途: クリエイティブライティング、キャラクター作業、ロールプレイ、ナラティブ。

- 弱点: 非常に具体的な事実クエリ。

4. Dolphin 3.0(Cognitive Computations)

Eric Hartford の長期無検閲シリーズ。Dolphin 3.0 は Mistral Large 3 ベース。最も許容範囲が広い——最小アラインメントで指示を厳格に遵守。

- 向いている用途: 説教なしで指示に従わせたい一切のタスク。

- 弱点: ファインチューンにもかかわらず冗長な「ヘルパーモード」応答が出ることあり。

5. WizardLM 3 Uncensored

Microsoft WizardLM ラインのコミュニティ無検閲版。長い会話の途中で拒否に戻ることなくマルチターンエージェントループをこなす安定感が際立つ。

- 向いている用途: 長いセッションで一貫した無検閲動作が必要なエージェントワークフロー。

- 弱点: コード(コーダーモデルを使ってください)。

6. Mixtral 8x22B Uncensored

古いが今も優秀。無検閲 Mixtral は多言語性能を保持し、2× A100 / 1× H100 構成でローカル実行可能。

- 向いている用途: セルフホストの多言語ワークフロー。

- 弱点: 最先端の推論——2026 年モデルに追い抜かれている。

7. Qwen 3 Uncensored 235B

Qwen 3 235B のコミュニティ無検閲フォーク。最良の無検閲中国語モデル。コードも優秀。

- 向いている用途: 中国語クリエイティブ作業、コード、Qwen の強みが活きる一切。

- 弱点: 言語混在が起きることあり。

8. Llama 4 Base 405B(指示チューニングなし)

厳密には「無検閲」ではない——一度も検閲されていない(指示チューニングも受けていない)。補完モデルとして動作。自由度最大、真のプロンプトエンジニアリングが必要。

- 向いている用途: 純粋な補完ワークフロー、シミュレーション、RLHF 前動作の研究。

- 弱点: あらゆるチャット形式——チャットボットではなくベースモデルです。

9. Dolphin Mistral 24B

Mistral Small 3 ベースの小型・高速 Dolphin 変種。単一 4090 で動作。優れたローカルファーストオプション。

- 向いている用途: セルフホスト、プライバシー重視、シングル GPU 環境。

- 弱点: 24B クラス以上の推論が必要なタスク。

10. Apollo 70B(Llama-3.3 ファインチューン)

2026 年の新作——ハームリダクション指向だが拒否しない動作にファインチューン。何でも議論するが、煽るより情報提供を重視する。

- 向いている用途: 医療・法律・ハームリダクション・セキュリティ研究で、説教なしの実質的な答えが欲しいとき。

- 弱点: 純エンターテインメント小説——トーンが臨床的になりがち。

実行方法——3 つの選択肢

A. Ollama でローカル実行

ollama run dolphin3:8b

ollama run hermes4:70b

Ollama が上記モデルのほとんどのコミュニティ量子化をホストしています。無料、プライベート、ネットワーク往復なし。

B. OpenRouter または HuggingFace Inference 経由

複数の無検閲モデルが OpenRouter で提供されています(nousresearch/hermes-4-405b、cognitivecomputations/dolphin-3-mistral-large)。無料層あり、本番用は有料層。

C. Hypereal API 経由

Hypereal は、プレミアムフロンティアモデルに加えて無検閲・許容性の高いモデルを厳選してホスト。同じ OpenAI 互換 API:

from openai import OpenAI

client = OpenAI(

base_url="https://api.hypereal.cloud/v1",

api_key="hyp_...",

)

response = client.chat.completions.create(

model="hermes-4-405b",

messages=[{"role": "user", "content": "Write a noir detective monologue."}],

)

OpenRouter やセルフホストに対するメリット:本番グレードのレート制限、OpenAI 互換形式、同じキーで GPT Image 2・NanoBanana 2・Seedance 2.0・クローズドソースフロンティアモデルも使える。

無検閲モデルを必要とするユースケース

- セキュリティ研究: レッドチームプロンプト、ペネトレーションテスト、エクスプロイト分析。

- クリエイティブライティング: 対立のある小説、道徳的に複雑なキャラクター、歴史的暴力、成人テーマ。

- 医療・法律参照: 200 字の免責なしで実質的な回答が欲しいとき。

- 学術アラインメント研究: 拒否動作の研究、安全評価。

- プライバシー重視ワークフロー: ローカル推論が要件のとき。

どのモデルを選んでも禁止されているもの

無検閲ウェイトを使っても、特定のコンテンツはほとんどの法域で違法です:CSAM、非同意の親密画像、大量殺傷兵器への具体的な操作手順。モデルから拒否動作を取り除いてもコンテンツが合法になるわけではありません——Hypereal を含む評判あるホスティングプロバイダは、どのモデルを選択していても、これらに対して厳格なポリシーラインを適用します。

FAQ

「abliterated」と「無検閲」、どちらが優れていますか? 一般的に abliterated の方が良い——アブリテレーションは事実能力を保持しますが、無検閲ファインチューンはドリフトする可能性があります。ただし abliterated モデルもより狭いカテゴリでは軟拒否が残ります。

商用利用できますか? 各モデルのライセンス次第。Llama 4 は Llama コミュニティライセンス、Mistral は Apache、Qwen は Apache 派生。各モデルカードを読んでください。

無検閲モデルはハルシネーションが多い? 我々の経験上わずかに多め——特に拒否ファインチューン変種で。Abliterated モデルは原版に近い。

どこから始めるべき? ローカルなら単一 GPU で Dolphin 3 24B。API なら Hypereal か OpenRouter の Hermes 4 405B。難しい推論には DeepSeek R1 Abliterated。

さあ始めましょう

2026 年の無検閲エコシステムは、フロンティアモデルの拒否が邪魔になるすべての現実的なユースケースをカバーしています。Hypereal が最も簡単な API ルートです——登録してキーを取得し、base URL を 1 か所変えるだけ。

関連記事

Download Hypereal Agent

Run a local AI media workspace for image generation, video prompts, model selection, credit tracking, and saved artifacts.